使用场景

1. 将Phi-3 Mini集成到企业的智能助理系统中,为客户提供自然语言交互和生成式服务

2. 基于Phi-3 Mini开发自动文本生成和创作辅助工具,为作家、内容创作者等提供创作支持

3. 利用Phi-3 Mini的推理能力构建数据分析和报告生成系统,自动生成分析报告

产品特色

- 支持多种硬件平台加速推理,包括: - DirectML:适用于AMD、Intel和NVIDIA GPU的Windows设备,通过AWQ量化实现int4精度 - FP16 CUDA:适用于NVIDIA GPU,FP16精度 - Int4 CUDA:适用于NVIDIA GPU,通过RTN量化实现int4精度 - Int4 CPU和移动端:通过RTN量化实现int4精度,针对CPU和移动端提供两种版本以平衡延迟和精度

- 提供ONNX Runtime新的Generate()API,极大简化了在应用中集成生成式AI模型的流程

- 性能优异,相比PyTorch提高多达10倍,相比Llama.cpp提高多达3倍

- 支持大批量、长提示和长输出推理

- 量化后体积小,便于部署

使用教程

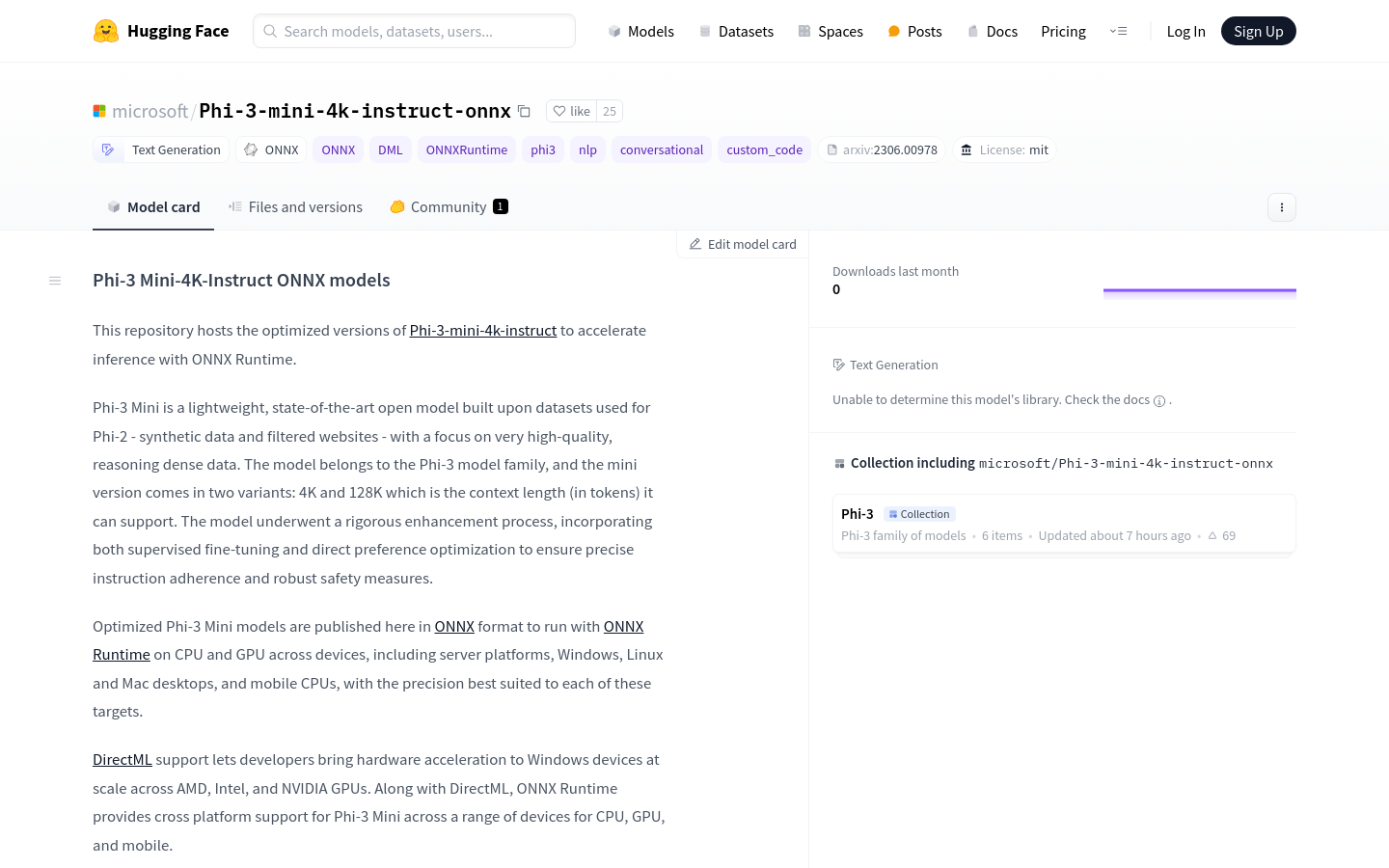

1. 前往Hugging Face页面下载所需的ONNX模型文件

2. 安装ONNX Runtime和ONNX Runtime Generate() API相关软件包

3. 在代码中加载ONNX模型文件

4. 使用ONNX Runtime Generate() API设置推理参数,如批量大小、提示长度等

5. 调用生成函数,输入文本提示

6. 获取输出结果并进行后续处理