使用场景

1. 一家技术公司可以使用Phi-3 Mini模型构建高性能的对话代理,为客户提供自动化问答服务。

2. 一家新闻机构可以利用该模型自动生成高质量的新闻文章摘要和标题。

3. 研究人员可以使用该模型进行自然语言处理相关的实验和研究,探索语言模型的新用途。

产品特色

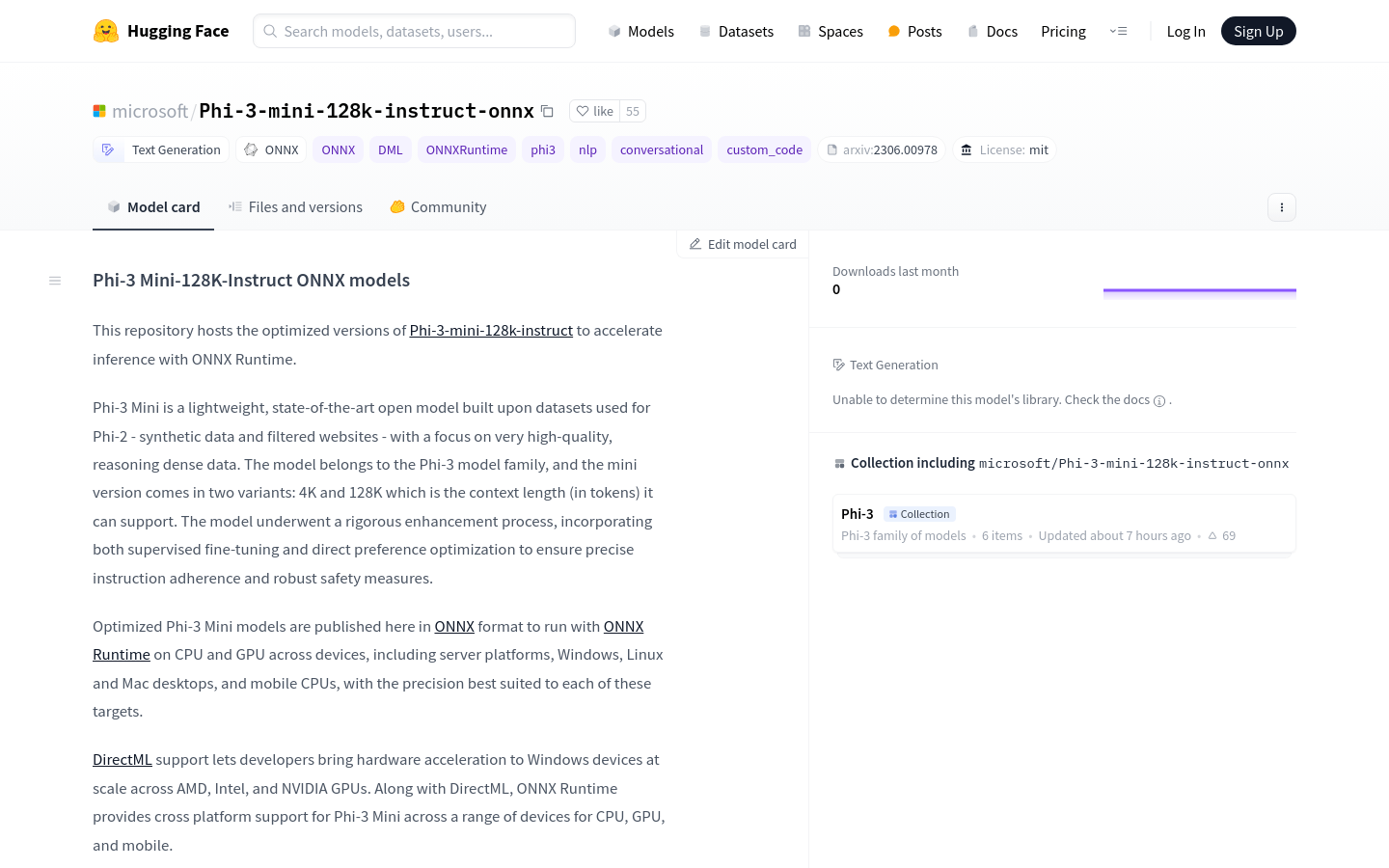

• 支持ONNX格式,可加速在CPU、GPU和移动设备上的推理

• 提供多种优化配置,包括用于DirectML的int4量化、用于NVIDIA GPU的fp16和int4量化、用于CPU和移动设备的int4量化等

• 经过增强训练,确保精准遵循指令和强大的安全性

• 轻量级设计,专注于高质量推理密集型数据

• 提供新的ONNX Runtime Generate() API,简化Phi-3的使用

• 在多种硬件和平台上进行了性能测试和优化

使用教程

1. 从GitHub仓库下载适合您的硬件配置的ONNX模型文件。

2. 安装必要的Python包,如ONNX Runtime、transformers等。

3. 使用ONNX Runtime Generate() API加载模型并进行推理。

4. 准备您的输入文本或指令。

5. 调用模型进行预测或生成输出。

6. 根据需要对输出结果进行后处理。

7. 将生成的输出集成到您的应用程序或工作流程中。