使用场景

作为聊天机器人的后端,提供自动回复功能。

辅助生成新闻报道或文章的初稿。

在教育平台中,自动生成学生的个性化学习材料。

产品特色

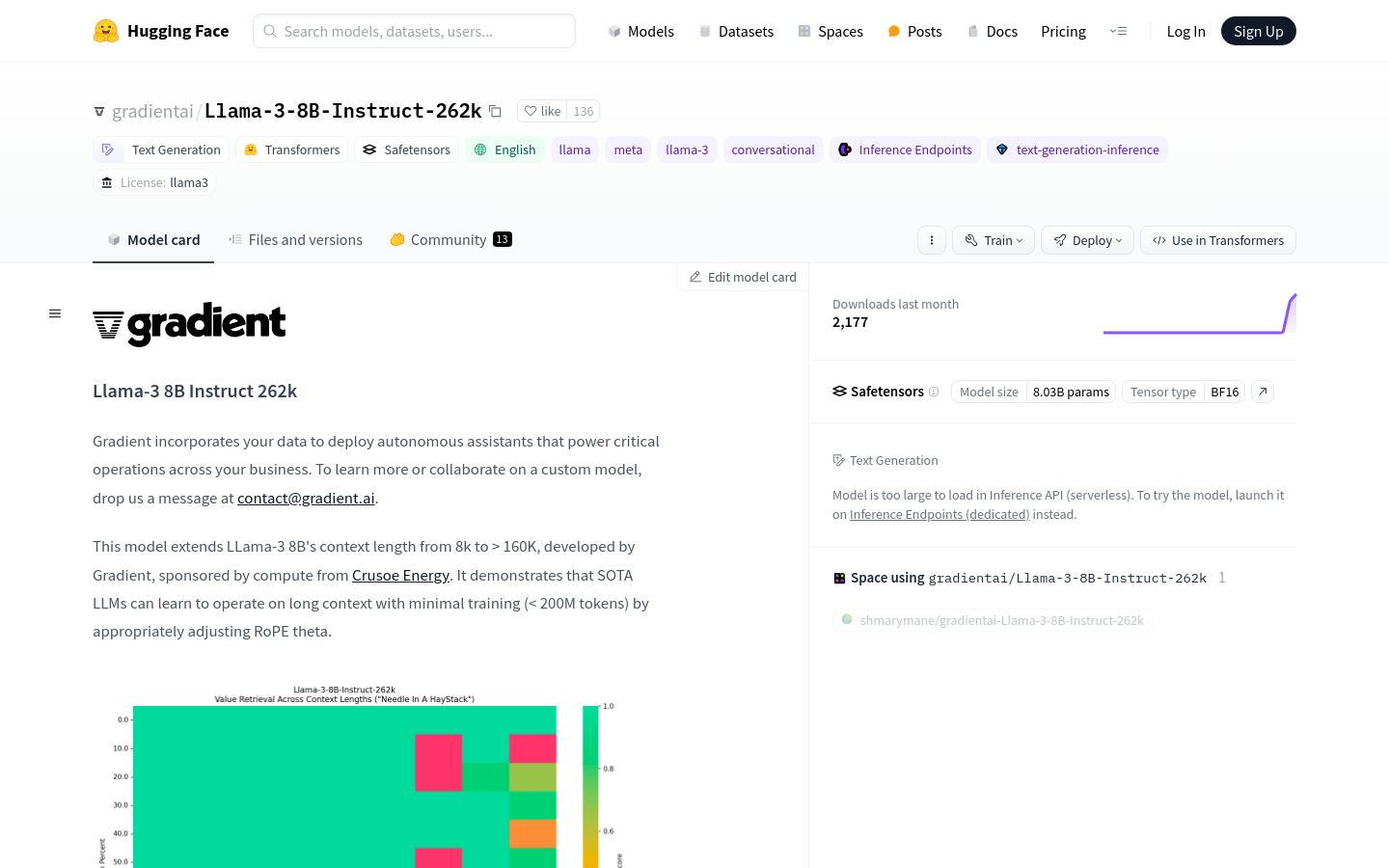

支持长文本生成,上下文长度可超过160K。

使用NTK-aware插值和数据驱动优化技术进行训练。

基于EasyContext Blockwise RingAttention库,实现高效训练。

适用于对话场景,优化了有用性和安全性。

支持多种编程接口,如Transformers和llama3。

提供量化版本和GGUF格式,方便部署和使用。

使用教程

步骤1:访问Hugging Face模型库并选择Llama-3 8B Instruct 262k模型。

步骤2:根据需求选择使用Transformers或llama3的编程接口。

步骤3:通过API或命令行工具下载模型及其依赖。

步骤4:根据提供的示例代码,编写自己的输入文本或指令。

步骤5:使用模型生成文本,可以通过调整参数来优化输出结果。

步骤6:将生成的文本应用于所需的场景,如聊天机器人回复、文章生成等。

步骤7:根据反馈不断调整和优化模型参数,以获得更好的性能。