使用场景

在图像检索任务中,使用MetaCLIP模型来提高检索的准确性

在社交媒体内容分析中,利用MetaCLIP模型理解图像和相关文本的关联

在教育领域,使用MetaCLIP模型来辅助图像和文本的教学材料开发

产品特色

从零开始的数据筛选,不依赖先前模型的过滤

透明的训练数据分布,通过元数据发布

可扩展的算法,适用于大规模图像-文本对数据集

标准化的CLIP训练设置,便于控制实验和比较

使用模糊人脸的图像进行训练,注重隐私保护

提供预训练模型,支持快速应用和研究

使用教程

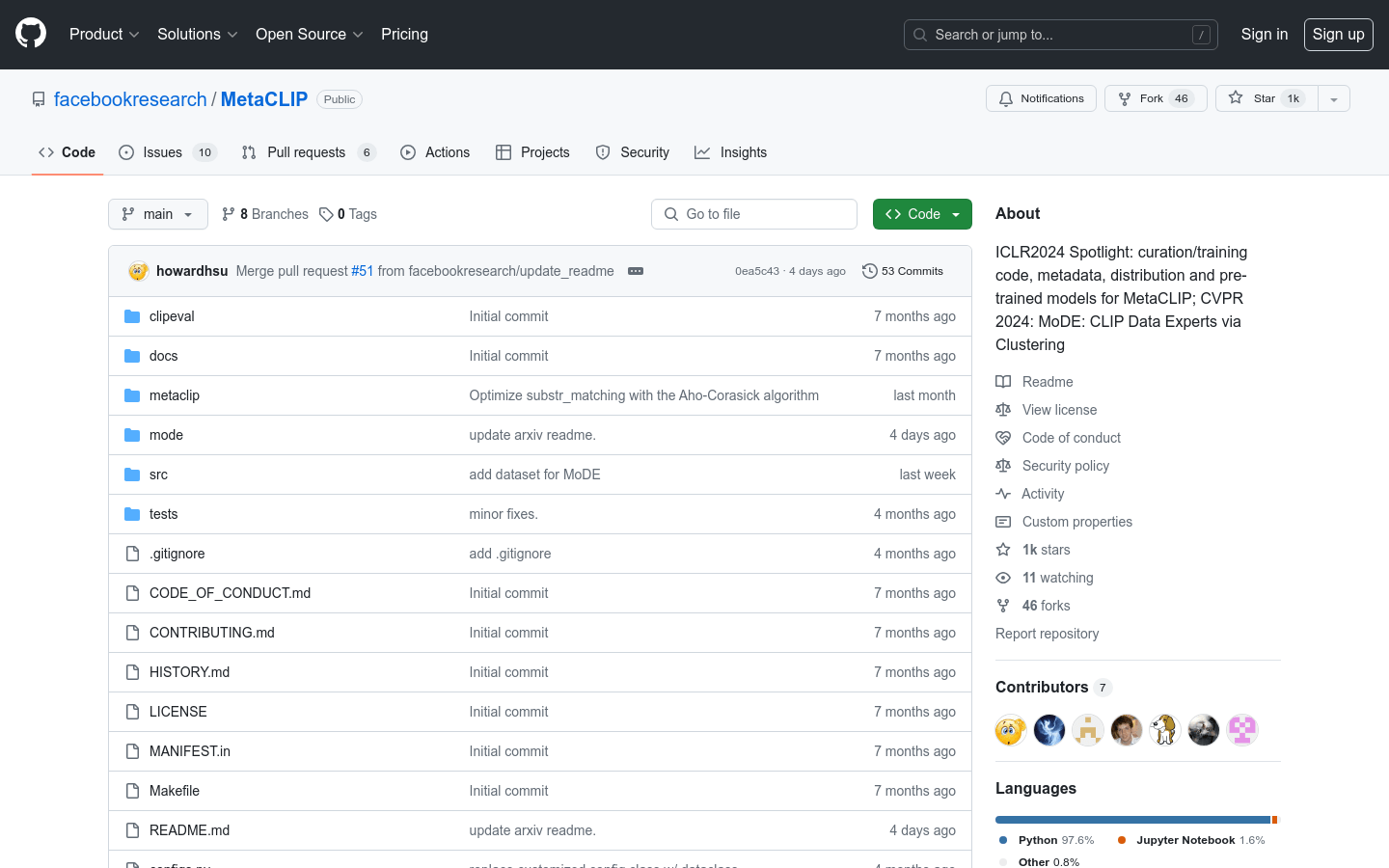

步骤1:访问MetaCLIP的GitHub页面以获取代码和文档

步骤2:根据文档说明安装必要的依赖项

步骤3:下载并加载MetaCLIP提供的预训练模型

步骤4:准备图像和文本数据,按照模型要求进行预处理

步骤5:使用模型进行图像和文本的联合表示学习

步骤6:根据应用场景,对学习到的特征进行后续处理,如分类、检索等