使用场景

在C-Eval、MMLU、CMMLU等流行基准测试上的评估

使用HuggingFace进行Skywork-MoE-Base模型的推理示例

基于vLLM的Skywork-MoE-Base模型快速部署示例

产品特色

Gating Logit Normalization技术,增强专家多样化

Adaptive Auxiliary Loss Coefficients技术,允许层特定的辅助损失系数调整

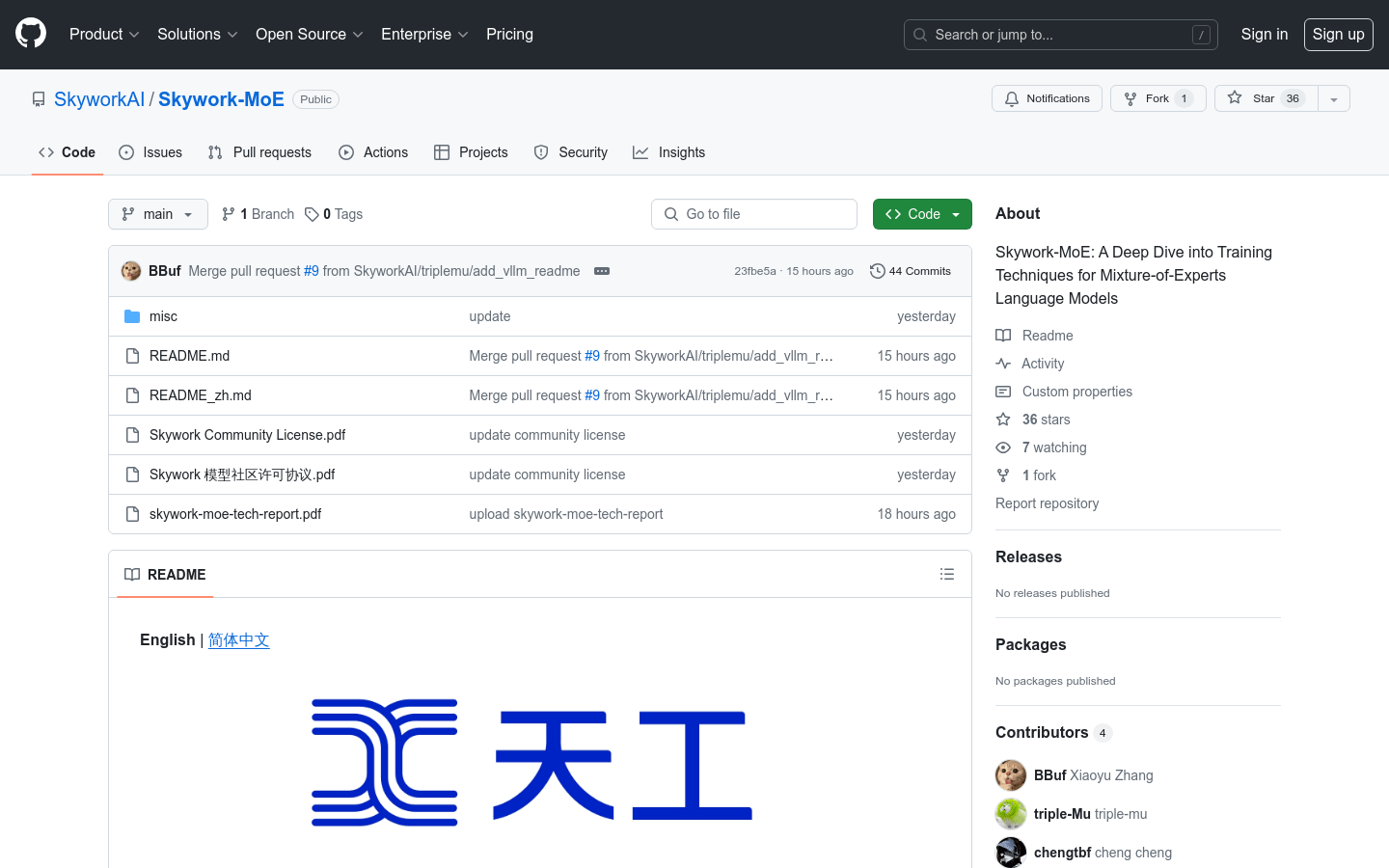

与Hugging Face、ModelScope、Wisemodel等平台兼容

支持在8xA100/A800或更高GPU硬件配置上进行推理

提供vLLM模型推理的快速部署方法

支持fp8精度,可在8*4090上运行Skywork-MoE-Base模型

提供详细的技术报告和社区许可协议

使用教程

安装必要的依赖,包括pytorch-nightly版本和vllm-flash-attn

克隆Skywork提供的vllm源代码

根据本地环境配置并编译安装vllm

使用docker运行vllm,设置模型路径和工作目录

通过vllm的LLM类和SamplingParams类进行文本生成