使用场景

研究人员使用RL4VLM微调模型以改进自然语言处理任务中的决策制定能力。

开发者利用该项目提供的代码库和环境来训练自定义的视觉-语言模型。

教育机构将RL4VLM作为教学案例,向学生展示如何通过强化学习提升模型性能。

产品特色

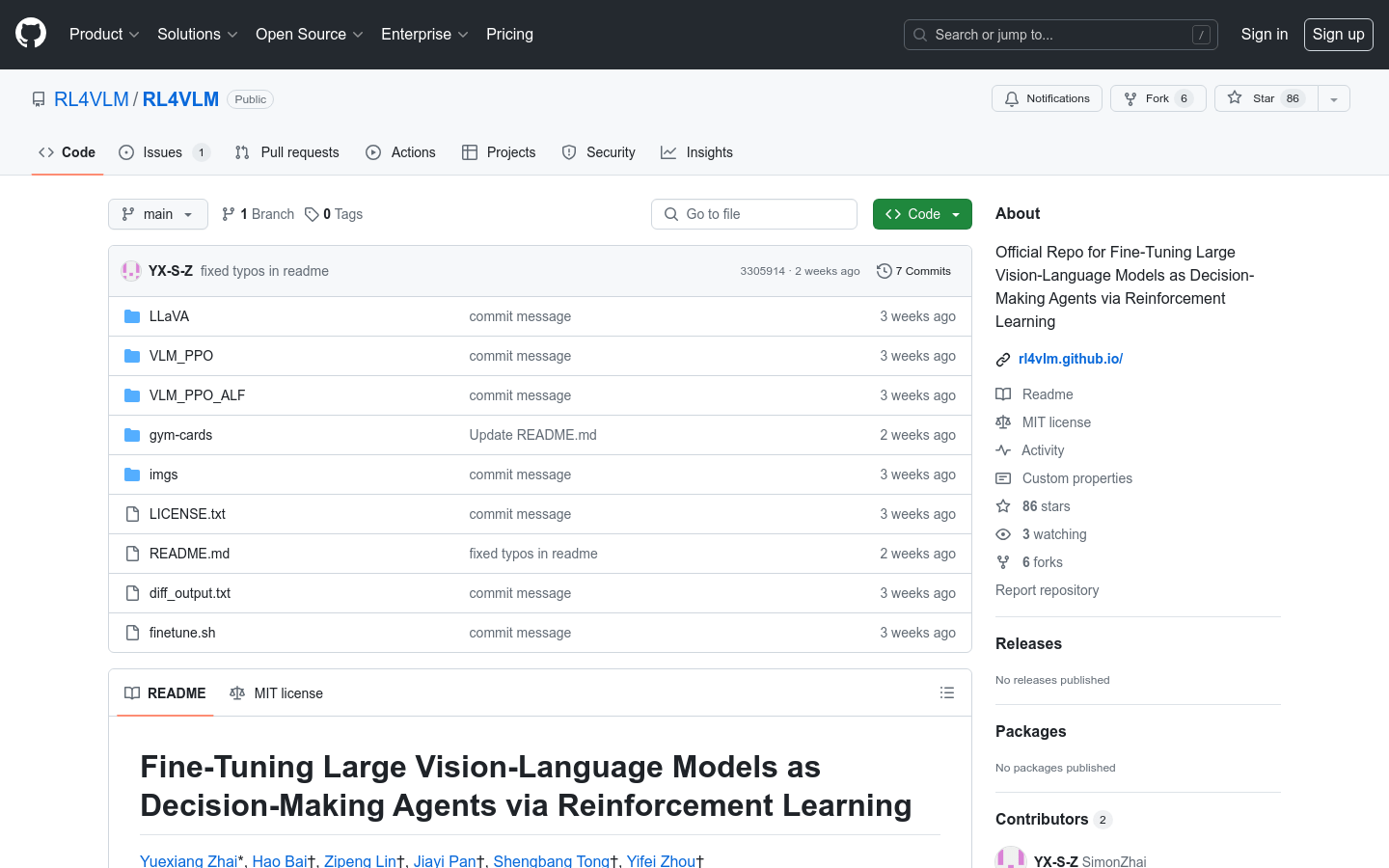

提供了修改版的LLaVA模型。

原创的GymCards环境。

为GymCards和ALFWorld环境提供的RL4VLM代码库。

详细的训练流程,包括准备SFT检查点和使用SFT检查点运行RL。

提供了两种不同的conda环境,以适应GymCards和ALFWorld的不同包需求。

提供了运行算法的详细指南和模板脚本。

强调了使用特定检查点作为起点的重要性,并提供了使用不同初始模型的灵活性。

使用教程

首先,访问RL4VLM的GitHub页面以获取项目信息和代码库。

根据提供的入门指南,准备所需的SFT检查点。

下载并设置所需的conda环境,以适应GymCards或ALFWorld。

根据指南运行LLaVA的微调过程,设置必要的参数如数据路径和输出目录。

使用提供的模板脚本运行RL算法,配置GPU数量和相关参数。

根据实验需求,调整配置文件中的参数,如num_processes。

运行RL算法,并监控训练过程和模型性能。

根据项目提供的引用指南,正确引用RL4VLM项目。