使用场景

使用AudioLCM生成特定文本的朗读音频,用于有声书或播客。

将历史人物的演讲稿转化为逼真的语音,用于教育或展览。

为视频游戏或动画角色生成定制的语音,增强角色的个性和表现力。

产品特色

支持从文本到音频的高保真度生成。

提供了预训练模型,方便用户快速开始使用。

允许用户下载权重,以支持自定义数据集。

提供了详细的训练和推理代码,方便用户学习和二次开发。

能够处理mel频谱图的生成,为音频合成提供必要的中间表示。

支持变分自编码器和扩散模型的训练,以生成高质量的音频。

提供了评估工具,可以计算FD, FAD, IS, KL等音频质量指标。

使用教程

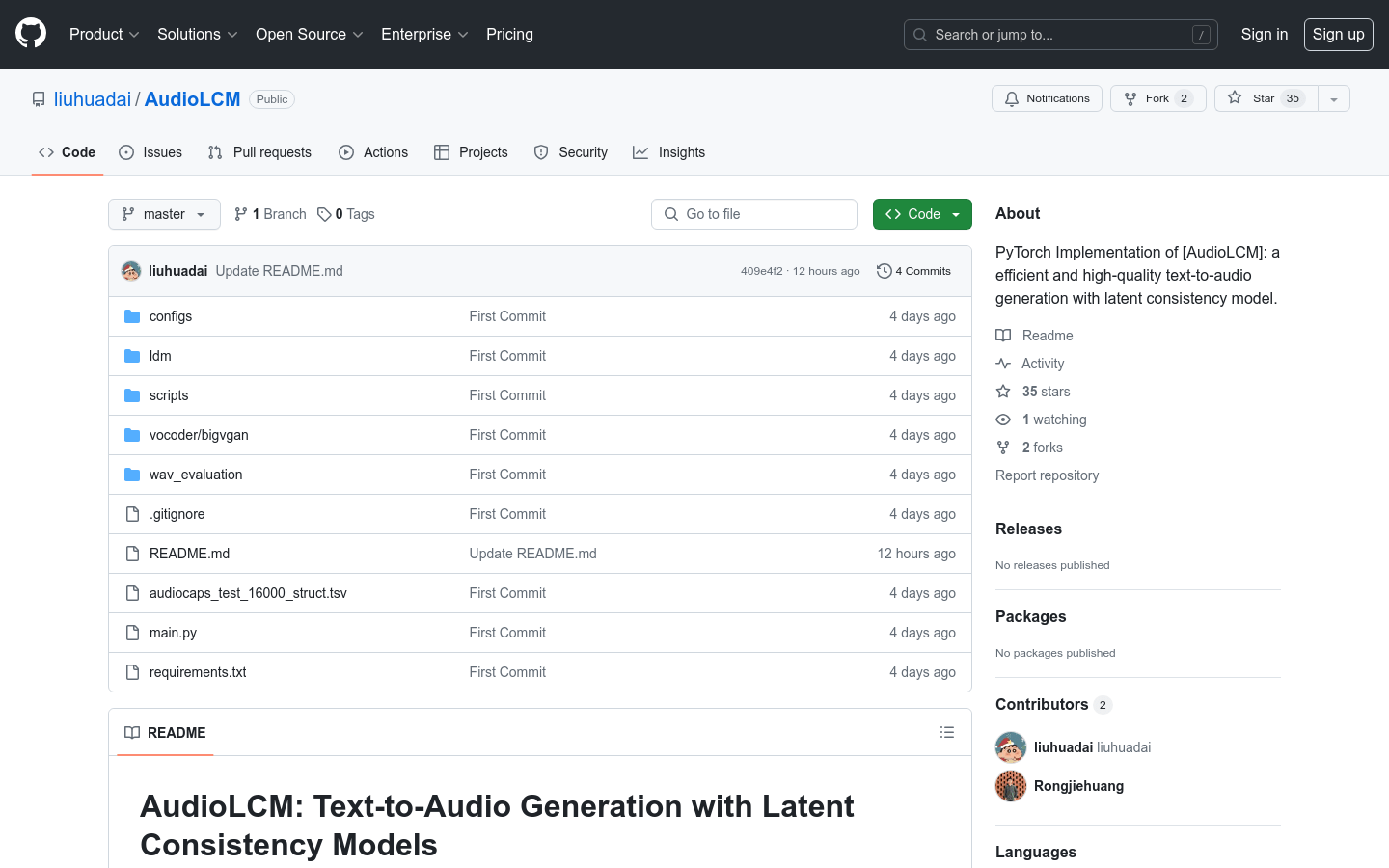

克隆AudioLCM的GitHub仓库到本地机器。

根据README中的说明,准备NVIDIA GPU和CUDA cuDNN环境。

下载所需的数据集权重,并按照指导准备数据集信息。

运行mel频谱图生成脚本,为音频合成准备中间表示。

训练变分自编码器(VAE),以学习文本和音频之间的潜在映射。

使用训练好的VAE模型,训练扩散模型以生成高质量的音频。

使用评估工具对生成的音频进行质量评估,如计算FD, FAD等指标。

根据个人需求,对模型进行微调和优化,以适应特定的应用场景。