使用场景

研究人员使用MG-LLaVA进行图像和文本的联合学习,以提高模型在多模态任务上的表现。

开发者利用MG-LLaVA对社交媒体上的图像和评论进行分析,以提取用户情感和偏好。

企业使用MG-LLaVA优化其产品的视觉搜索功能,以提供更准确的图像匹配和推荐。

产品特色

增强视觉处理能力:通过多粒度视觉流程提升模型对视觉信息的处理。

细节捕捉:使用高分辨率视觉编码器捕捉图像中的细微特征。

特征融合:通过Conv-Gate融合网络整合不同分辨率的视觉特征。

对象识别能力提升:利用边界框识别的物体级特征增强模型的识别能力。

指令调优训练:仅使用公开可用的多模态数据进行训练,提高模型的泛化能力。

两阶段训练过程:包括预训练、微调和评估,以优化模型性能。

支持DeepSpeed优化:使用DeepSpeed技术加速训练过程。

使用教程

1. 安装Python-3.10虚拟环境,并激活。

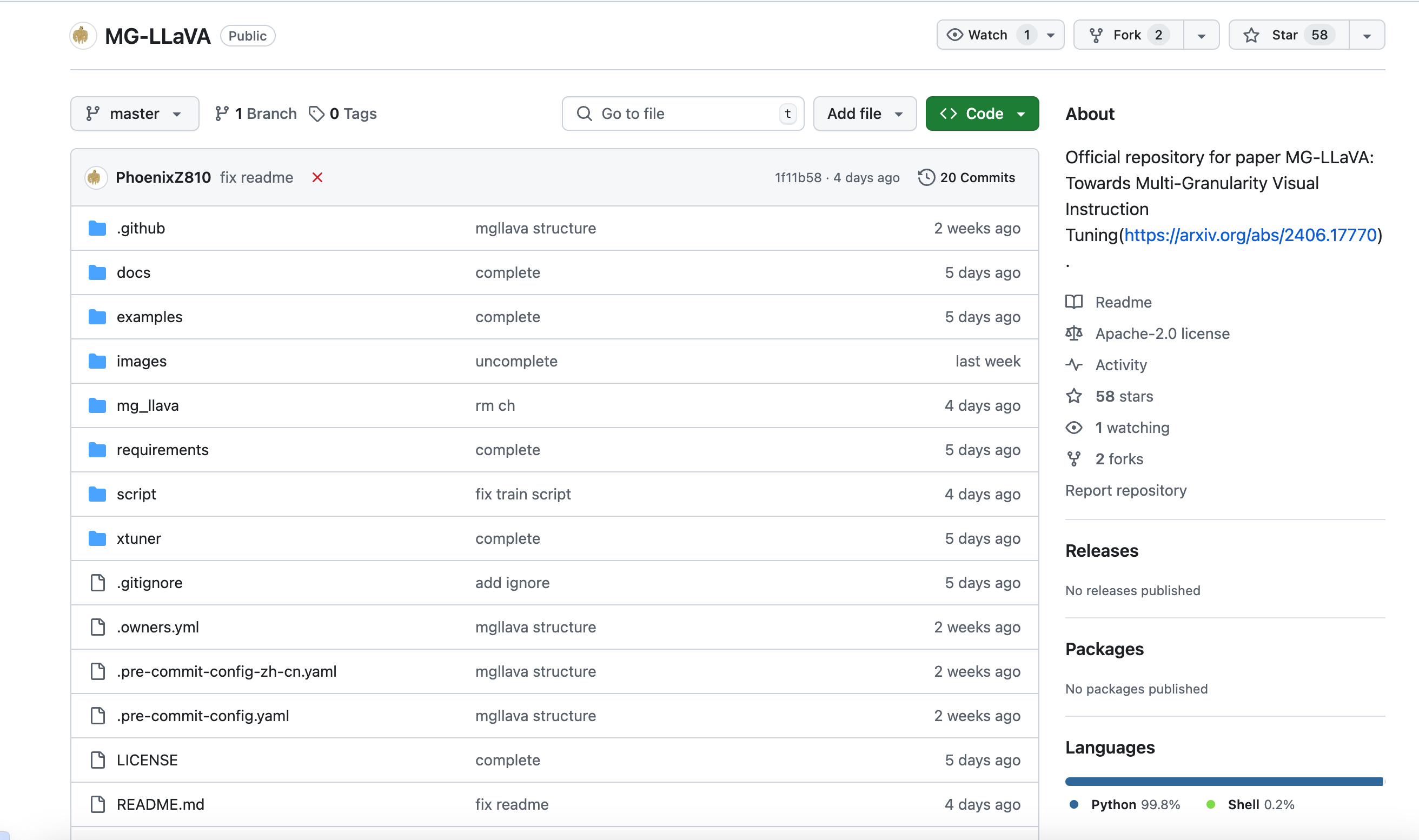

2. 从源代码安装XTuner。

3. 根据dataset_prepare.md准备数据。

4. 下载所需的LLM和CLIP检查点文件。

5. 根据个人设置修改配置文件中的变量。

6. 使用提供的脚本开始预训练、微调和评估过程。

7. 根据需要,将训练好的模型转换为Hugging Face模型格式。