使用场景

使用LLM Compiler对大型软件项目进行代码优化,减少最终程序的体积。

在编译器开发过程中,利用LLM Compiler预测不同优化策略对代码性能的影响。

在教育领域,作为教学工具,帮助学生理解编译器优化的原理和效果。

产品特色

预测LLVM优化对代码大小的影响

生成最小化代码大小的优化传递列表

从x86_64或ARM汇编代码生成LLVM IR

在编译器优化任务中实现高精度的代码仿真

提供7B和13B参数的模型以满足不同延迟需求

通过深度学习优化代码,提高程序效率和减小程序大小

使用教程

安装必要的库和依赖,例如transformers。

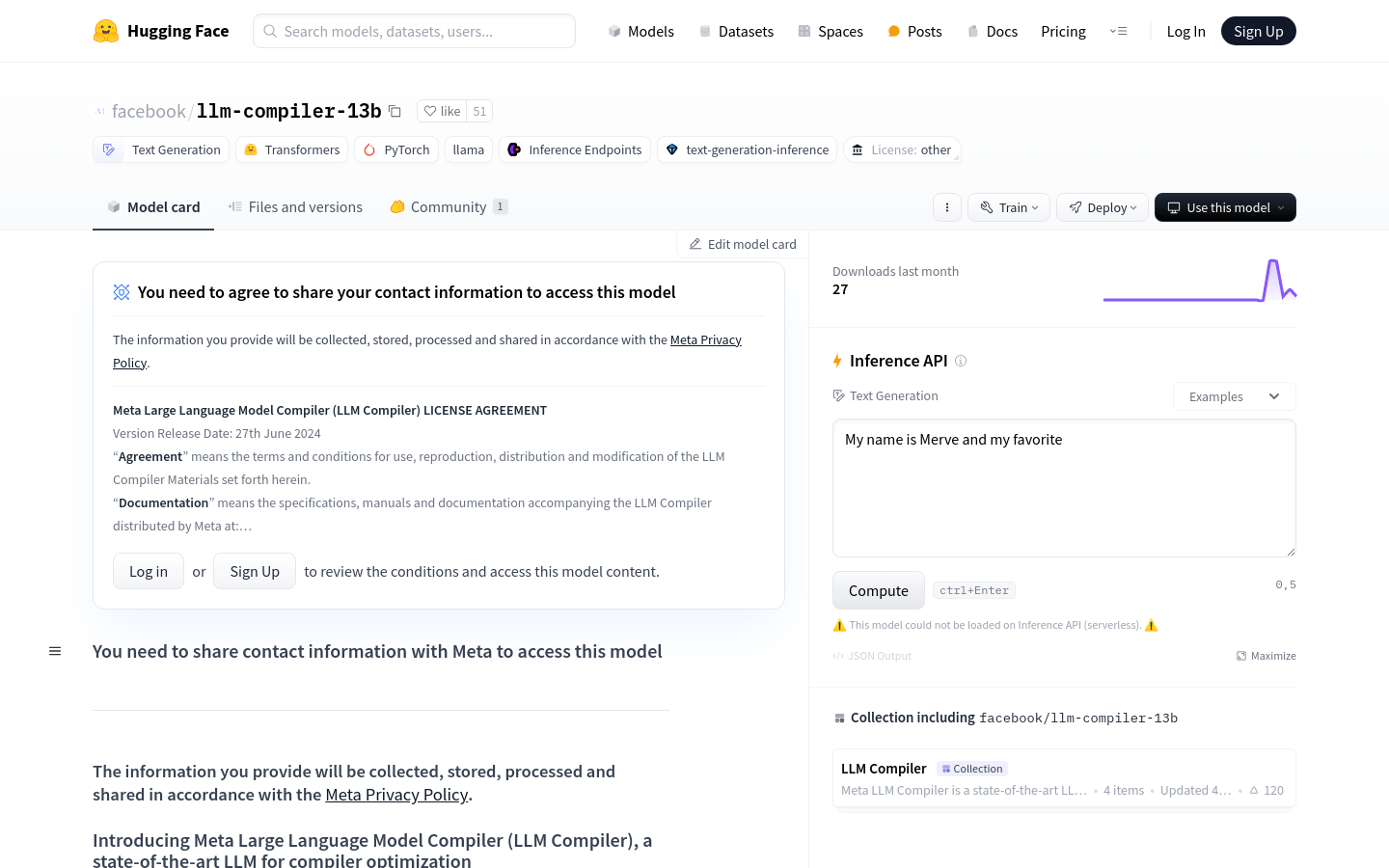

从Hugging Face下载所需的LLM Compiler模型。

使用AutoTokenizer从预训练模型中加载分词器。

设置transformers.pipeline进行文本生成,配置适当的参数。

通过pipeline输入待优化的代码片段,获取模型生成的优化建议。

根据模型输出的结果,对代码进行调整和优化。

对优化后的代码进行测试,确保优化效果符合预期。