使用场景

研究人员使用模型进行数学问题解答

企业利用模型进行客户服务的自动化对话

开发者通过模型实现个性化的聊天机器人

产品特色

支持1M超长上下文窗口,适合长文本任务处理

在数学推理方面具有同量级模型最优精度

工具调用能力升级,支持多轮调用完成复杂任务

支持从上百个网页搜集信息进行分析推理

通过LMDeploy和Transformers进行本地和流式生成推理

与vLLM兼容,可启动兼容OpenAI API的服务

使用教程

1. 安装必要的库,如torch和transformers。

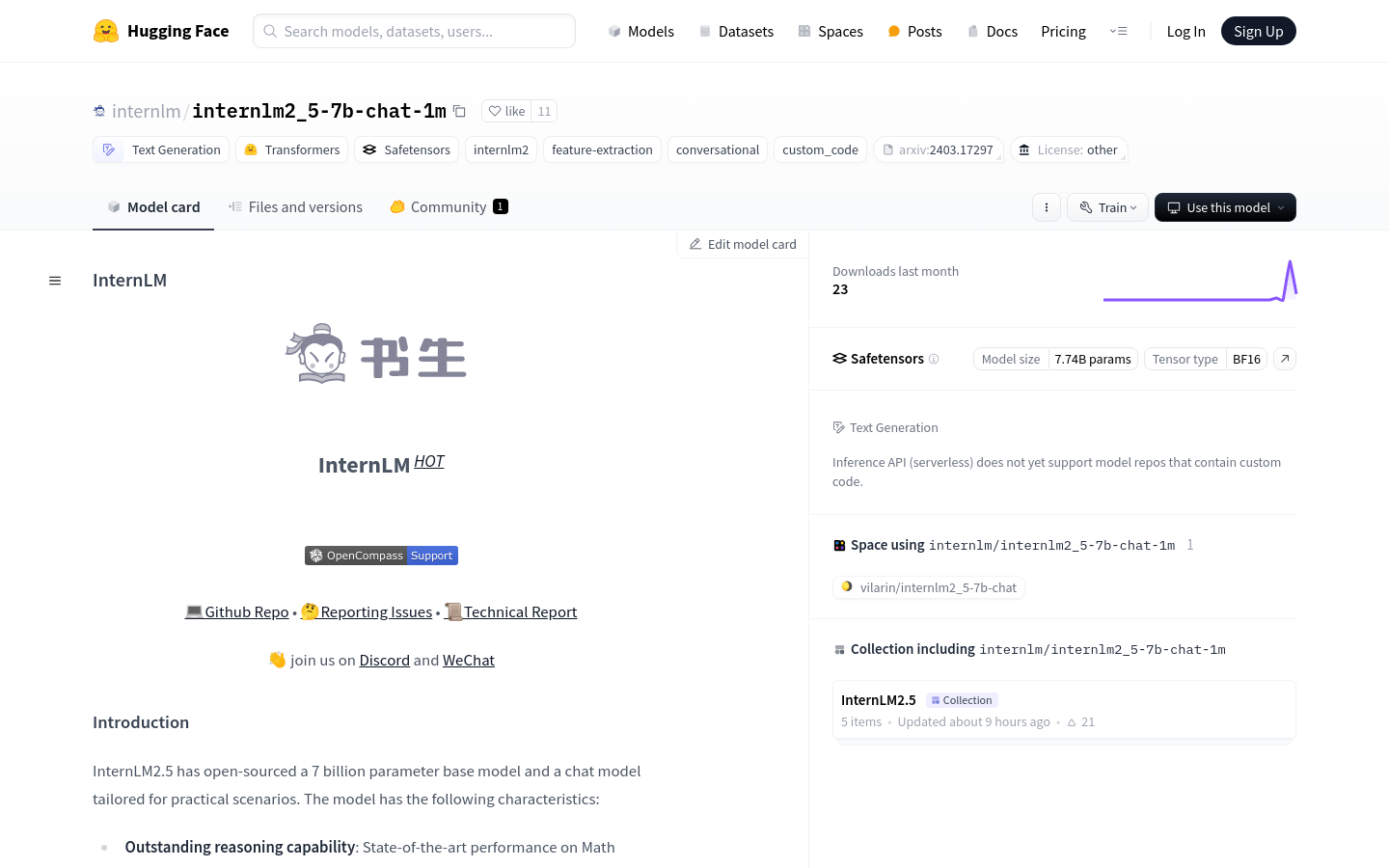

2. 使用AutoTokenizer和AutoModelForCausalLM从Hugging Face加载模型。

3. 设置模型精度为torch.float16以避免显存不足。

4. 通过chat或stream_chat接口与模型进行交互。

5. 使用LMDeploy进行1M超长上下文的本地批量推理。

6. 利用vLLM启动兼容OpenAI API的服务,进行更高级的模型部署。