使用场景

电影制作中,用于生成角色的动作场景。

游戏开发中,用于创建角色的动态表现。

虚拟现实中,用于生成与用户互动的虚拟角色动画。

产品特色

外观-姿态自适应(APPA层):在保持源图像外观的同时,维持来自冻结控制网的姿态信息。

时间控制网络:防止生成视频因突然和错误的姿态变化而崩溃。

姿态驱动的温度图:在推理阶段通过平滑时间层的注意力分数来减少静态区域的闪烁。

时间一致性:确保动画过程中人物姿态的连贯性。

泛化能力:能够适应不同领域和身份的动画生成。

背景保持:在动画过程中保持源图像背景的一致性。

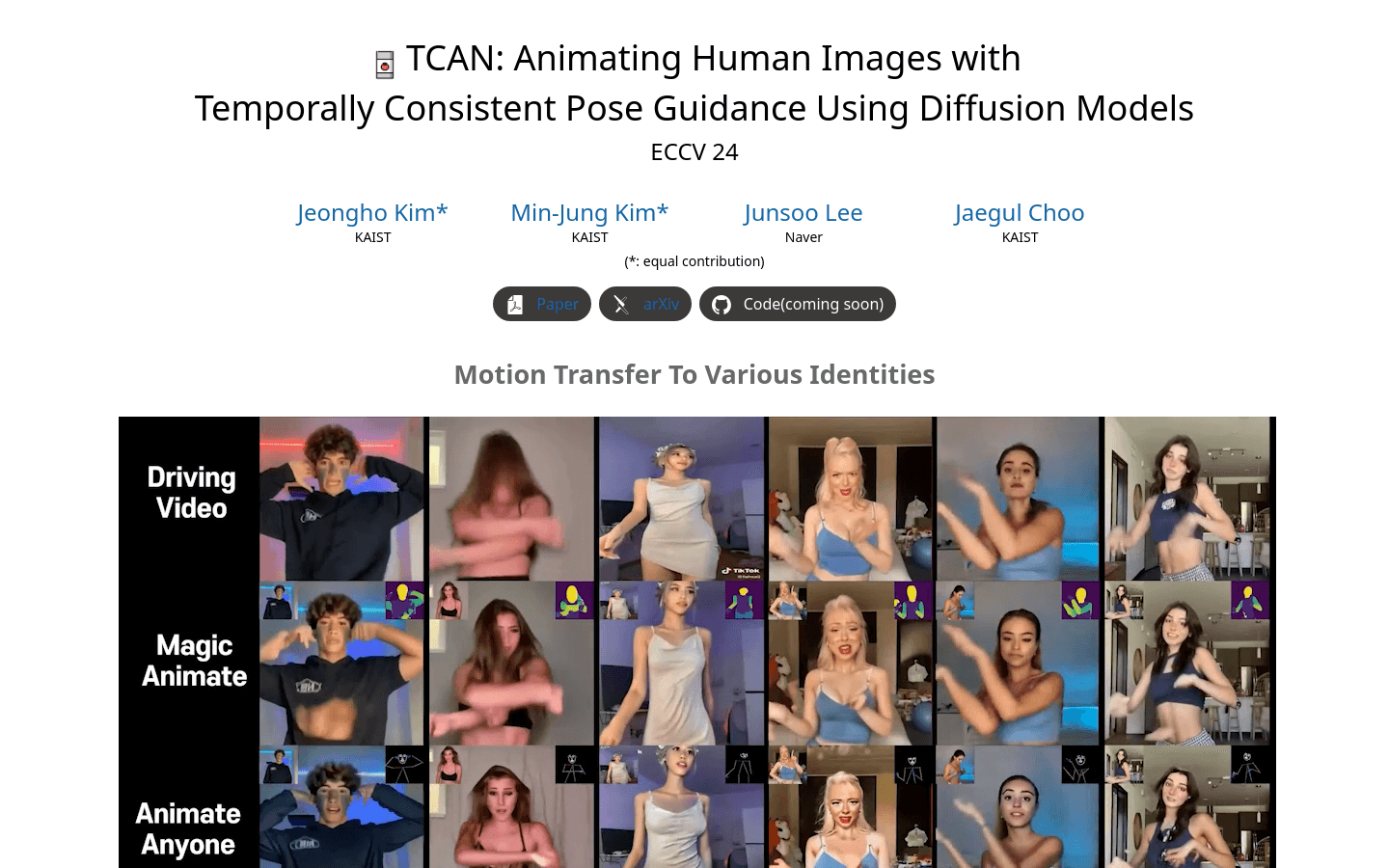

多身份动画:能够将动作转移到不同身份的人物或动画角色上。

使用教程

1. 准备源图像和驱动视频,确保它们包含所需的人物外观和动作。

2. 使用TCAN模型进行人像动画生成,输入源图像和驱动视频。

3. 调整TCAN模型中的参数,如APPA层的权重和时间控制网络的强度,以获得最佳动画效果。

4. 利用姿态驱动的温度图减少动画中的闪烁和不连贯现象。

5. 观察生成的动画,确保时间一致性和背景保持符合预期。

6. 根据需要进行微调,直至达到满意的动画效果。