使用场景

服装设计师使用IMAGDressing生成不同风格的服装效果图。

虚拟试衣软件开发者利用IMAGDressing实现用户在线试穿服装的功能。

研究人员使用IMAGDressing进行服装生成和虚拟试穿的相关研究。

产品特色

简单架构:生成逼真的服装并支持用户驱动的场景编辑。

灵活插件兼容性:与IP-Adapter、ControlNet、T2I-Adapter和AnimateDiff等扩展插件集成。

快速定制:无需额外LoRA训练即可在几秒内实现快速定制。

支持文本提示:根据不同场景支持文本提示。

支持指定区域的服装更换(实验性功能)。

支持与ControlNet和IP-Adapter结合使用。

提供IGPair数据集:包含超过30万对服装和穿着图像。

使用教程

1. 安装Python环境(推荐使用Anaconda或Miniconda)。

2. 安装PyTorch(版本需大于等于2.0.0)。

3. 安装CUDA(版本为11.8)。

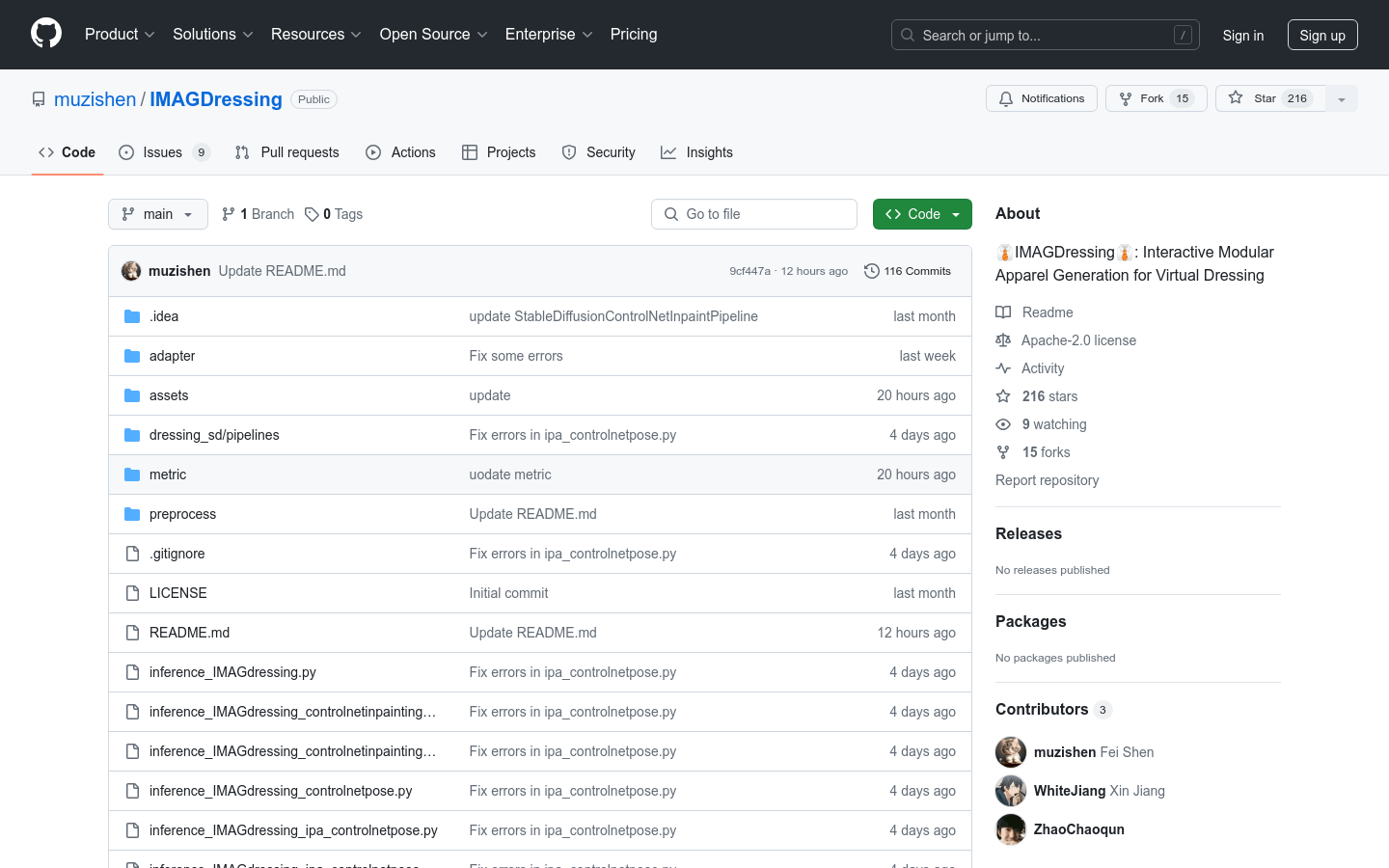

4. 克隆IMAGDressing的GitHub仓库。

5. 安装依赖库:运行`pip install -r requirements.txt`。

6. 下载并安装所需的模型文件,如humanparsing和openpose模型文件。

7. 运行IMAGDressing的推理代码,进行服装生成和虚拟试穿。

8. 根据需要,结合ControlNet、IP-Adapter等扩展插件,增强功能。