使用场景

研究人员可以使用IncarnaMind与他们的研究论文进行对话,快速获取所需信息。

开发者可以通过IncarnaMind与技术文档交互,解决编程中遇到的问题。

企业用户可以利用IncarnaMind进行知识管理,提高团队协作效率。

产品特色

自适应分块:动态调整窗口大小和位置,平衡细粒度和粗粒度数据访问。

多文档对话问答:支持简单和多跳查询,同时跨多个文档进行查询。

文件兼容性:支持PDF和TXT文件格式。

LLM模型兼容性:支持OpenAI GPT、Anthropic Claude、Llama2和其他开源LLMs。

系统要求:需要超过35GB的GPU RAM来运行GGUF量化版本。

开源和本地LLMs支持:推荐使用llama2-70b-chat模型,支持其他LLMs的实验。

即将发布:计划发布更小、成本效益更高的微调模型。

使用教程

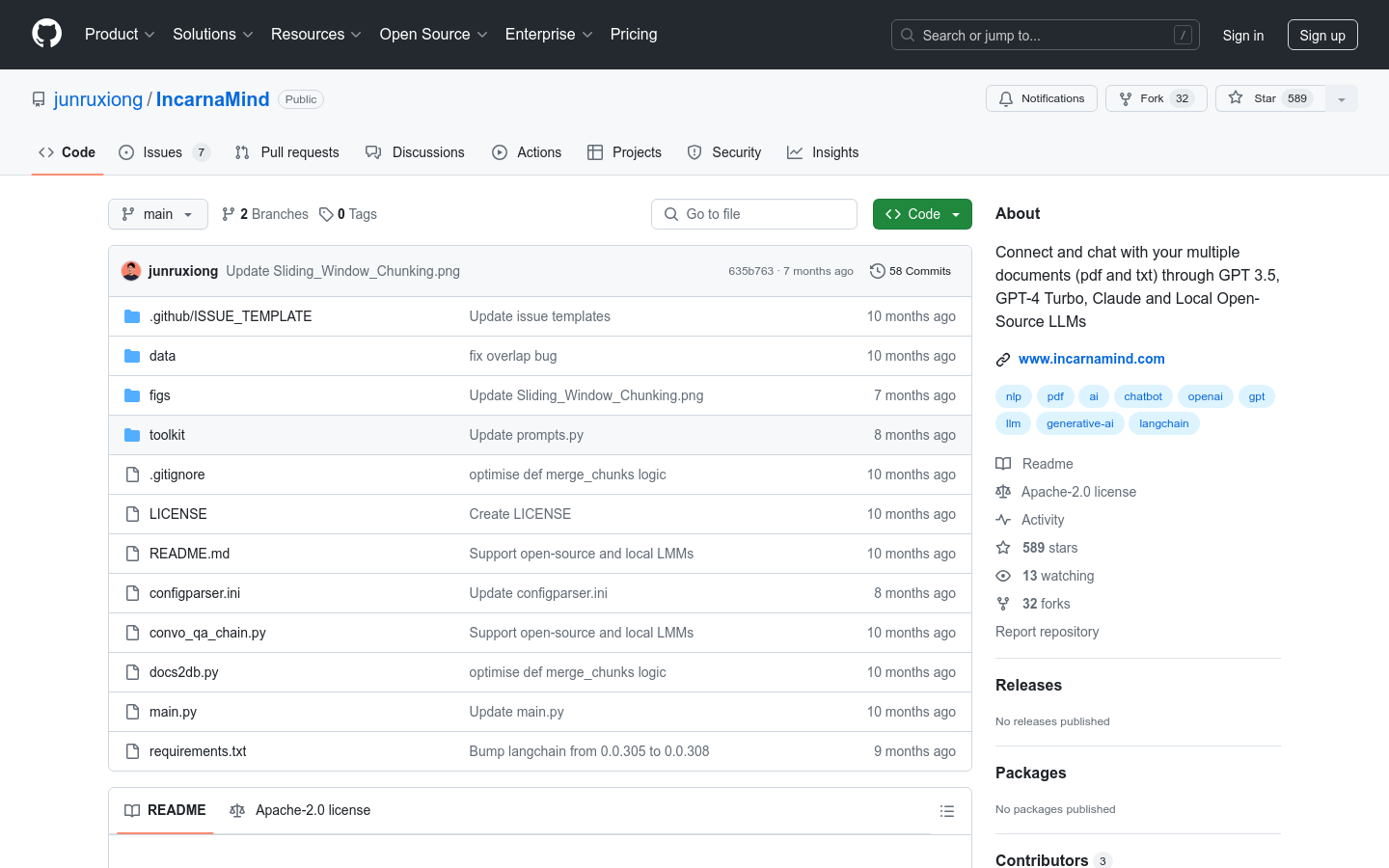

1. 安装:克隆仓库并设置Python环境。

2. 创建环境:使用Conda创建虚拟环境并激活。

3. 安装依赖:安装所有必需的依赖项。

4. 设置API密钥:在configparser.ini文件中设置API密钥。

5. 上传文件:将文件放入/data目录并运行命令处理文件。

6. 运行:启动对话,等待脚本提示输入。

7. 聊天:与系统进行交互,提出问题并获取答案。

8. 日志管理:系统会自动生成IncarnaMind.log文件,可以根据需要编辑日志设置。