使用场景

在多语言聊天机器人中使用以提供流畅的对话体验

用于生成技术文档或文章的草稿

在数据科学项目中进行语言模型的基准测试

产品特色

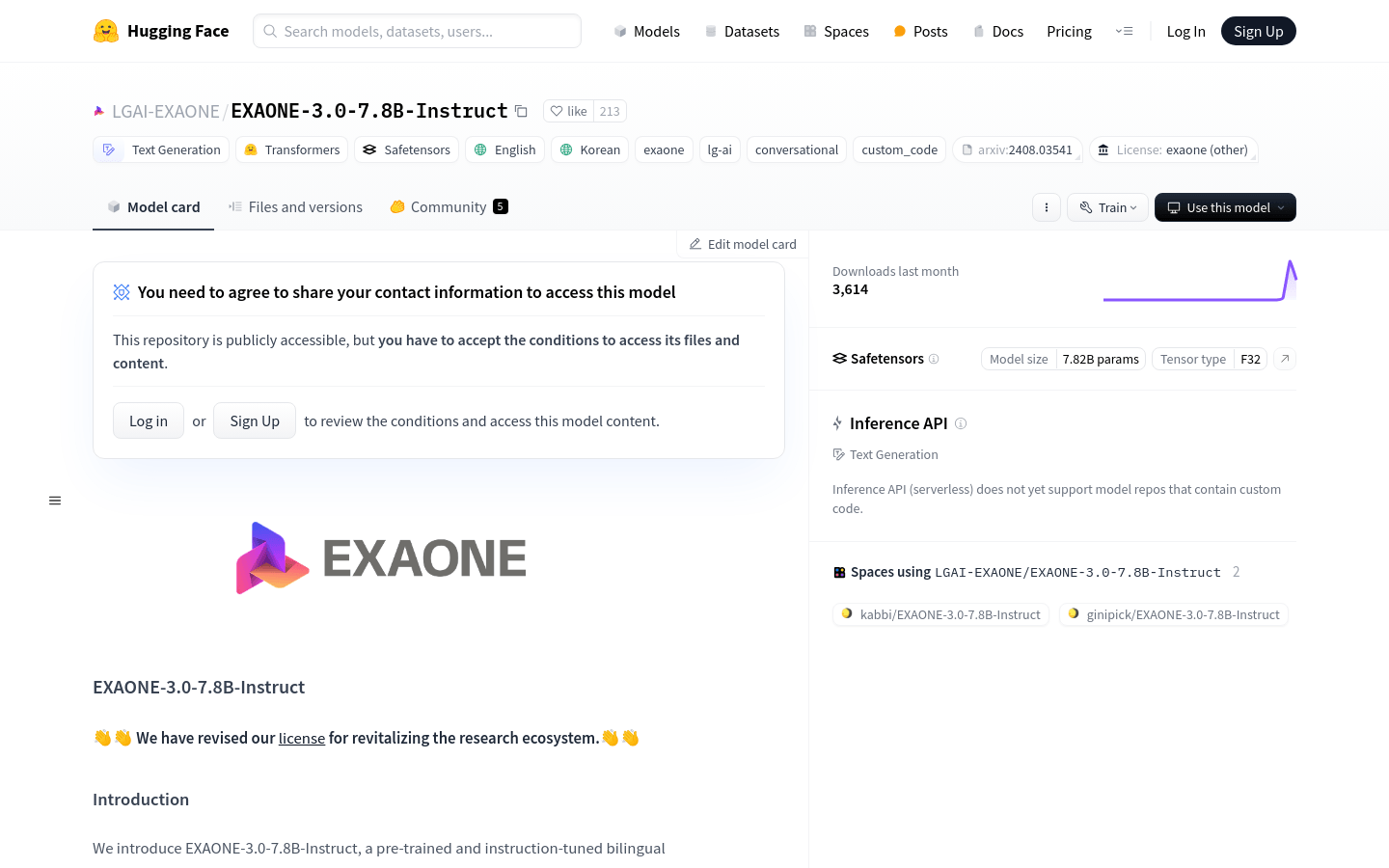

支持英语和韩语的文本生成

7.8亿参数的大规模语言模型

经过8T精选token的预训练

监督式微调和直接偏好优化

与同类模型相比具有竞争力的基准性能

适用于对话系统和文本生成任务

使用教程

1. 安装必要的库,如torch和transformers。

2. 从Hugging Face模型库中加载EXAONE-3.0-7.8B-Instruct模型。

3. 使用AutoTokenizer进行文本分词。

4. 选择或编写提示(prompt),以指导模型生成特定类型的文本。

5. 调用model.generate方法生成文本。

6. 使用tokenizer.decode方法将生成的文本解码回可读格式。

7. 根据需要调整参数,如max_new_tokens,以控制生成文本的长度。