使用场景

作为聊天机器人,提供多语言的对话生成。

在教育领域,用于生成教学材料或解答学生问题。

在编程辅助工具中,帮助开发者理解和生成代码。

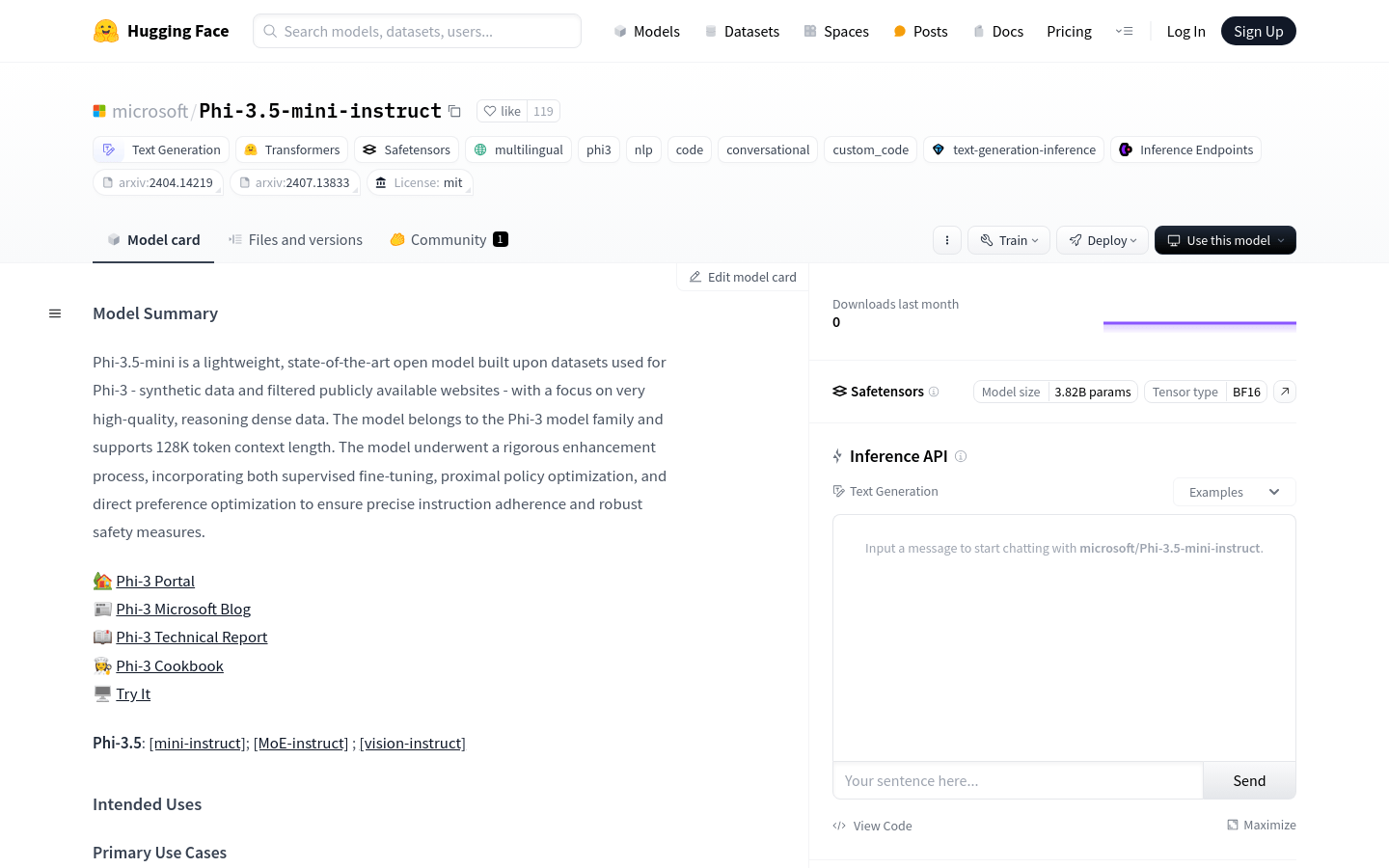

产品特色

支持多语言文本生成,适用于商业和研究用途。

适用于内存/计算受限环境和延迟敏感场景。

强大的推理能力,特别是在代码、数学和逻辑方面。

支持长上下文任务,包括长文档/会议摘要、长文档问答和长文档信息检索。

通过监督式微调和直接偏好优化,提高指令遵循和安全性。

集成了Flash-Attention技术,支持在特定GPU硬件上运行。

使用教程

1. 安装必要的Python库,如torch和transformers。

2. 使用pip命令安装Phi-3.5-mini-instruct模型。

3. 导入AutoModelForCausalLM和AutoTokenizer类。

4. 从预训练模型库中加载Phi-3.5-mini-instruct模型和分词器。

5. 准备输入数据,例如用户的问题或指令。

6. 使用模型生成文本或执行指定的推理任务。

7. 根据需要调整生成参数,如最大新token数、温度等。

8. 打印或进一步处理生成的文本输出。