使用场景

开发者使用x-flux-comfyui在ComfyUI中实现自定义的图像风格转换模型。

研究者利用其低内存模式在资源受限的设备上运行深度学习模型。

通过IP Adapter功能,艺术家结合CLIP模型生成具有特定风格的图像作品。

产品特色

支持ComfyUI自定义节点扩展,增强用户界面的交互性。

提供模型训练和加载功能,方便用户自定义和使用AI模型。

支持低内存模式,优化VRAM使用,适应不同硬件环境。

集成IP Adapter,与OpenAI的VIT CLIP模型结合,提升图像生成效果。

提供多种预训练模型下载,简化用户部署和使用流程。

支持通过Git进行版本控制和更新,保持工具的持续迭代。

使用教程

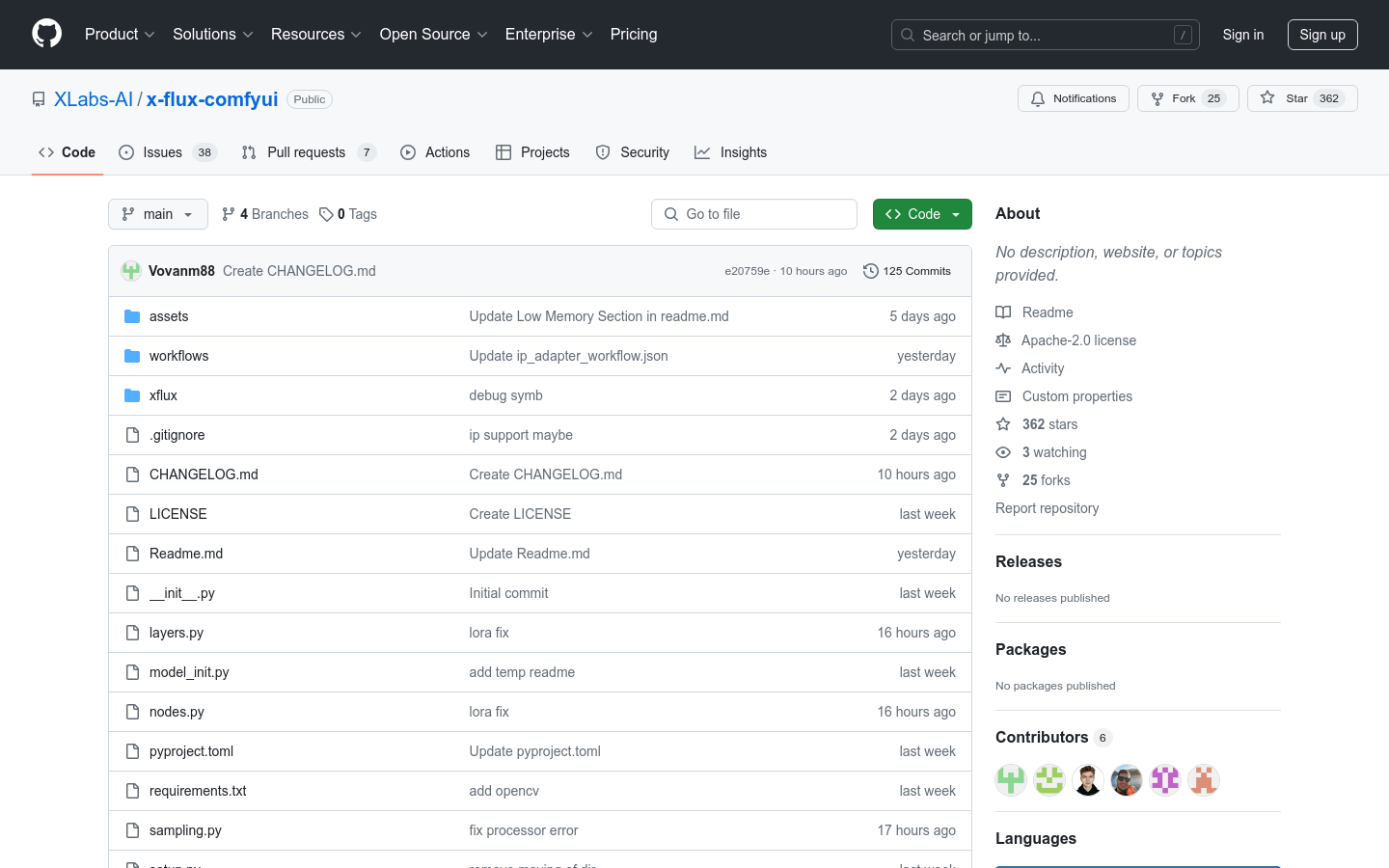

访问x-flux-comfyui的GitHub页面,克隆或下载代码。

按照README中的安装指南,将插件放置到ComfyUI的自定义节点目录下。

运行`setup.py`脚本来完成插件的安装。

启动ComfyUI,通过用户界面访问和使用x-flux-comfyui提供的模型和功能。

根据需要下载并安装额外的预训练模型或IP Adapter。

使用Git命令`git pull`来更新插件到最新版本。