使用场景

用于生成多语言的新闻报道。

在教育领域,辅助生成多语言的教学材料。

在跨语言的客服系统中,提供多语言的自动回复。

产品特色

支持多语言文本生成,涵盖中、英、俄、西等40多种语言。

采用MoE架构,通过专家层扩展提升模型性能。

使用8K长度的训练样本,提高模型处理长文本的能力。

精细化的数据采样比例和动态数据切换策略,优化模型学习效果。

定制优化的MoE模型训练框架,提升计算效率。

设计了计算、通信和CPU-Offload的Overlap处理方式,提高整体吞吐量。

使用教程

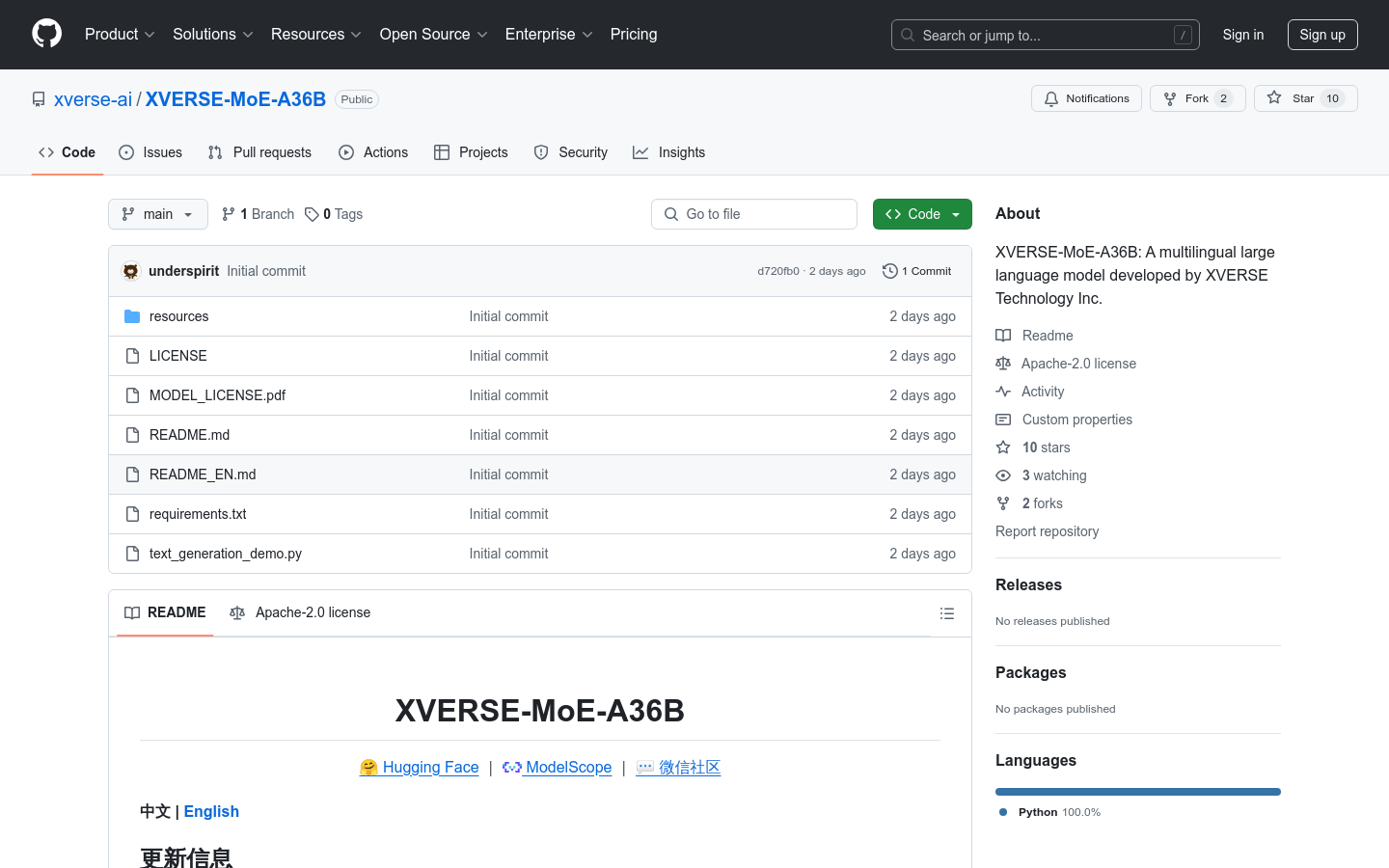

1. 访问GitHub仓库页面,下载XVERSE-MoE-A36B模型。

2. 使用pip安装必要的依赖库。

3. 通过Transformers库加载模型和分词器。

4. 编写代码,使用模型进行文本生成。

5. 根据需要调整模型参数,如最大生成词数、重复惩罚等。

6. 运行代码,获取模型生成的文本结果。