使用场景

用于实时语音到文本的转换,提高会议记录的效率

集成到移动应用中,提供多语言的语音翻译服务

用于转录和分析采访、讲座等长格式的语音内容

产品特色

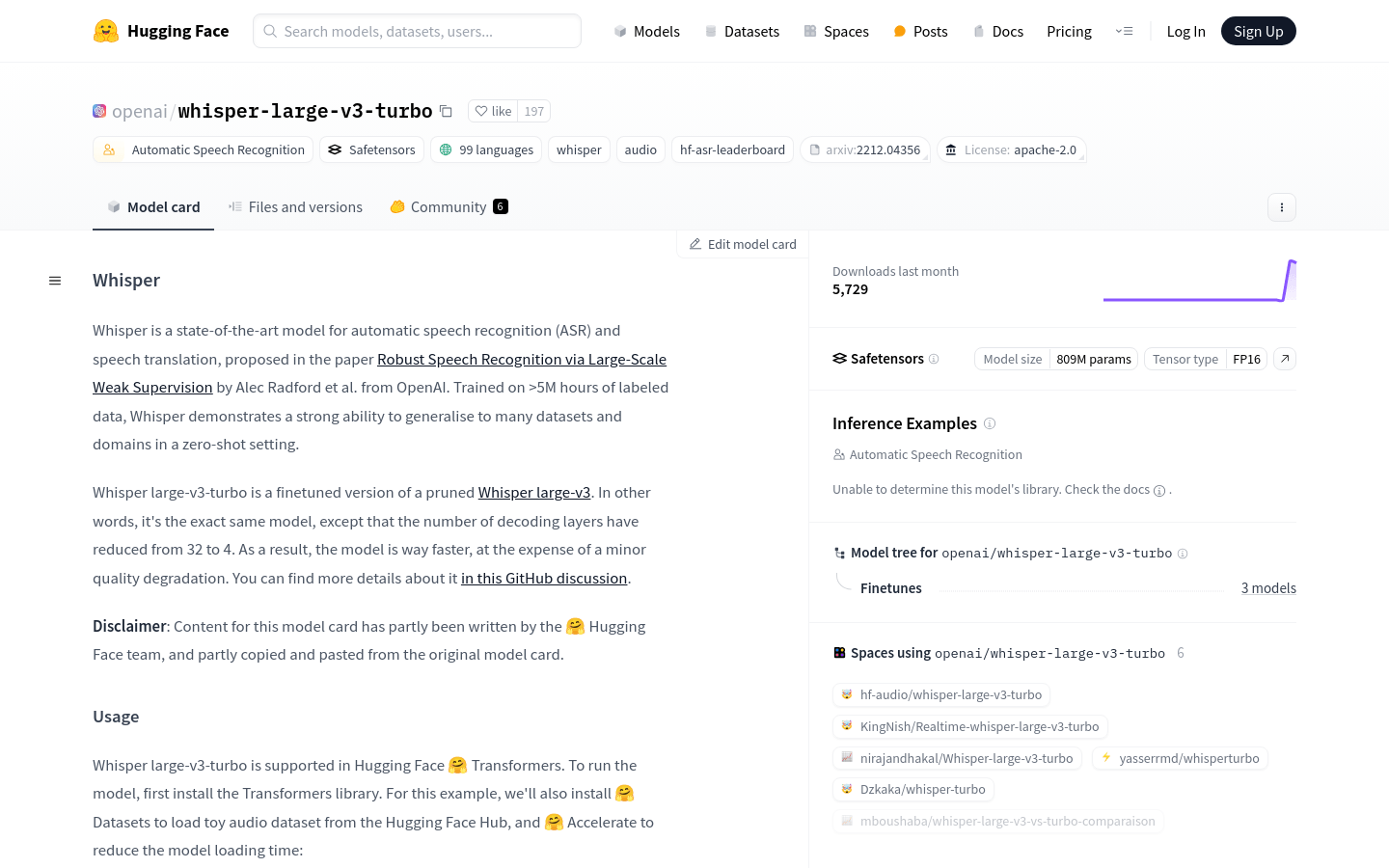

支持99种语言的语音识别和翻译

能够在零样本设置中泛化到多个数据集和领域

通过减少解码层数量提高模型运行速度

支持长音频文件的逐块处理

兼容所有Whisper解码策略,如温度回落和基于前一个token的条件

自动预测源音频的语言

支持语音转录和语音翻译任务

能够预测时间戳,提供句子级或单词级的时间标记

使用教程

首先,安装Transformers库以及Datasets和Accelerate库。

使用AutoModelForSpeechSeq2Seq和AutoProcessor从Hugging Face Hub加载模型和处理器。

通过pipeline类创建一个用于自动语音识别的管道。

加载并准备音频数据,可以是来自Hugging Face Hub的示例数据集或本地音频文件。

调用管道并将音频数据作为输入,获取转录结果。

如果需要,可以通过设置generate_kwargs参数来启用额外的解码策略。

如果需要进行语音翻译,可以通过设置task参数为'translate'来指定任务类型。

如果需要预测时间戳,可以设置return_timestamps参数为True。