使用场景

研究人员使用此模型在自然语言处理任务中生成更准确的回答。

开发者将模型集成到聊天机器人中,以提供更自然和有帮助的对话体验。

企业使用模型优化客户服务系统,通过自动回答常见问题来提升客户满意度。

产品特色

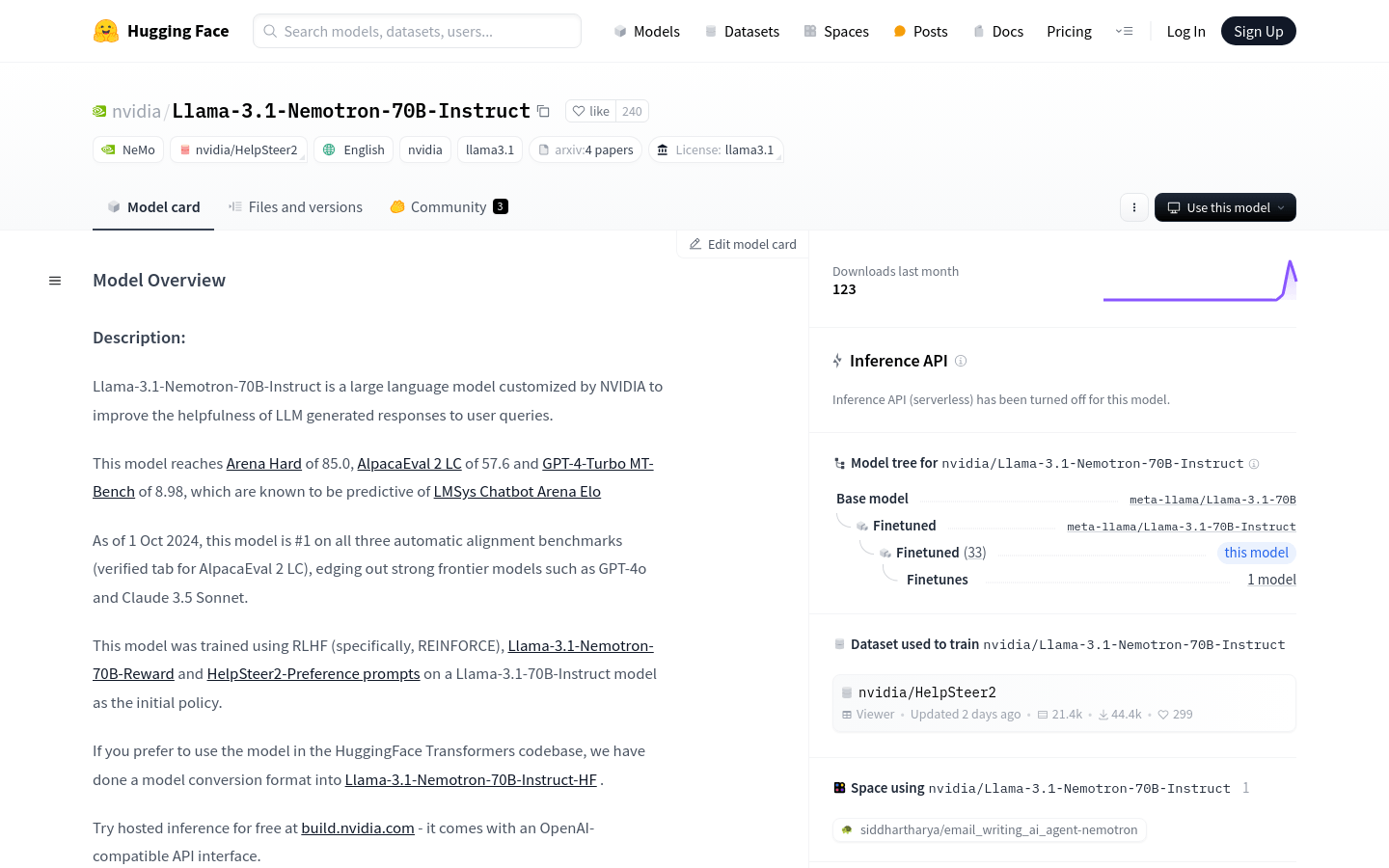

在Arena Hard、AlpacaEval 2 LC和MT-Bench基准测试中表现优异。

使用RLHF和REINFORCE算法进行训练,提高回答的准确性和帮助性。

提供了与HuggingFace Transformers代码库兼容的模型转换格式。

可通过NVIDIA的build平台进行免费托管推理,具有OpenAI兼容的API接口。

模型在处理通用领域指令时表现出色,尽管未针对特定领域如数学进行优化。

支持通过NVIDIA NeMo Framework进行部署,该框架基于NVIDIA TRT-LLM提供高吞吐量和低延迟的推理解决方案。

需要至少4个40GB或2个80GB的NVIDIA GPU以及150GB的空闲磁盘空间。

使用教程

1. 注册并获取NVIDIA NeMo Framework容器的免费且立即访问权限。

2. 如果没有NVIDIA NGC API密钥,登录NVIDIA NGC生成API密钥。

3. 使用docker登录nvcr.io并拉取所需的容器。

4. 下载模型的checkpoint。

5. 运行Docker容器,并设置环境变量HF_HOME。

6. 在容器内启动服务器,进行模型转换和部署。

7. 服务器准备就绪后,使用客户端代码进行查询。