使用场景

- 使用该模型创建虚拟主播,进行新闻播报。

- 在教育领域,创建虚拟教师进行在线授课。

- 在娱乐行业,制作虚拟偶像进行表演。

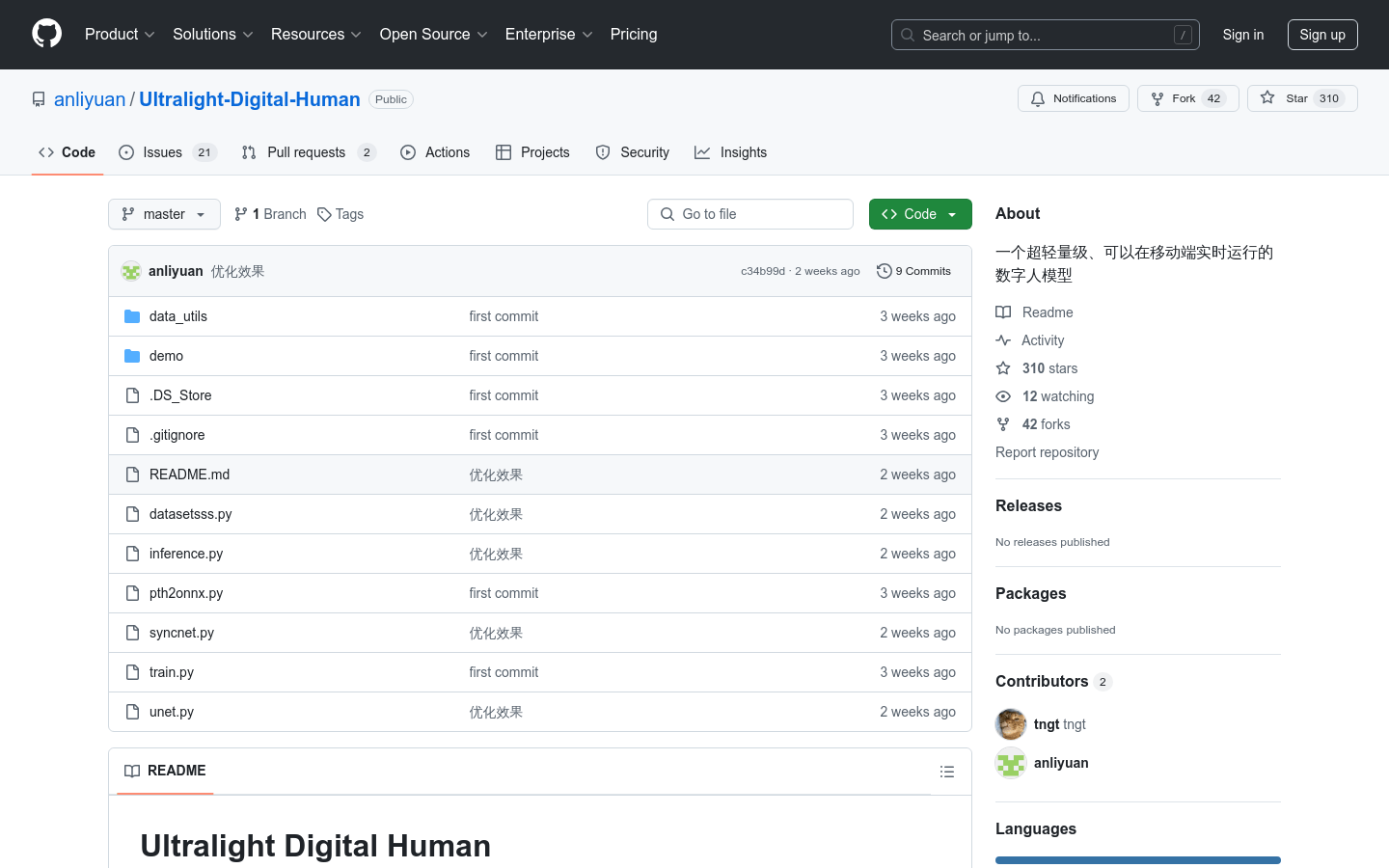

产品特色

- 移动端实时运行:模型设计轻量,能够在移动设备上流畅运行。

- 开源代码:所有代码开源,便于社区贡献和改进。

- 易于训练:提供详细的训练步骤,用户可以轻松训练自己的数字人模型。

- 支持多种音频特征提取器:包括wenet和hubert,用户可以根据需要选择。

- 流式推理支持:模型支持流式推理,适用于实时应用场景。

- 代码优化:持续优化代码,提高模型效果和运行效率。

- 社区支持:活跃的社区支持,用户可以通过issue和PR参与模型的改进。

使用教程

1. 安装必要的库和环境,如PyTorch和其他依赖。

2. 下载wenet encoder.onnx文件,并放入指定目录。

3. 准备视频和音频数据,并进行预处理。

4. 训练syncnet以获得更好的效果。

5. 使用训练好的syncnet模型来训练数字人模型。

6. 提取测试音频特征,并进行推理。

7. 合并音频和视频,生成最终的数字人视频。

8. 享受你的数字人模型带来的成果。