使用场景

电影故事板生成:通过In-Context LoRA生成一系列具有连贯故事情节的图像。

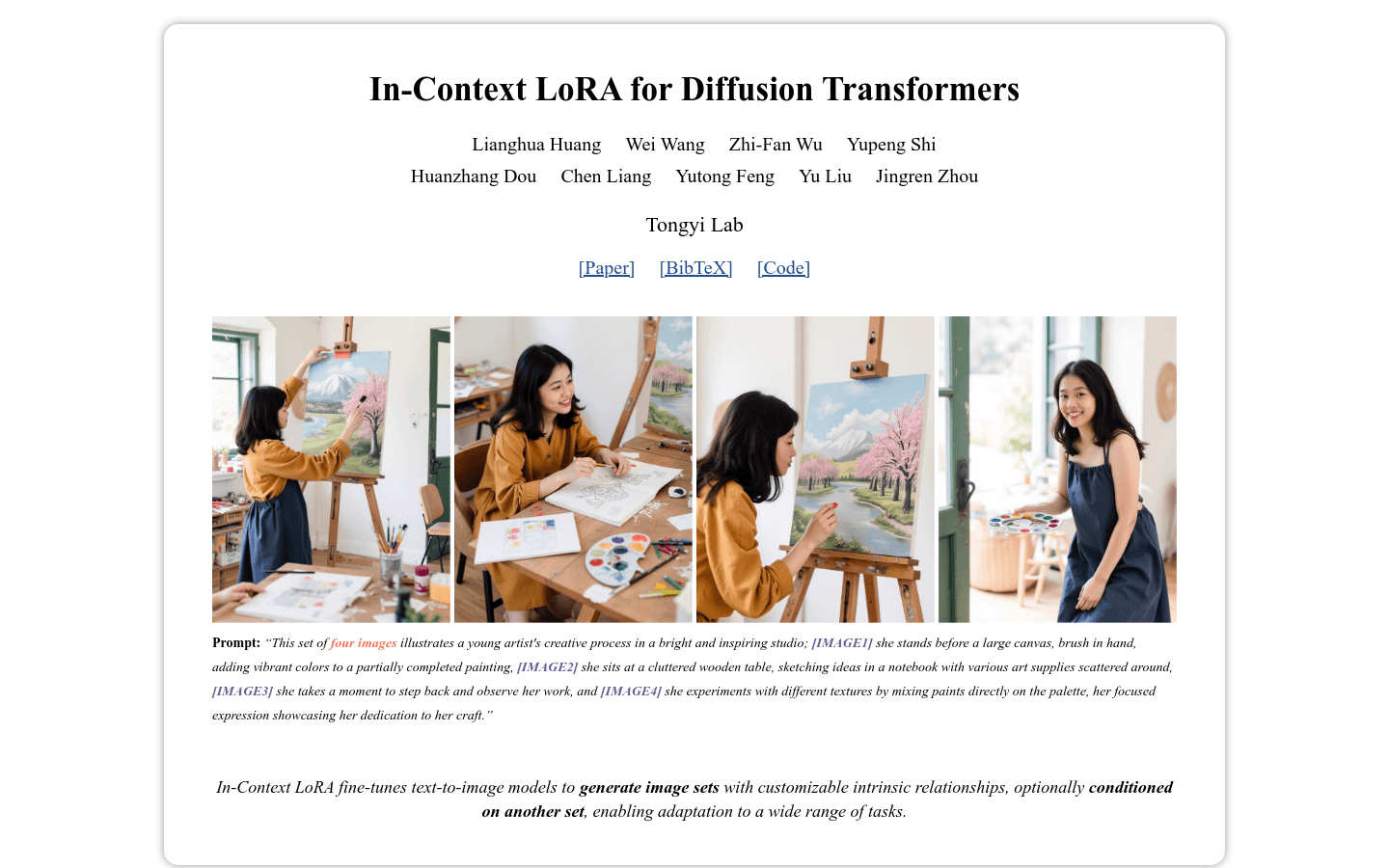

人像摄影:生成一系列保持人物身份一致的人像照片。

字体设计:生成一系列具有一致字体风格的图像,适用于品牌设计。

产品特色

• 联合描述多张图像:通过将多张图像合并为一个输入,而不是单独处理,提高了图像生成的相关性和一致性。

• 任务特定的LoRA微调:使用小数据集(20-100个样本)进行微调,而不是使用大数据集进行全面参数调整。

• 生成高保真度图像集合:通过优化训练数据,生成的图像集合更符合提示要求,提高了图像质量。

• 保持任务无关性:虽然在特定任务上进行微调,但整体架构和流程保持任务无关,增加了模型的通用性。

• 无需修改原始DiT模型:只需改变训练数据,无需对原始模型进行任何改动,简化了微调过程。

• 支持多种图像生成任务:包括电影故事板生成、人像摄影、字体设计等,展现了模型的多样性和灵活性。

使用教程

1. 准备一组图像和相应的描述文本。

2. 使用In-Context LoRA模型对图像和文本进行联合描述。

3. 根据特定任务选择一个小数据集进行LoRA微调。

4. 调整模型参数,直到生成的图像集合满足质量要求。

5. 将微调后的模型应用于新的图像生成任务。

6. 评估生成的图像集合是否符合预期的提示和质量标准。

7. 如有需要,进一步微调模型以改进图像生成结果。