使用场景

在移动设备上实现文本生成和理解功能。

作为聊天机器人的后端模型,提供流畅的对话体验。

集成到智能家居设备中,提升语音交互的准确性和自然性。

产品特色

• 优化的Transformer架构:专为设备端应用设计的轻量级模型。

• 支持零样本常识推理任务:在多个常识推理任务上展现出色性能。

• 集成关键技术:包括SwiGLU激活函数、深度薄架构等。

• 支持HuggingFace平台:可通过HuggingFace平台加载预训练模型进行微调或评估。

• 提供MobileLLM代码库:包含预训练代码,方便用户进行自定义训练和评估。

• 支持多种模型尺寸:从125M到1.5B参数的多种模型尺寸可供选择。

• 训练成本效益:在1T tokens数据上的训练时间从3天到18天不等,取决于模型大小。

使用教程

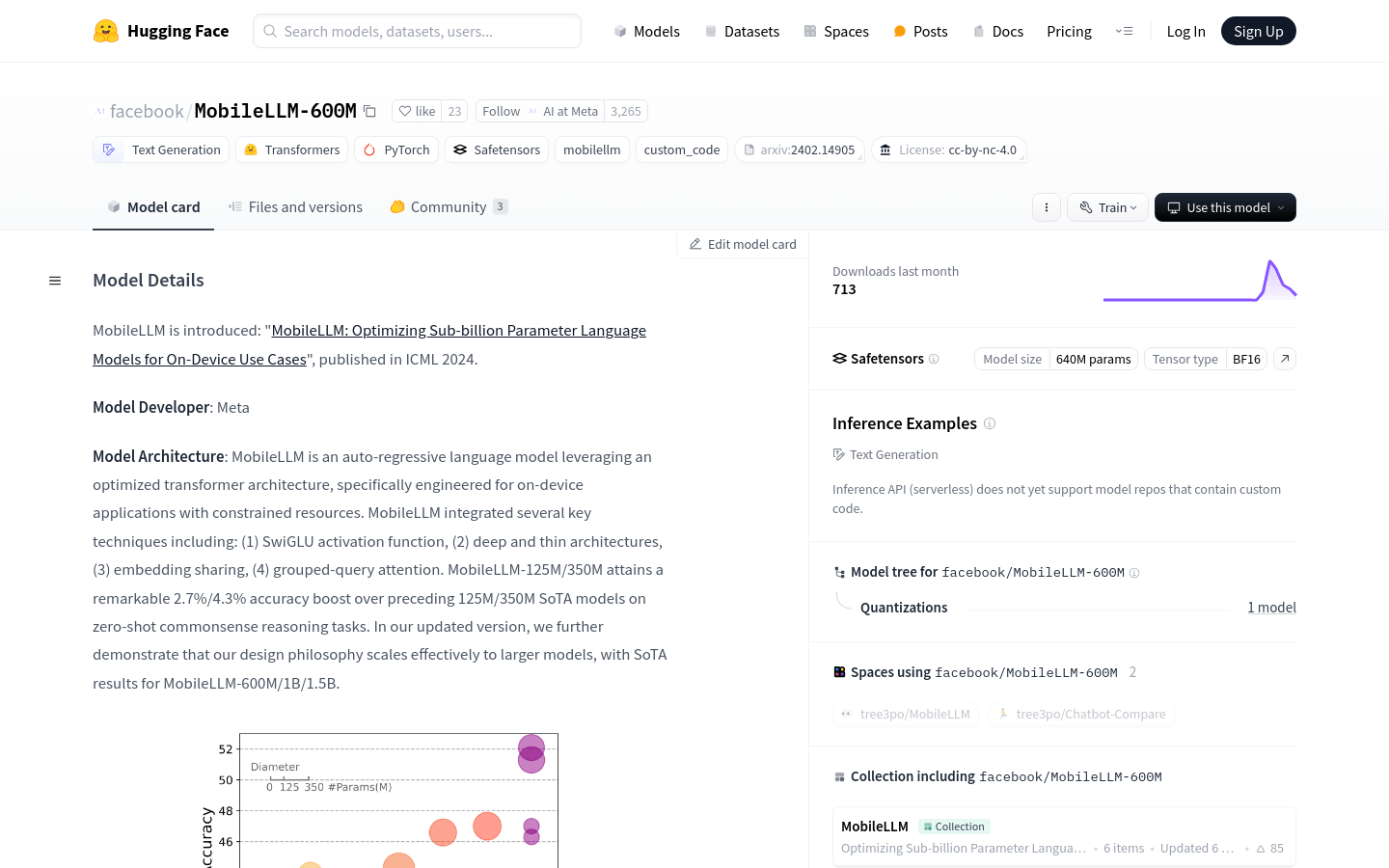

1. 访问HuggingFace官网并搜索MobileLLM-600M模型。

2. 通过HuggingFace平台加载预训练的MobileLLM-600M模型,使用提供的代码示例进行模型加载。

3. 如果需要进行微调或评估,可以按照HuggingFace的指南添加特殊标记。

4. 访问MobileLLM的GitHub代码库,克隆代码并安装依赖。

5. 根据代码库中的指南进行数据预处理,并指定数据路径。

6. 运行预训练脚本开始训练模型,或使用评估脚本来计算Wikitext-2测试集的困惑度。

7. 根据需要调整模型参数和训练设置,以适应特定的应用场景。