使用场景

案例一:数据科学家使用LLaMA-O1进行奥林匹克数学问题的推理和求解。

案例二:机器学习工程师利用LLaMA-O1框架进行自我强化学习模型的训练和优化。

案例三:研究人员使用LLaMA-O1进行大型语言模型的推理和评估,探索新的算法和应用。

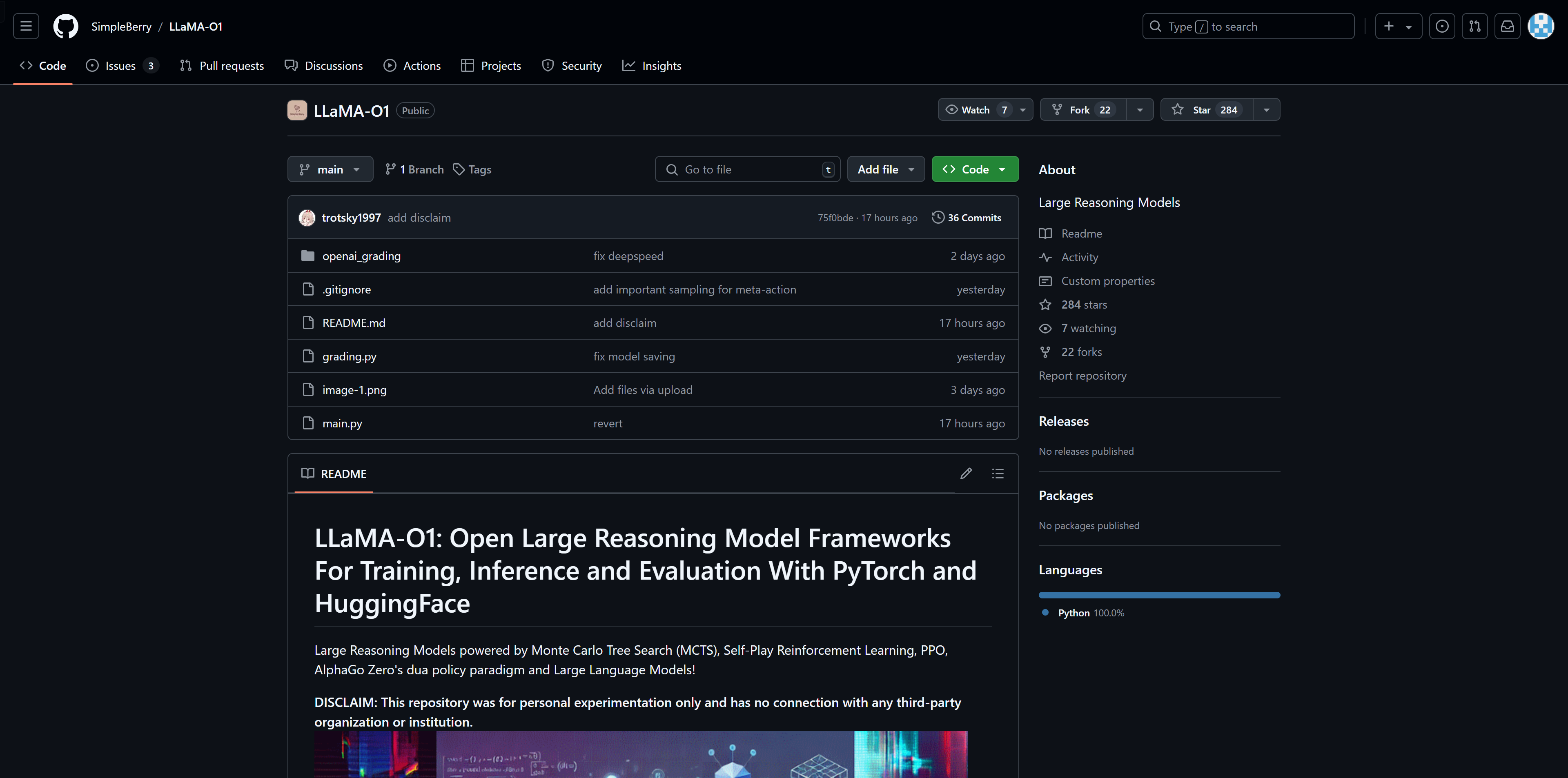

产品特色

• 支持蒙特卡洛树搜索(MCTS)进行推理优化。

• 集成自我强化学习技术,提高模型的自我学习能力。

• 采用PPO算法,增强模型的策略优化能力。

• 借鉴AlphaGo Zero的策略范式,提升模型的决策质量。

• 支持PyTorch和HuggingFace,方便开发者使用和集成。

• 提供个人实验平台,允许用户进行自定义训练和评估。

• 提供了从AlphaGO Zero到RLHF的教程和指导。

• 支持使用LLaMaFactory进行预训练。

使用教程

1. 安装必要的环境:使用pip安装torch、transformers、accelerate、peft和datasets。

2. 克隆代码:通过git clone命令克隆LLaMA-O1的代码库到本地。

3. 进入目录:使用cd命令进入LLaMA-O1的目录。

4. 拉取最新代码:执行git pull命令以确保代码是最新的。

5. 运行训练:使用python main.py命令开始模型的训练。

6. 使用Accelerate:如果需要,可以通过accelerate config和accelerate launch main.py命令来运行训练。

7. 推理和评估:根据需要使用模型进行推理和评估任务。