使用场景

开发者使用Qwen2.5-Coder-7B自动补全代码,提高编码速度。

代码审查过程中,利用模型的代码推理能力发现潜在的代码问题。

在维护大型代码库时,使用模型的长上下文支持功能处理复杂的代码依赖关系。

产品特色

代码生成:显著提升代码生成能力,帮助开发者快速实现代码逻辑。

代码推理:增强模型对代码逻辑的理解,提高代码审查和优化的效率。

代码修复:自动检测并修复代码中的错误,减少调试时间。

长上下文支持:支持长达128K令牌的上下文,适合处理大型代码库。

基于Transformers架构:采用先进的RoPE、SwiGLU、RMSNorm和Attention QKV偏置技术。

参数数量:拥有7.61B个参数,其中非嵌入参数为6.53B。

层数和注意力头数:共有28层,Q和KV的注意力头数分别为28和4。

使用教程

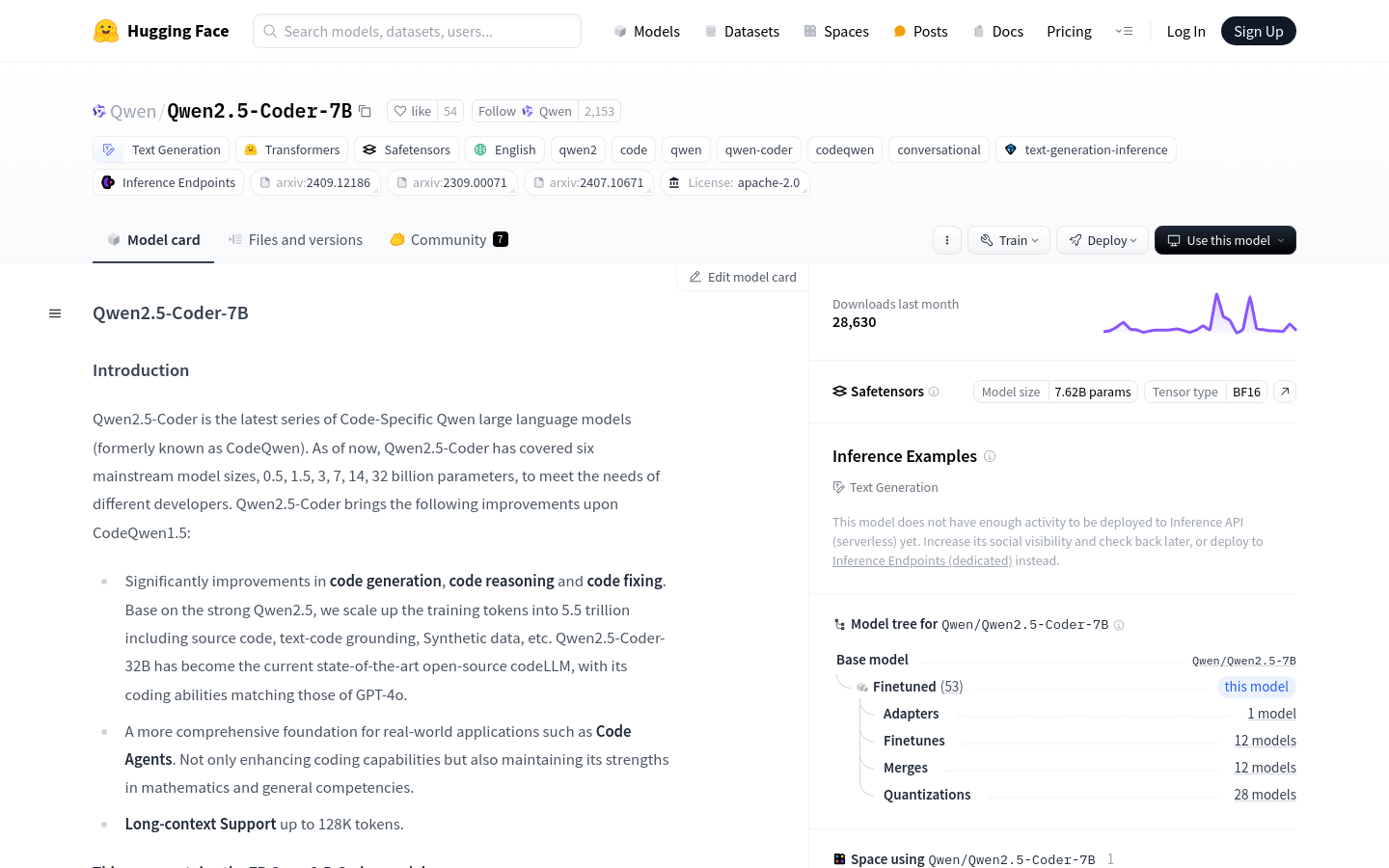

1. 访问Hugging Face平台并搜索Qwen2.5-Coder-7B模型。

2. 阅读模型卡片,了解模型的详细信息和使用条件。

3. 根据项目需求,下载或直接在平台上部署模型。

4. 使用Hugging Face的Transformers库加载模型,并配置好环境。

5. 输入代码相关的查询或指令,模型将生成相应的代码或提供代码相关的推理。

6. 根据模型输出的结果,进行必要的调整和优化。

7. 在实际项目中应用生成或优化后的代码,提高开发效率。

8. 根据需要,对模型进行微调,以适应特定的开发环境或需求。