使用场景

在DocVQA数据集上,Pixtral-Large-Instruct-2411能够准确理解文档内容并回答问题。

在MathVista上,模型能够解决复杂的数学问题,展现了其在数学理解方面的能力。

在VQAv2数据集上,模型能够识别图像中的视觉元素,并回答相关问题。

产品特色

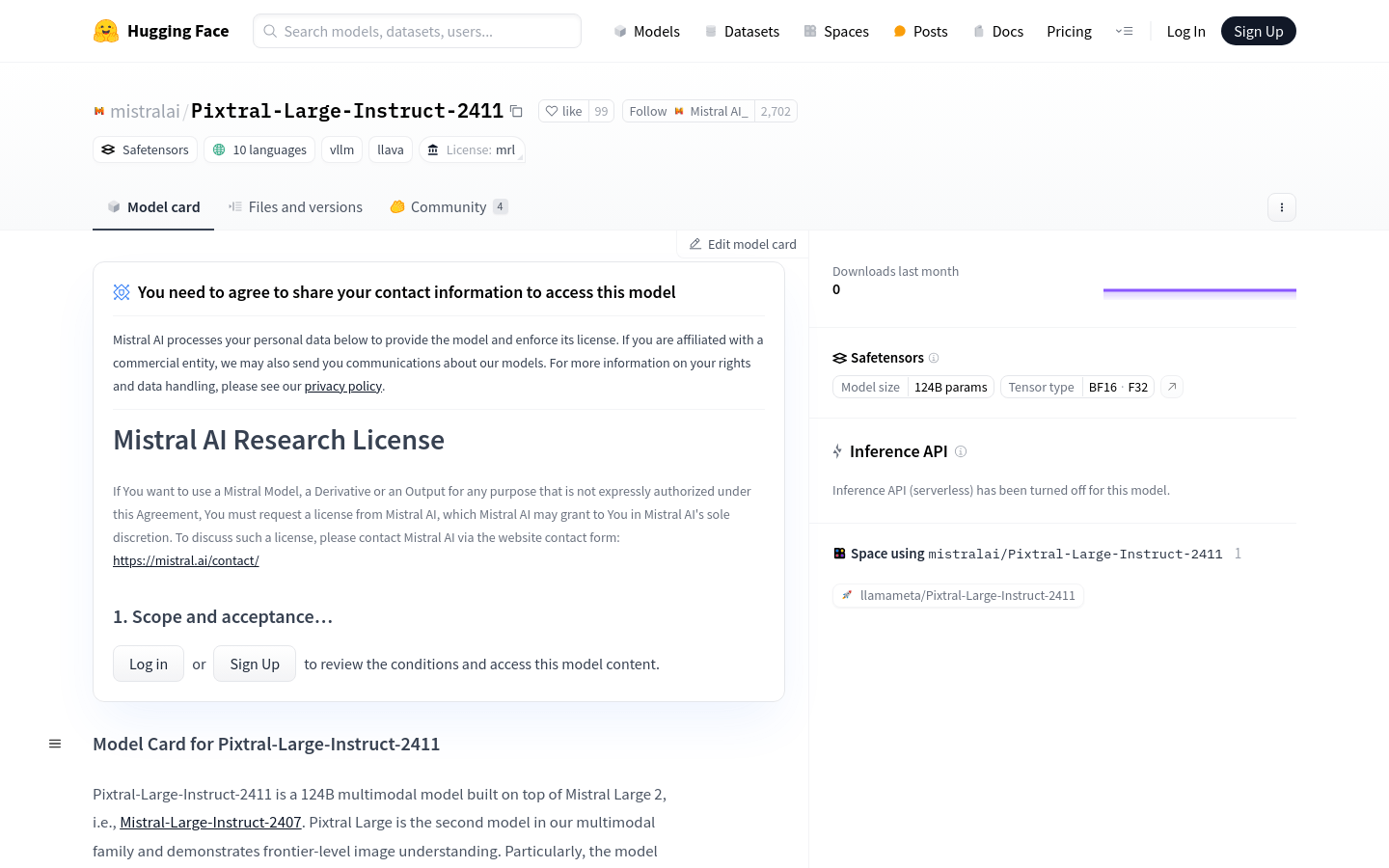

前沿级多模态性能:在多个图像理解数据集上达到领先成绩。

扩展Mistral Large 2:在不牺牲文本性能的前提下,增加了对图像的理解能力。

123B多模态解码器和1B参数视觉编码器:提供了强大的图像和文本处理能力。

128K上下文窗口:能够适应至少30张高分辨率图像。

系统提示处理:强化了对系统提示的支持,以实现最佳效果。

基础指令模板(V7):提供了标准化的模板,以指导模型的响应。

研究目的使用:模型和衍生产品仅限于研究目的使用。

使用教程

1. 安装vLLM库:确保安装了vLLM >= v0.6.4.post1和mistral_common >= 1.5.0。

2. 启动服务器:使用vLLM serve命令启动Pixtral-Large-Instruct-2411模型的服务。

3. 配置系统提示:根据需要,加载并配置SYSTEM_PROMPT.txt文件,以指导模型的行为。

4. 构建请求:构建包含系统提示和用户消息的请求数据,包括文本和图像URL。

5. 发送请求:使用HTTP POST请求将数据发送到服务器,并接收模型的响应。

6. 处理响应:解析模型返回的响应,提取有用的信息。

7. 离线使用:如果需要,也可以在没有服务器的情况下,使用vLLM库直接在本地运行模型。