使用场景

开发者使用Qwen2.5-Coder生成一个快速排序算法的代码。

软件工程师利用模型修复现有代码中的bug。

编程教育者使用该模型来辅助学生理解复杂的编程概念。

产品特色

代码生成:显著提升代码生成能力,帮助开发者快速实现编程任务。

代码推理:增强模型对代码逻辑的理解,提高代码分析的准确性。

代码修复:自动检测并修复代码中的错误,提升代码质量。

全参数规模覆盖:提供从0.5亿到32亿参数的不同模型规模,满足不同开发者需求。

实际应用基础:为代码代理等实际应用提供更全面的能力支持。

8位量化:使用GPTQ 8位量化技术,优化模型性能和资源消耗。

长上下文支持:支持长达32768个token的上下文长度,适合处理复杂代码。

使用教程

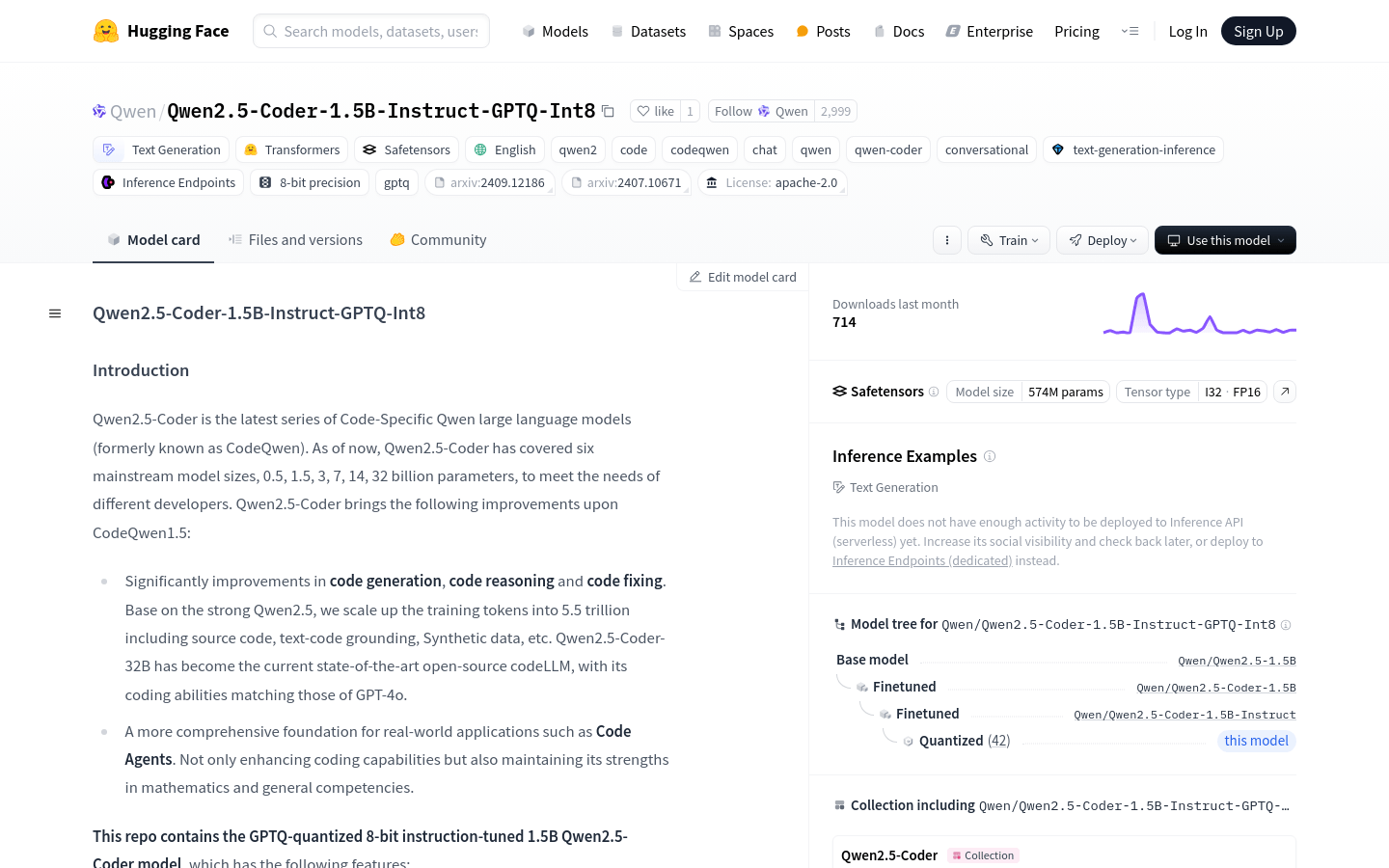

1. 访问Hugging Face平台并找到Qwen2.5-Coder-1.5B-Instruct-GPTQ-Int8模型。

2. 根据页面提供的代码示例,导入必要的库和模块。

3. 加载模型和分词器,使用AutoModelForCausalLM和AutoTokenizer.from_pretrained方法。

4. 准备输入提示,例如编写一个特定功能的代码请求。

5. 使用模型生成代码,通过model.generate方法并设置max_new_tokens参数。

6. 获取生成的代码ID,并使用tokenizer.batch_decode方法将ID转换为可读的代码文本。

7. 分析生成的代码,根据需要进行调整或直接使用。