使用场景

开发者使用该模型生成特定算法的代码,如快速排序算法。

在代码审查过程中,利用模型推理代码逻辑,提高代码质量。

在遇到编程难题时,使用模型修复功能快速定位并解决问题。

产品特色

代码生成:显著提升代码生成能力,支持多种编程语言。

代码推理:增强模型对代码逻辑的理解,提高代码推理的准确性。

代码修复:帮助开发者识别并修复代码中的错误。

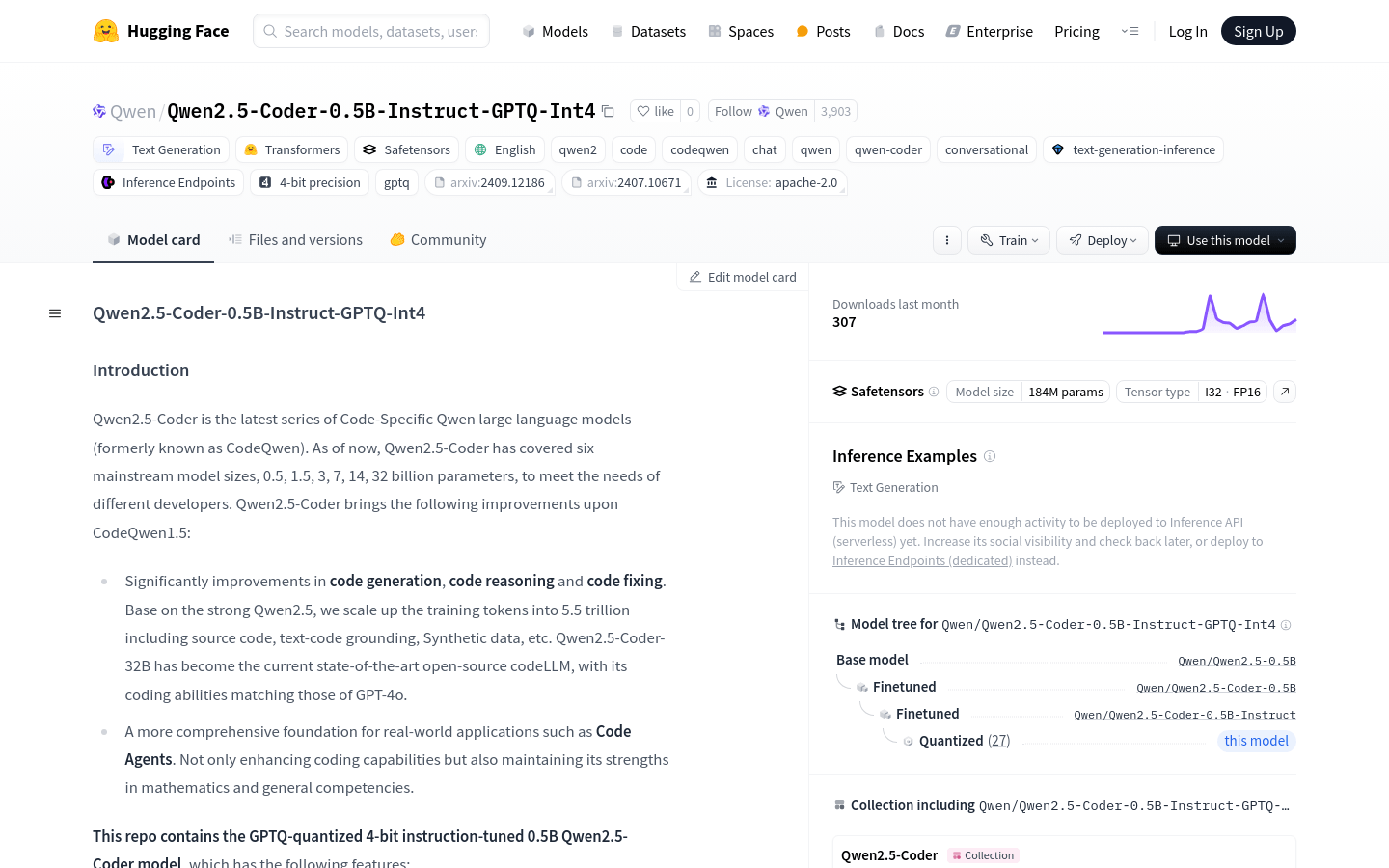

全参数覆盖:模型包含0.49B参数,非嵌入参数0.36B,覆盖广泛的编程场景。

多层架构:24层网络结构,提供深入的代码理解和生成能力。

长文本支持:支持长达32,768个token的上下文长度,适合处理复杂的编程任务。

4位量化:GPTQ 4位量化技术,优化模型的存储和计算效率。

使用教程

1. 安装并导入必要的库,如transformers和torch。

2. 从Hugging Face加载模型和分词器:`model = AutoModelForCausalLM.from_pretrained(model_name)` 和 `tokenizer = AutoTokenizer.from_pretrained(model_name)`。

3. 准备输入提示,如编写算法的需求。

4. 使用`tokenizer.apply_chat_template`处理输入消息,并生成模型输入。

5. 将模型输入传递给模型,并设置生成参数,如`max_new_tokens=512`。

6. 调用模型的`generate`方法生成代码。

7. 使用`tokenizer.batch_decode`将生成的代码ID转换为文本形式。