使用场景

- 使用ShowUI模型自动化网页操作,如填写表单、点击按钮。

- 利用ShowUI进行图像识别和基于指令的界面导航。

- 将ShowUI集成到自定义的应用中,以提供更自然的用户体验。

产品特色

- 视觉-语言-行动模型:结合视觉输入、语言理解和行动预测。

- GUI自动化:用于图形用户界面的自动化操作。

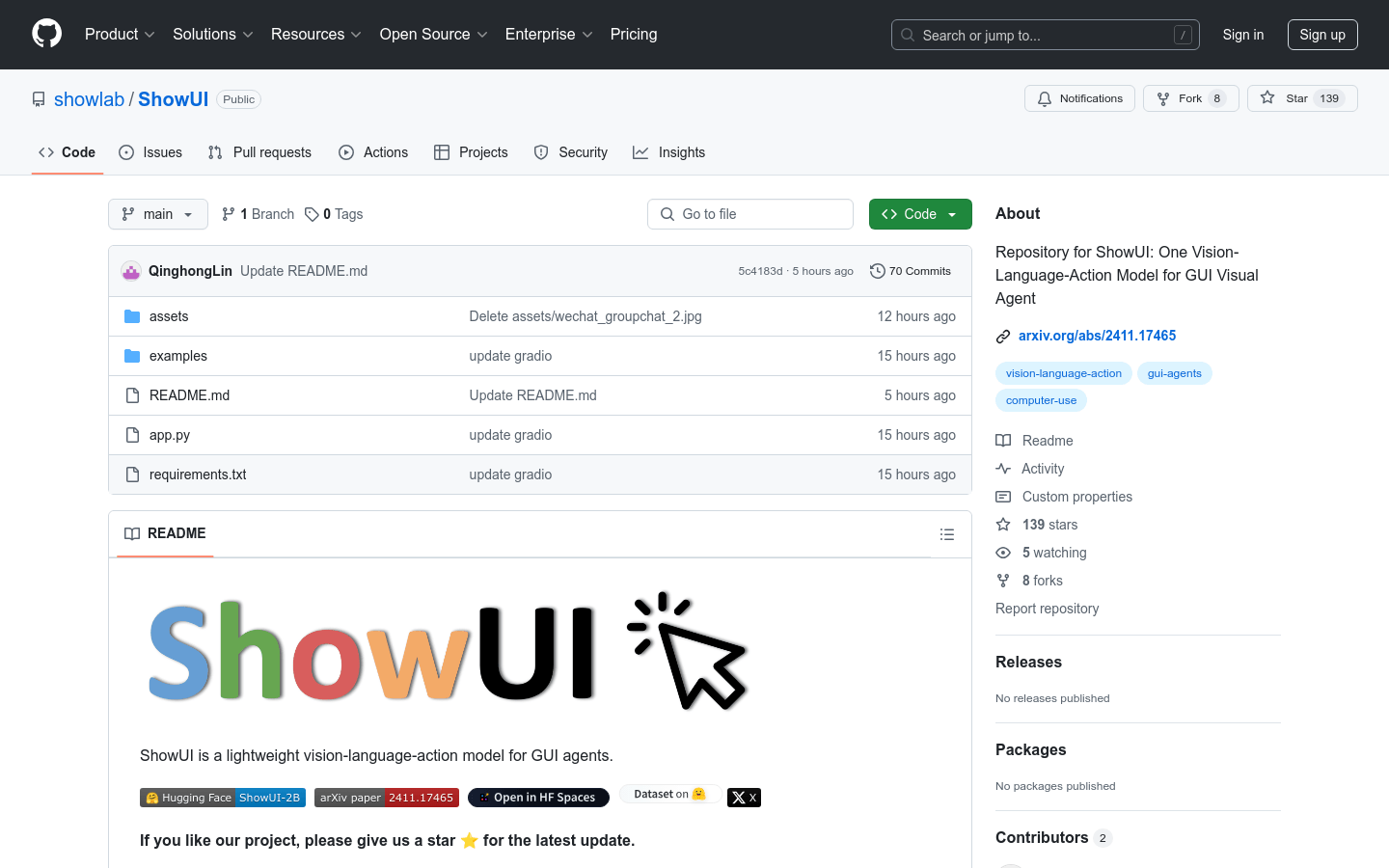

- 模型训练与部署:支持在huggingface平台进行模型训练和部署。

- 多模态输入:支持图像和文本的多模态输入。

- 行动预测:能够预测用户指令对应的界面操作。

- 界面操作:支持点击、输入、选择等多种界面操作。

- 模型微调:提供微调代码和指令,以适应特定应用场景。

使用教程

1. 安装依赖:通过pip安装requirements.txt中列出的依赖。

2. 克隆仓库:使用git clone命令克隆ShowUI的代码仓库。

3. 启动界面:运行app.py启动ShowUI的图形界面。

4. 加载模型:使用Qwen2VLForConditionalGeneration类加载预训练的ShowUI模型。

5. 界面操作:通过发送包含系统提示、图像和查询的messages列表来执行界面操作。

6. 结果展示:通过draw_point函数在图像上标记操作结果,如点击位置。

7. 微调模型:根据需要对模型进行微调,以适应特定的应用场景。