使用场景

在自然语言处理任务中,使用Star-Attention处理长文本数据,提高问答系统的响应速度。

在对话系统的应用中,通过Star-Attention快速生成回复,提升用户体验。

在文本摘要任务中,利用Star-Attention处理长文档,快速生成摘要内容。

产品特色

- 块稀疏注意力机制:Star Attention通过块局部注意力和全局序列注意力的两阶段操作,有效处理长序列数据。

- 显著加速推理:在保持高准确率的同时,推理速度提升高达11倍。

- 兼容性强:与多数基于Transformer的LLM兼容,无需额外训练。

- 易于集成:可以与其他优化技术结合使用,如Flash Attention和KV缓存压缩。

- 高效处理长序列:特别适用于需要处理长序列数据的大型语言模型。

- 灵活配置:支持不同模型和序列长度的配置,以适应不同的应用场景。

使用教程

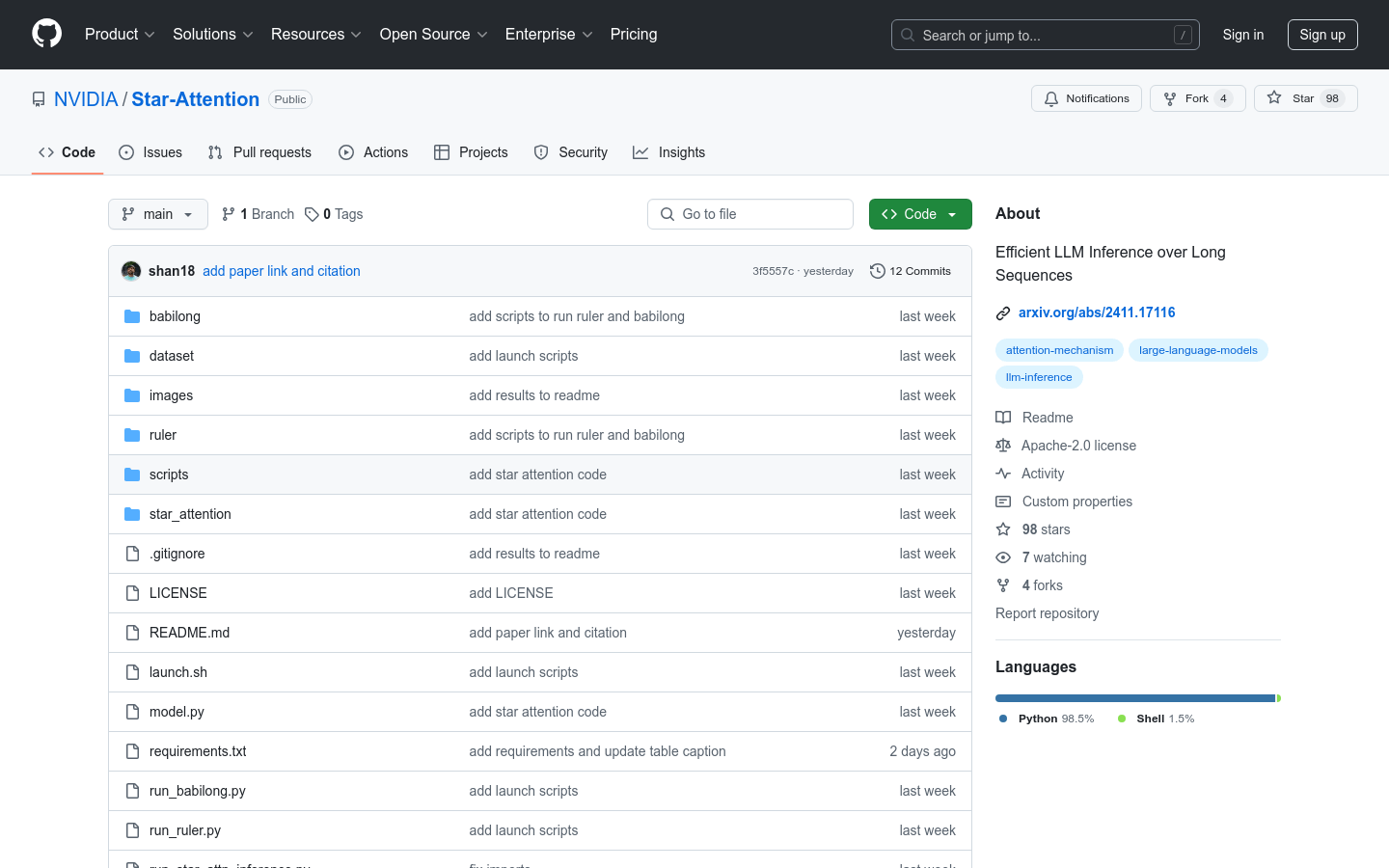

1. 安装依赖:通过pip安装requirements.txt中的所有项目依赖。

2. 准备数据:下载并准备所需的数据集,如RULER和BABILong数据。

3. 配置模型:根据需要处理的序列长度和模型类型,配置Star-Attention的参数。

4. 运行推理:使用run_star_attn_inference.py脚本,指定模型路径、注意力类型、块大小等参数,运行推理。

5. 分析结果:推理完成后,分析输出结果,评估模型性能。

6. 优化调整:根据结果反馈,调整参数配置,优化模型性能。