使用场景

1. 使用FLOAT生成具有特定情感表达的公众演讲视频。

2. 利用FLOAT技术为电影制作逼真的对话场景。

3. 在虚拟现实中,使用FLOAT技术创建具有自然表情的虚拟角色。

产品特色

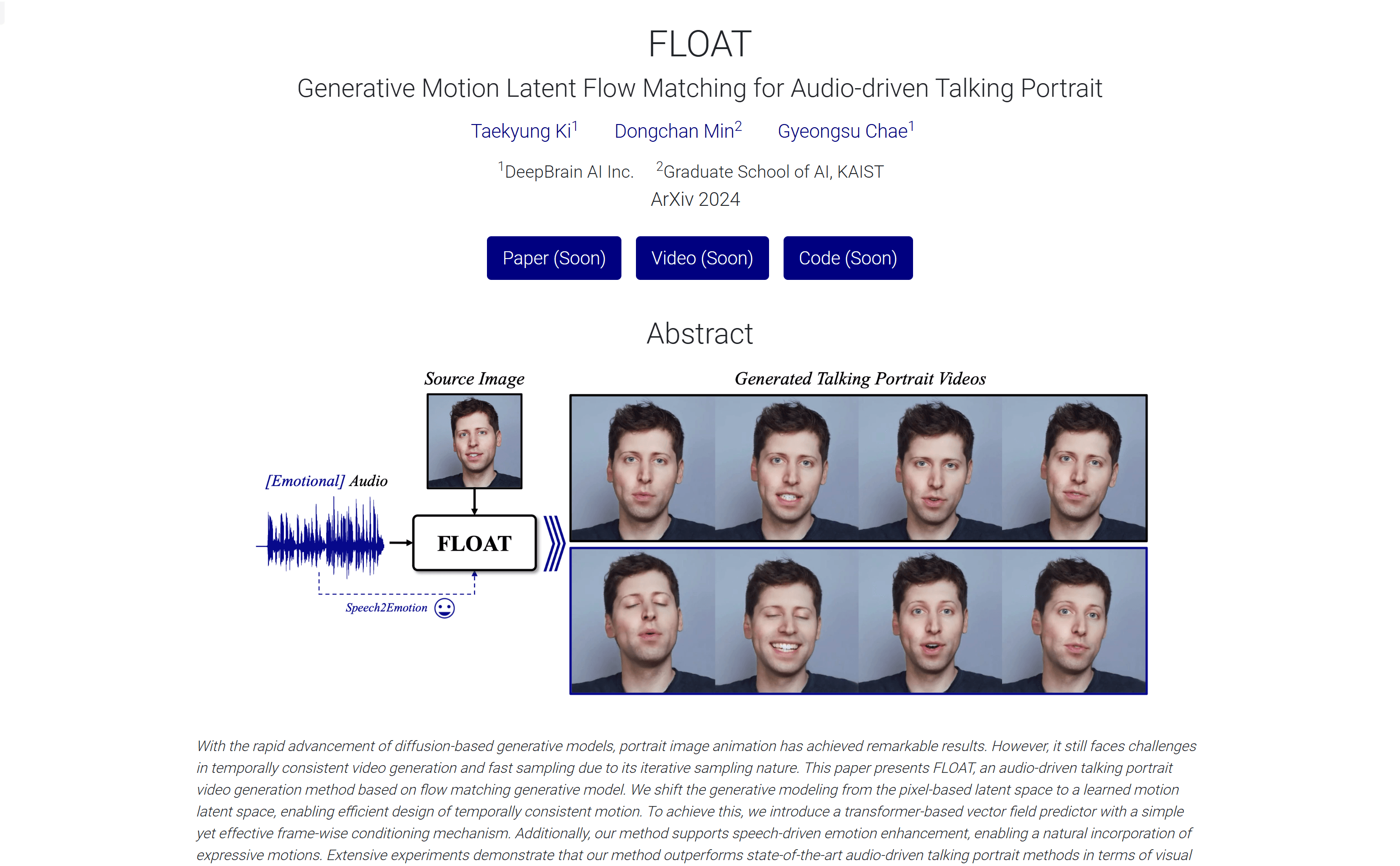

- 音频驱动的人像视频生成:使用单个人像图像和驱动音频合成说话人像视频。

- 运动潜在空间编码:通过运动潜在自编码器将给定的人像图像编码为身份-运动潜在表示。

- 流匹配生成:通过流匹配(具有最优传输轨迹)生成音频条件的说话人像运动潜在。

- 情感增强:支持语音驱动的情感标签,提供情感感知的说话人像运动生成的自然方法。

- 情感重定向:在推理阶段可以重定向说话人像的情感,通过简单的独热情感标签进行操作。

- 与最新技术的比较:与非扩散基础方法和扩散基础方法进行比较,展示FLOAT的优势。

- 消融研究:对逐帧AdaLN(和门控)和流匹配进行消融研究,验证其效果。

- 不同数量的功能评估(NFEs):展示少量NFEs对时间一致性的影响,并展示FLOAT在大约10 NFEs下生成合理视频结果的能力。

使用教程

1. 访问FLOAT项目页面并下载相关代码。

2. 准备单个人像图像和相应的驱动音频。

3. 根据文档说明,配置音频条件和情感标签。

4. 运行FLOAT模型,生成说话人像运动潜在。

5. 通过流匹配生成具有时间一致性的视频。

6. 调整情感重定向和NFEs以优化视频结果。

7. 导出并查看生成的逼真说话人像视频。