使用场景

研究人员使用Florence-VL进行图像和文本的联合表示学习,以提高模型在视觉问答任务中的表现。

开发者利用Florence-VL提供的预训练模型,快速构建一个图像标注应用。

在教育领域,Florence-VL被用于辅助教学,通过图像和文本的结合提供更丰富的学习材料。

产品特色

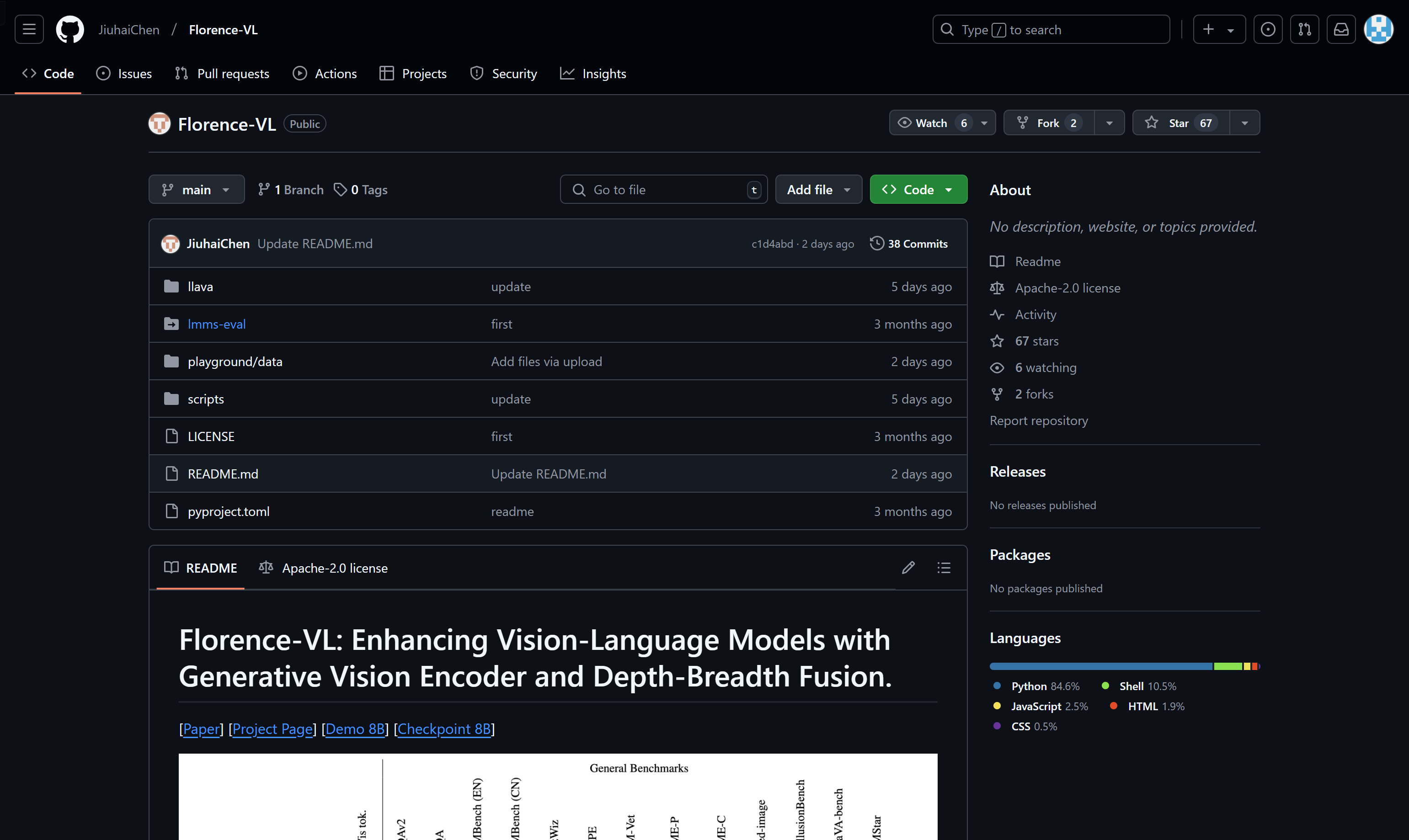

支持预训练和微调,以增强模型的多模态理解能力。

提供了3B和8B两种规模的模型检查点,以适应不同的应用需求。

结合了深度广度融合技术,提升了模型对复杂视觉语言任务的处理能力。

支持在Hugging Face平台上的模型演示,方便用户快速体验和应用。

提供了详细的安装和使用文档,便于开发者快速上手。

支持使用lmms-eval进行模型的多模态评估。

使用教程

1. 安装环境:按照项目页面提供的指令创建Python虚拟环境并安装依赖。

2. 下载数据集:从指定的数据源下载预训练数据和指令数据。

3. 配置训练脚本:根据个人的数据路径和硬件配置,设置训练脚本中的相关变量。

4. 运行训练:执行训练脚本,开始模型的预训练和微调过程。

5. 模型评估:使用lmms-eval工具对训练好的模型进行评估。

6. 应用模型:将训练好的模型部署到实际应用中,如图像标注、视觉问答等。