使用场景

研究人员使用ReFT在GSM8k数据集上微调Codellama模型,提高了模型的Top-1准确率。

开发者利用ReFT框架在mathqa数据集上对Galactica模型进行微调,提升了模型的Voting@100性能。

研究团队通过ReFT在svamp数据集上对模型进行ReFT和ReFT-Rerank微调,显著提高了模型的Rerank@100性能。

产品特色

支持SFT(Supervised Fine-Tuning):通过监督学习对模型进行微调。

支持ReFT(Reinforced Fine-Tuning):使用强化学习技术对模型进行微调。

支持Online-SL和Offline-SL:在线和离线自助学习。

提供多种预训练模型的checkpoints:方便用户从不同阶段开始微调。

支持Top-1和Voting@100评估:提供模型性能的多种评估方式。

支持Reranking:通过重新排序技术进一步提升模型性能。

详细的实验指导和脚本:方便用户快速开始实验和微调。

使用教程

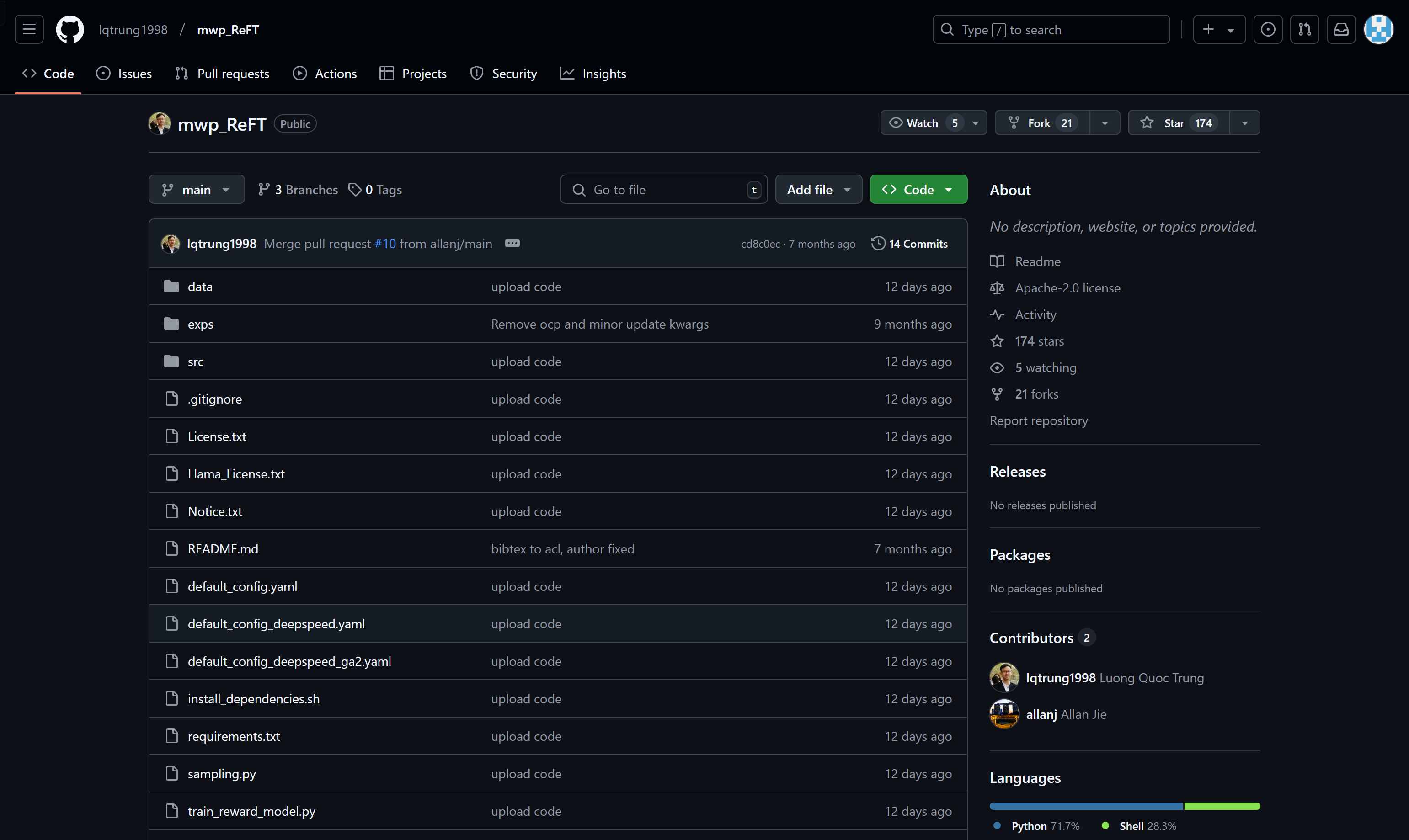

1. 访问ReFT的GitHub页面并克隆代码到本地。

2. 根据README.md文件中的指南安装所有依赖。

3. 选择合适的预训练模型和checkpoints开始微调。

4. 根据具体的实验需求,运行对应的shell脚本进行模型训练或评估。

5. 参照exps文件夹中的实验设置,调整参数以适应不同的数据集和任务。

6. 使用提供的脚本进行模型性能的评估,包括Top-1、Voting@100和Rerank@100。

7. 如果需要,可以进一步微调模型参数或结构,以获得更好的性能。