使用场景

在教育领域,DeepSeek-VL2可以帮助开发智能教育辅助工具,通过图像和文本理解来辅助学生学习。

在商业领域,该模型可以用于智能客服系统,通过理解用户上传的图片和文字信息来提供更准确的服务。

在医疗领域,DeepSeek-VL2可以辅助医生分析医学影像,提供更快速的诊断支持。

产品特色

视觉问答:能够理解并回答与图像相关的问题。

光学字符识别:识别图像中的文字信息。

文档理解:解析和理解文档内容。

表格/图表理解:识别和理解表格及图表中的数据。

视觉定位:识别图像中特定物体的位置。

多模态交互:结合视觉和语言信息,提供更丰富的交互体验。

模型变体:提供不同规模的模型以适应不同的应用场景和计算资源。

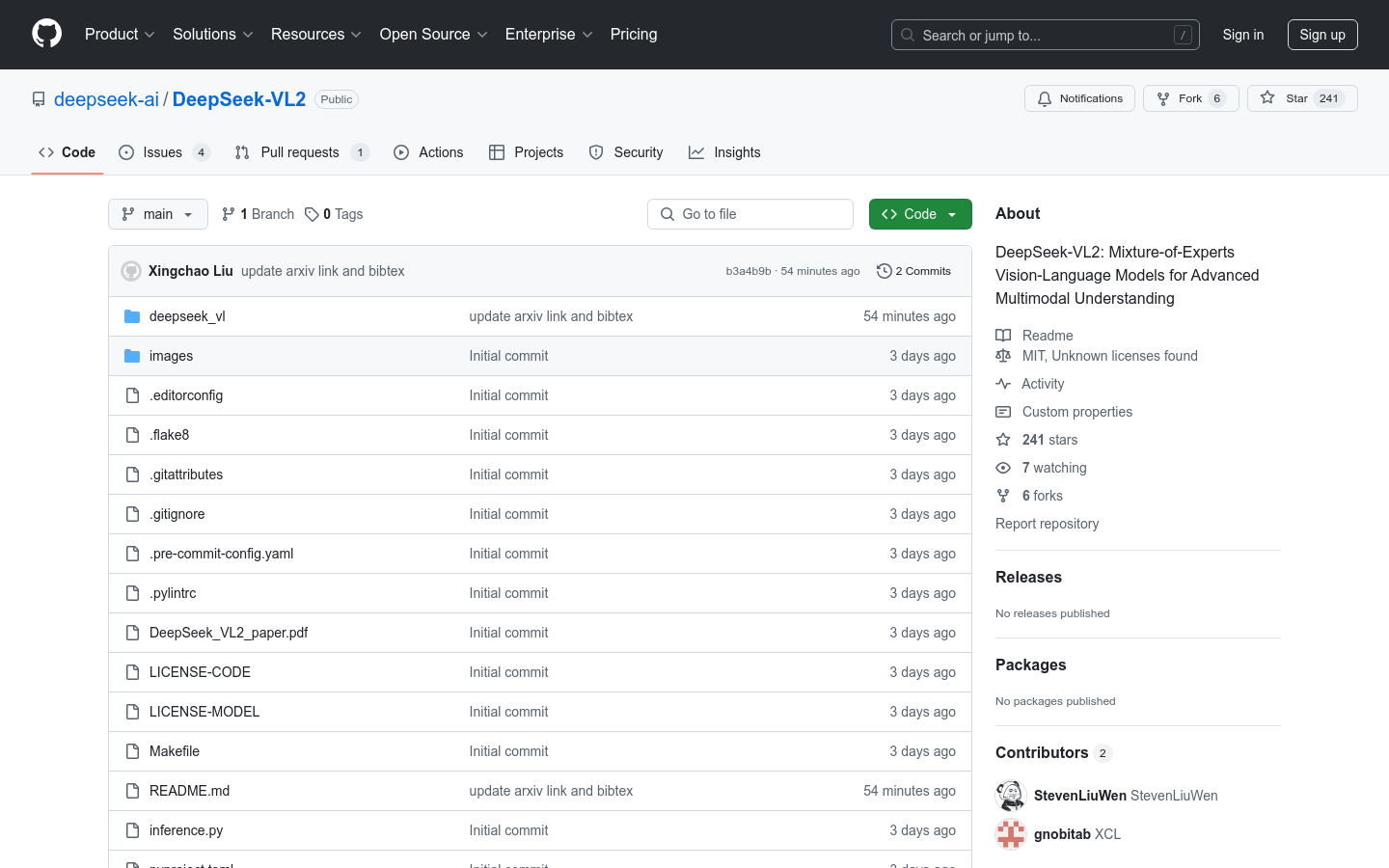

使用教程

1. 安装必要的依赖,运行`pip install -e .`。

2. 准备模型路径,例如`model_path = 'deepseek-ai/deepseek-vl2-small'`。

3. 加载模型和处理器,使用`DeepseekVLV2Processor.from_pretrained(model_path)`。

4. 准备输入数据,包括对话内容和相关图片。

5. 使用`prepare_inputs`方法处理输入数据。

6. 运行模型,获取响应,使用`vl_gpt.language_model.generate`。

7. 输出结果,使用`tokenizer.decode`将模型输出的token序列解码为文本。