使用场景

- 使用WePOINTS模型进行图像和文本的联合分析,提升内容审核系统的准确性。

- 利用WePOINTS模型开发智能客服系统,提供图文识别和回复功能。

- 结合WePOINTS模型和CATTY技术,进行图像识别和分类任务,提高图像处理的效率和准确性。

产品特色

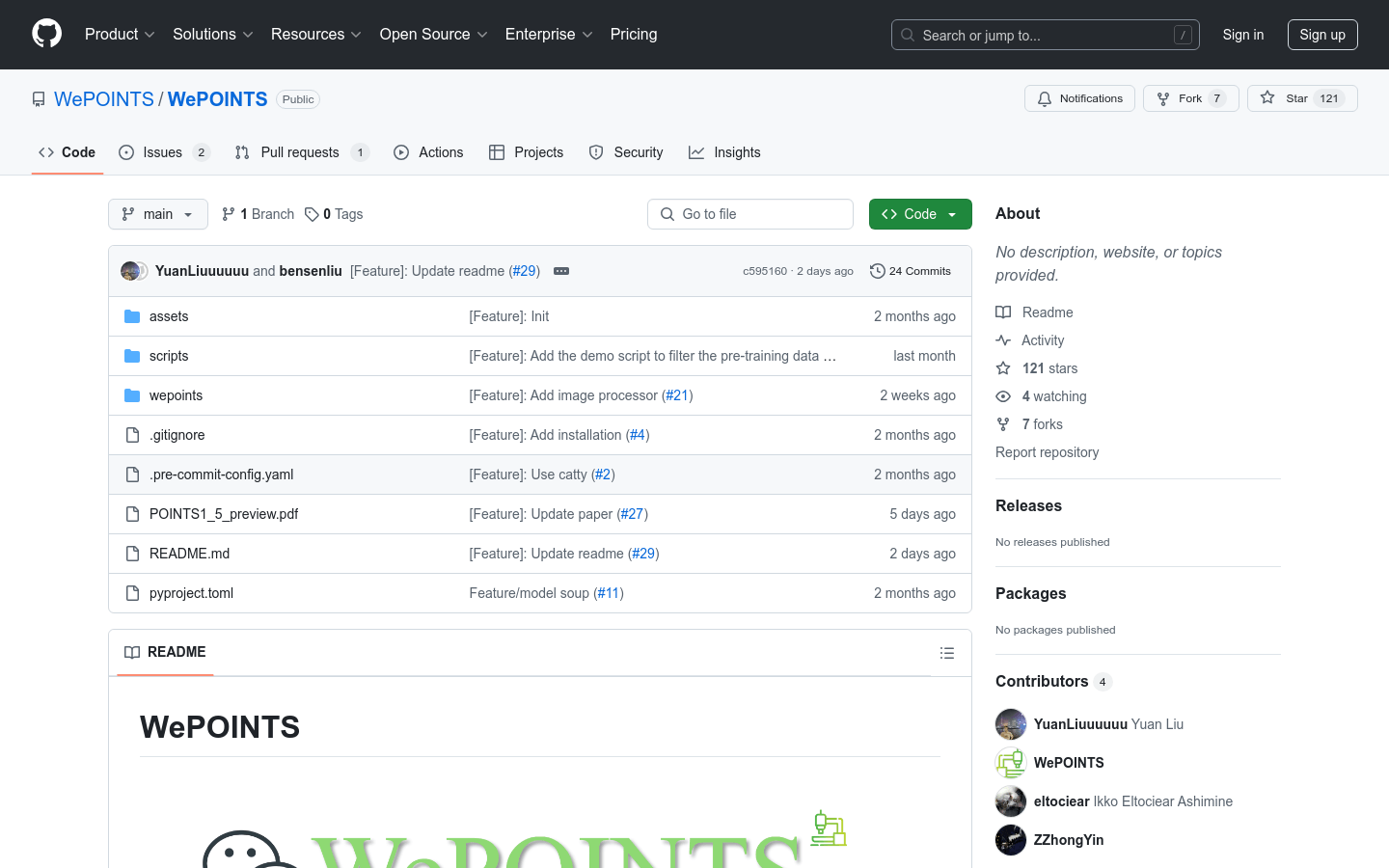

- 提供多模态模型的统一框架:WePOINTS旨在整合视觉和语言等多种模态,提供统一的处理方式。

- 支持双语模型:WePOINTS1.5模型支持双语,增强了模型的国际化应用能力。

- 集成到SGLang:WePOINTS1.5将被集成到SGLang中,扩展了模型的应用场景。

- 提供预训练数据集:WePOINTS将发布POINTS1.5的预训练数据集,方便研究者和开发者使用。

- 支持Hugging Face和ModelScope:WePOINTS模型可以在Hugging Face和ModelScope上找到,便于开发者快速接入和使用。

- 提供评估工具:WePOINTS使用VLMEvalKit评估模型性能,提供了标准化的评估流程。

- 支持模型融合技术:WePOINTS提出了模型融合技术,通过结合不同指令数据集微调的模型,提升最终模型的性能。

- 提供图像分割技术CATTY:WePOINTS提供了CATTY技术,用于将大分辨率图像分割成相同大小的小图像块,保持原图比例。

使用教程

1. 克隆WePOINTS项目到本地:使用git命令克隆项目代码。

2. 安装依赖:进入项目目录,使用pip安装项目依赖。

3. 下载模型:根据需要从Hugging Face或ModelScope下载相应的WePOINTS模型。

4. 配置环境:根据模型要求配置运行环境,如CUDA版本等。

5. 运行模型:按照WePOINTS提供的教程,运行模型进行多模态任务。

6. 评估模型:使用VLMEvalKit工具对模型性能进行评估。

7. 模型融合:如果有多个模型,可以使用WePOINTS提供的模型融合技术进行模型融合。

8. 图像分割:使用CATTY技术对大分辨率图像进行分割处理。