使用场景

用于聊天机器人的构建,提供流畅的对话体验。

在文本生成应用中,生成新闻文章或社交媒体内容。

作为搜索引擎的一部分,提供语义理解和搜索结果优化。

产品特色

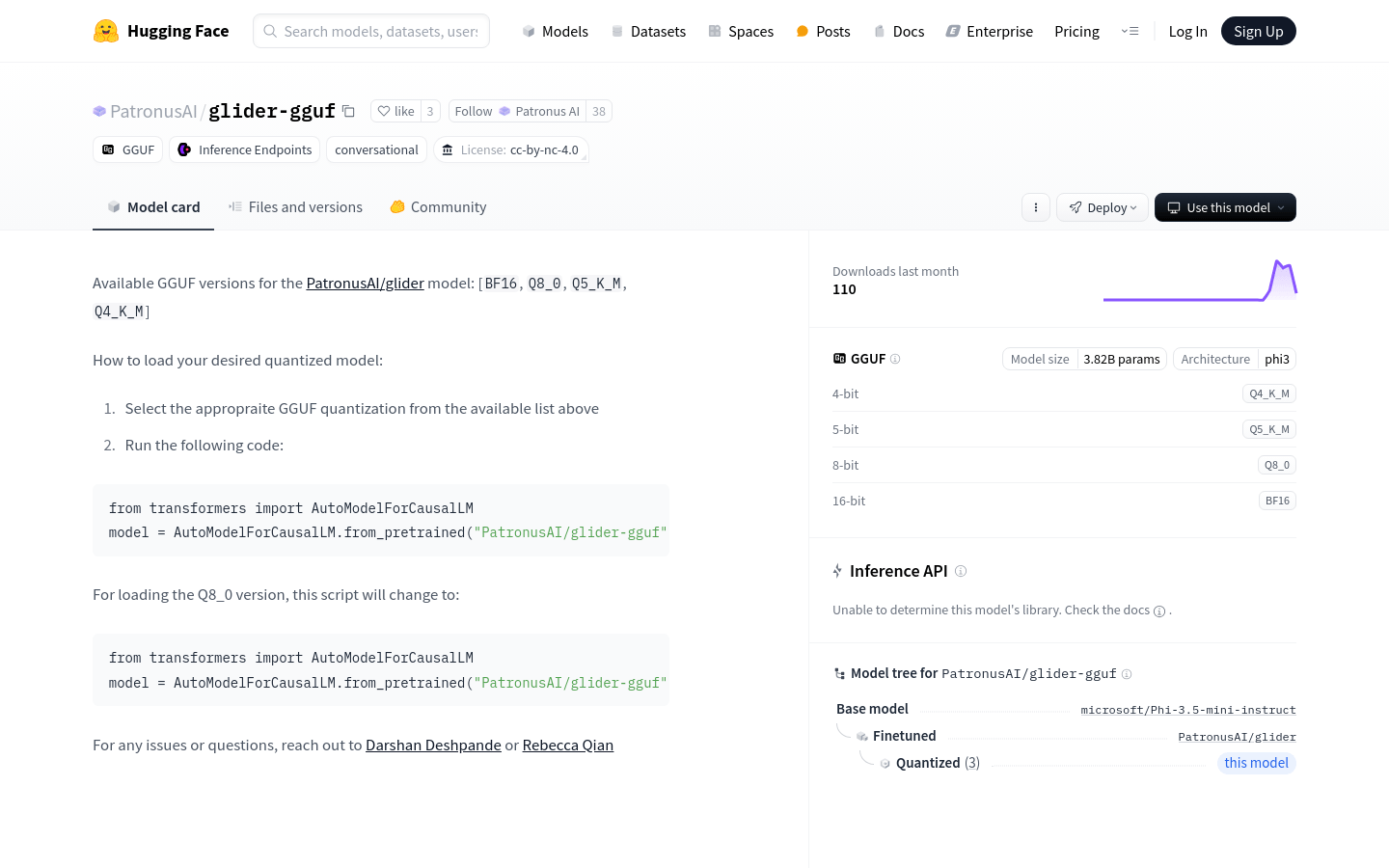

支持多种GGUF量化版本,包括BF16、Q8_0、Q5_K_M、Q4_K_M等。

基于phi3架构,拥有3.82B参数,适用于大规模语言模型。

通过AutoModelForCausalLM.from_pretrained接口加载模型,方便集成到现有项目中。

模型支持快速推理,适合在线和离线应用。

模型体积小,便于部署到资源受限的环境。

社区活跃,有问题可以联系Darshan Deshpande或Rebecca Qian。

使用教程

1. 选择适当的GGUF量化版本。

2. 运行以下代码加载模型:`from transformers import AutoModelForCausalLM; model = AutoModelForCausalLM.from_pretrained("PatronusAI/glider-gguf", gguf_file="glider_{version_from_list}.gguf")`。

3. 替换`{version_from_list}`为所需的量化版本,例如`Q8_0`。

4. 使用加载的模型进行文本生成或其他NLP任务。

5. 如遇问题,访问Hugging Face社区或联系Darshan Deshpande和Rebecca Qian寻求帮助。