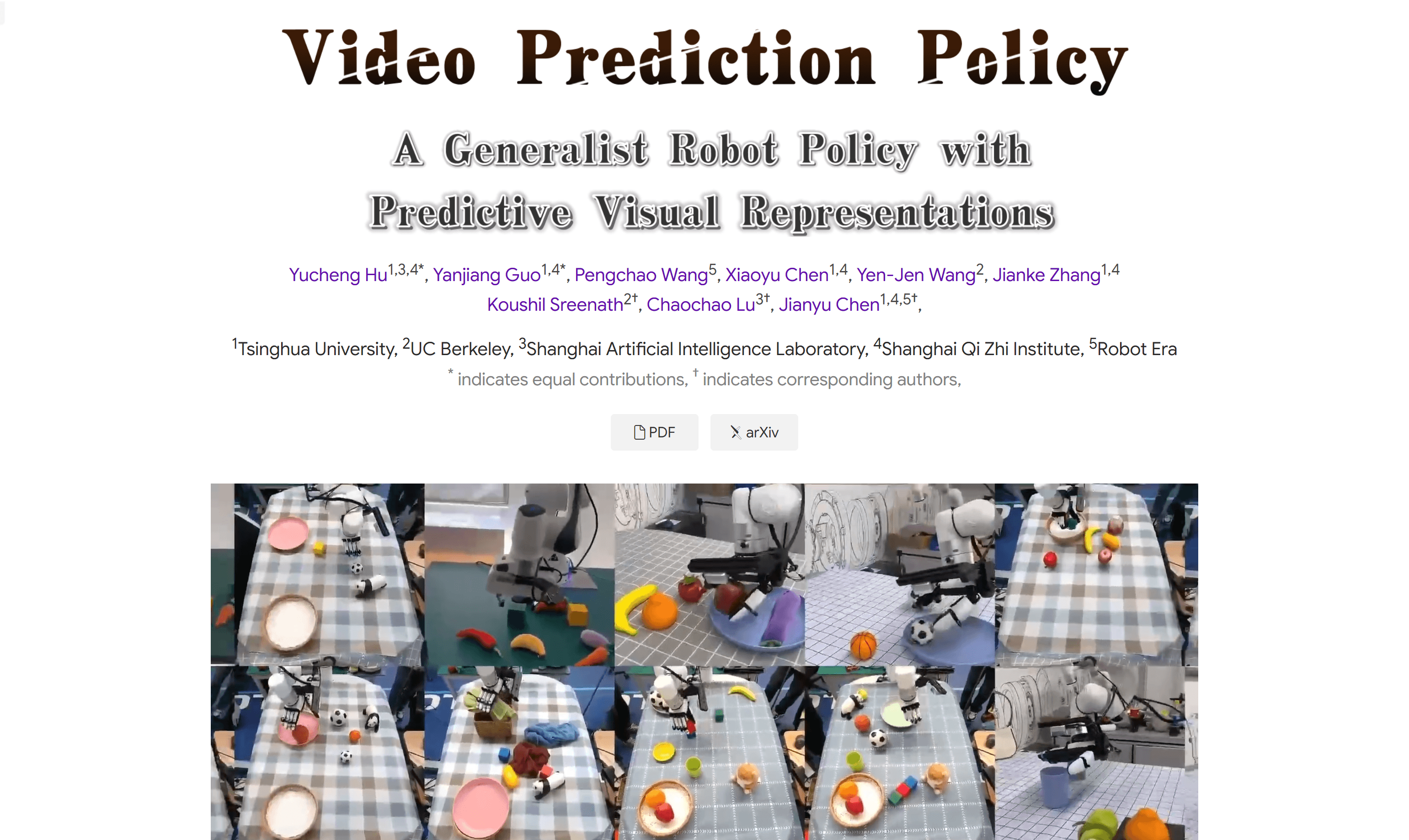

使用场景

在CALVIN基准测试中,VPP实现了28.1%的相对改进,超越了先前的最佳技术。

VPP在复杂的真实世界灵巧手操控任务中提高了28.8%的成功率。

VPP在Panda臂操控和XHand灵巧手操控等真实世界任务中表现出色。

产品特色

- 多任务灵巧手操控:VPP支持多种任务,如放置、杯直立、重定位、堆叠、传递、按压、拔插、开启等。

- 视频扩散模型(VDMs):VPP基于视频扩散模型,能够预测未来图像序列,理解物理动力学。

- 预测性视觉表示:VPP利用VDMs中的视觉表示来反映物理世界的演变。

- 统一视频生成训练目标:通过结合多样化的数据集,VPP能够提升预测视觉表示的质量。

- 模拟环境与真实世界测试:VPP在CALVIN基准和MetaWorld基准等模拟环境,以及Panda臂操控和XHand灵巧手操控等真实世界任务中进行了广泛的测试。

- 相对改进与成功率提升:在Calvin ABC-D基准测试中,VPP实现了28.1%的相对改进,并在复杂任务中提高了28.8%的成功率。

- 单一通用策略:VPP使用单一通用策略,通过不同的指令来执行多样化的任务。

使用教程

1. 访问VPP的官方网站以获取更多信息和下载模型。

2. 阅读VPP的论文和文档,了解模型的工作原理和使用方法。

3. 根据文档指导,准备必要的数据集和环境,以训练和测试VPP模型。

4. 使用VPP模型进行模拟环境和真实世界的机器人操控任务。

5. 根据任务需求,调整VPP模型的参数和指令,以优化性能。

6. 分析VPP模型的输出结果,并根据结果进一步调整模型配置。

7. 将VPP模型集成到实际的机器人系统中,实现自动化操控。