使用场景

案例1: 使用Llama-lynx-70b-4bitAWQ生成文章摘要,提高内容生产的效率。

案例2: 集成到聊天机器人中,提供流畅自然的对话体验。

案例3: 应用于教育领域,自动生成教学材料和课程内容。

产品特色

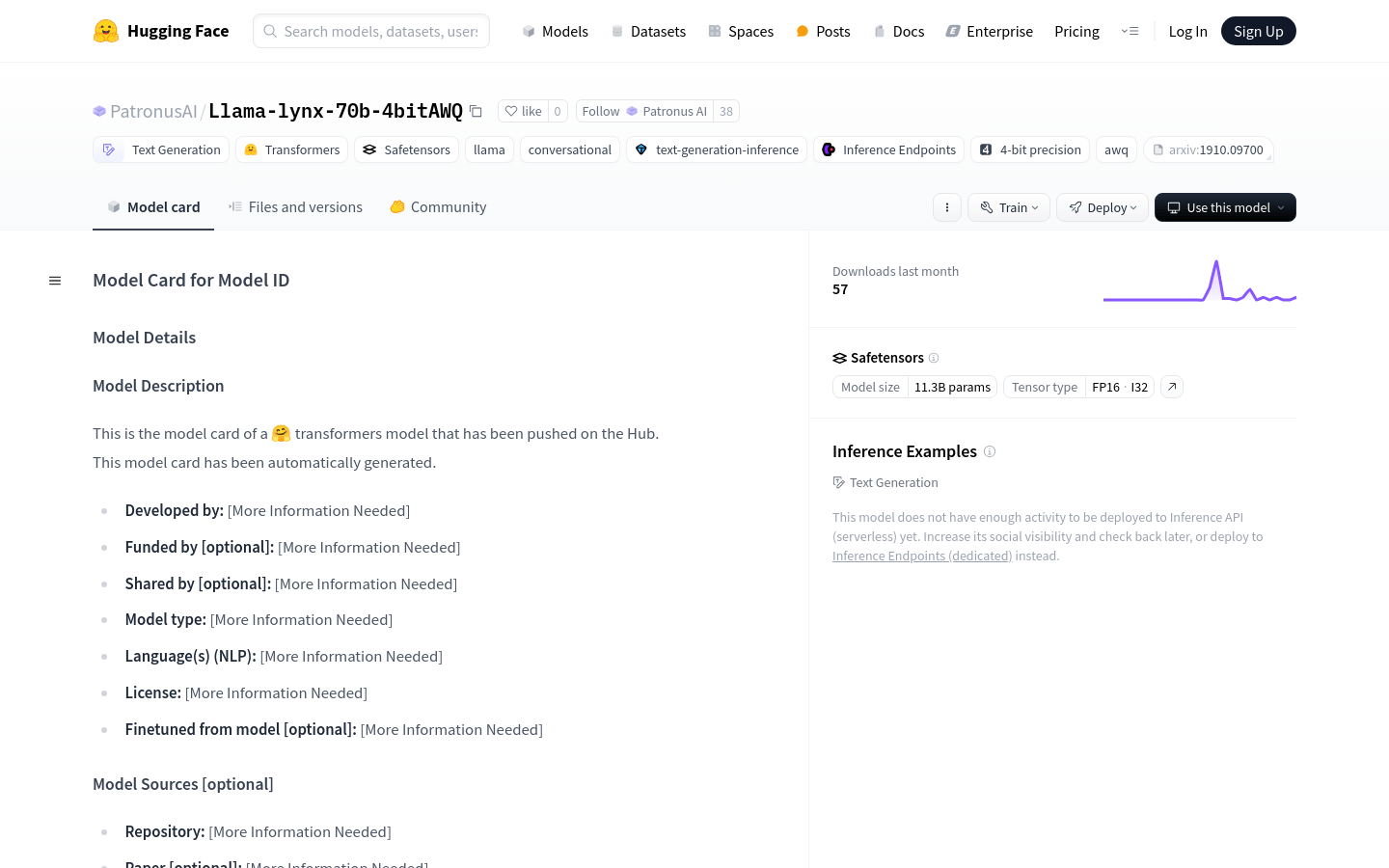

• 文本生成:能够根据给定的输入生成连贯、相关的文本。

• 4-bit精度:模型使用4-bit精度,减少了模型大小,同时保持性能。

• AWQ技术:应用了AWQ技术,优化了模型的推理效率。

• 兼容性:与'transformers'和'safetensors'库兼容,易于集成到现有的NLP工作流中。

• 多语言支持:虽然页面未明确说明,但模型可能支持多种语言的文本生成。

• 端点兼容:模型可以部署到Hugging Face的Inference Endpoints,便于在线推理。

• 社区支持:Hugging Face社区提供了讨论和反馈的平台,有助于模型的持续改进。

使用教程

1. 注册并登录Hugging Face账户。

2. 访问Llama-lynx-70b-4bitAWQ模型页面。

3. 查看模型文档,了解如何在你的项目中集成和使用模型。

4. 使用Hugging Face提供的代码示例开始文本生成任务。

5. 根据需要调整输入参数,以生成特定类型的文本。

6. 利用模型的多语言能力,探索不同语言的文本生成效果。

7. 部署模型到Inference Endpoints,实现在线文本生成服务。

8. 参与社区讨论,反馈使用体验,共同推动模型的优化和升级。