使用场景

在金融领域,DeepSeek-V3可以用于分析大量的财经新闻和报告,提取关键信息。

在医疗行业,模型能够理解和分析医学文献,辅助药物研发和病例研究。

在教育领域,DeepSeek-V3可以作为辅助工具,帮助学生和研究人员快速获取学术资料和解答复杂问题。

产品特色

采用Multi-head Latent Attention (MLA) 和 DeepSeekMoE架构,提高模型效率。

无辅助损失的负载均衡策略,减少性能退化。

多令牌预测训练目标,增强模型性能并加速推理。

FP8混合精度训练框架,降低训练成本。

从DeepSeek R1系列模型中提取推理能力的创新方法,提升推理性能。

在HuggingFace平台上提供685B大小的模型下载,包括671B主模型权重和14B多令牌预测模块权重。

支持在NVIDIA和AMD GPU上进行FP8和BF16精度的推理。

使用教程

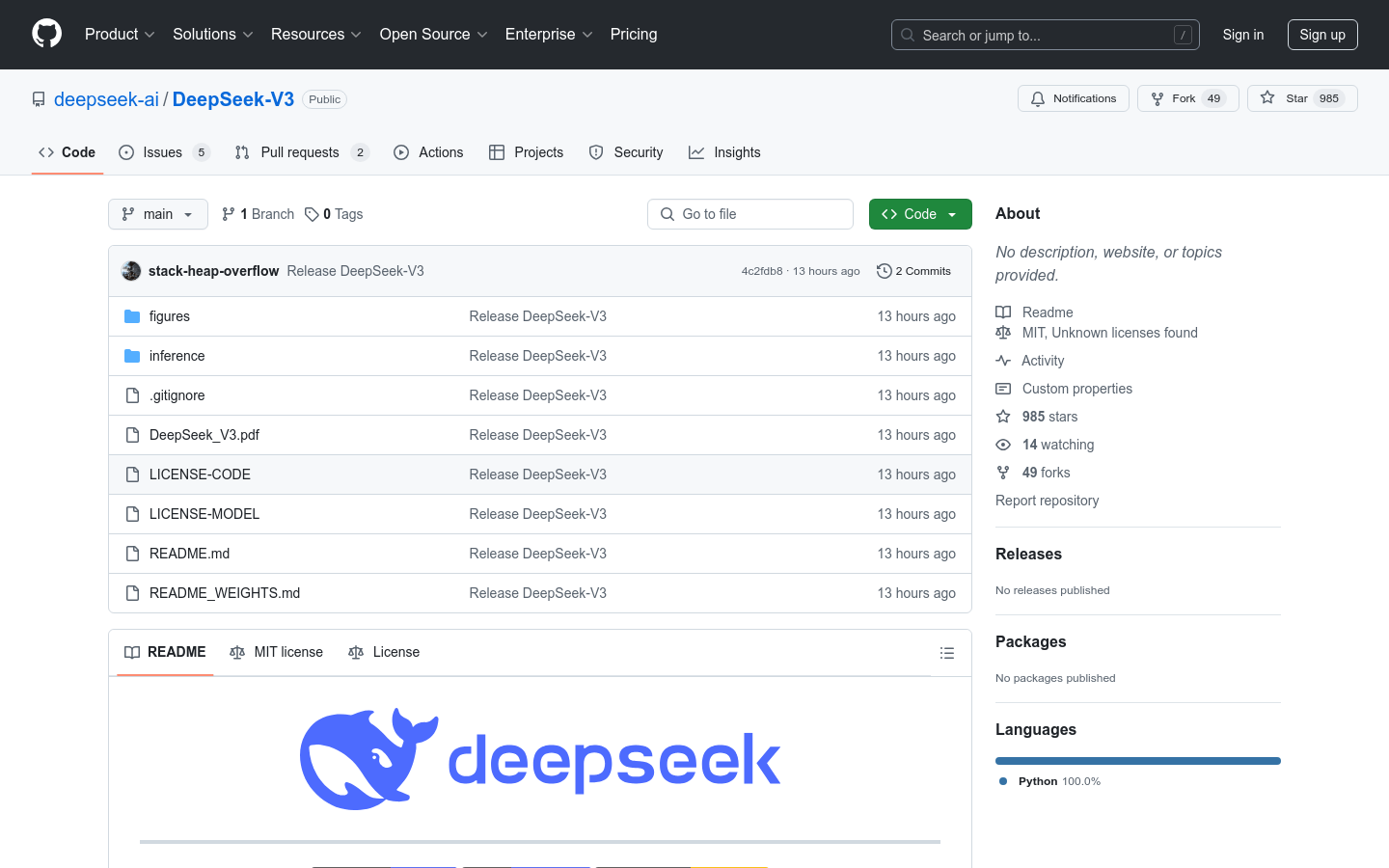

1. 克隆DeepSeek-V3的GitHub仓库。

2. 进入`inference`目录并安装`requirements.txt`中列出的依赖。

3. 从HuggingFace下载模型权重,并放入指定的文件夹。

4. 使用提供的脚本将FP8权重转换为BF16(如果需要)。

5. 根据提供的配置文件和权重路径,运行推理脚本与DeepSeek-V3进行交互或批量推理。

6. 也可以通过DeepSeek的官方网站或API平台与DeepSeek-V3进行交互。