使用场景

用于生成英语和韩语的对话回复

在资源受限的移动设备上提供语言模型服务

作为长文本处理和分析的工具,用于研究和商业智能

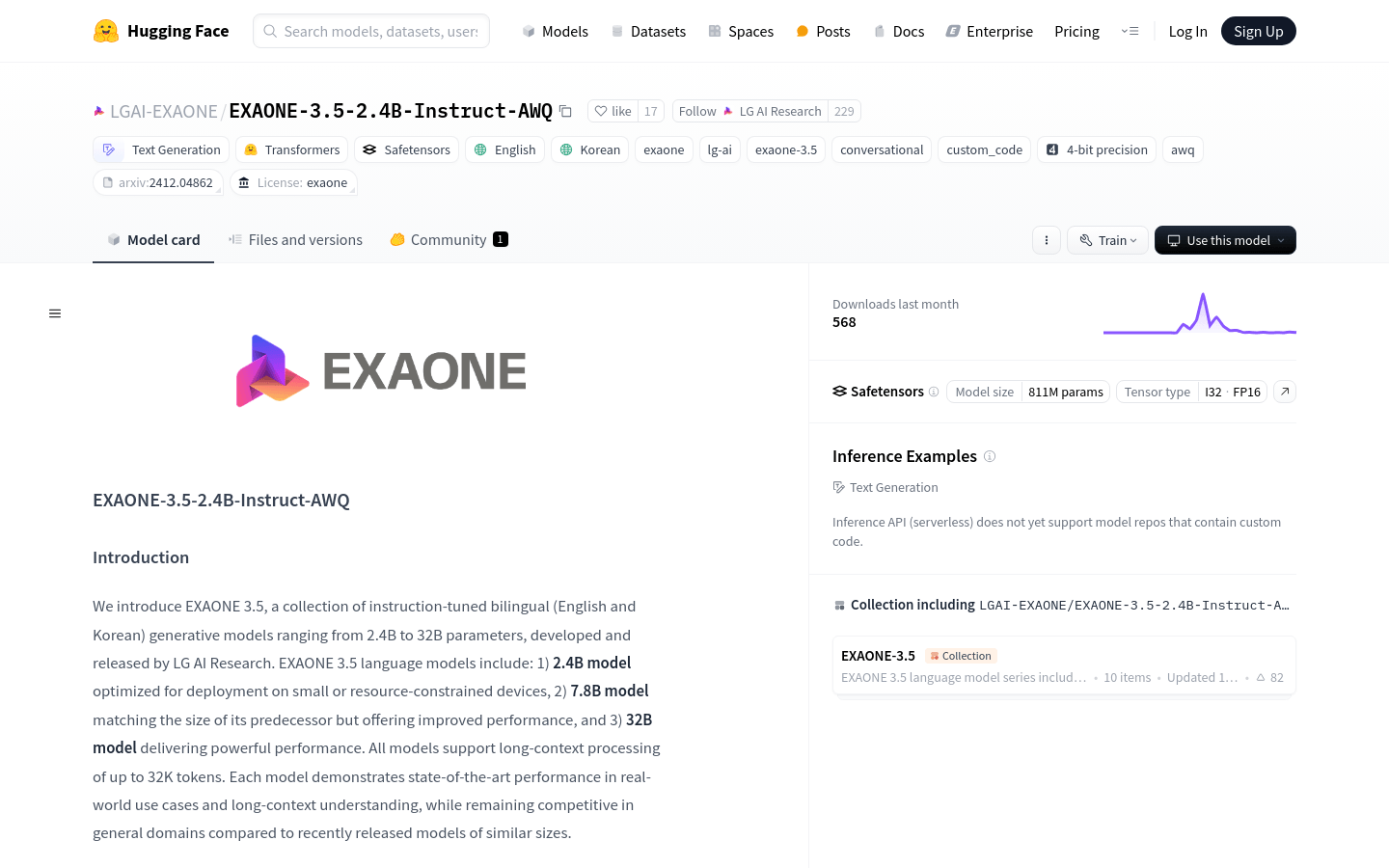

产品特色

支持长达32K令牌的长上下文处理能力

优化的2.4B模型,适合在资源受限的设备上部署

7.8B模型提供与前代相同的规模但性能提升

32B模型提供强大的性能

支持英语和韩语两种语言

AWQ量化技术,实现4位群组权重量化

支持多种部署框架,如TensorRT-LLM、vLLM等

使用教程

1. 安装必要的库,如transformers和autoawq

2. 使用AutoModelForCausalLM和AutoTokenizer加载模型和分词器

3. 准备输入提示,可以是英文或韩文

4. 使用tokenizer.apply_chat_template方法将消息模板化并转换为输入ID

5. 调用model.generate方法生成文本

6. 使用tokenizer.decode方法将生成的ID解码为文本

7. 根据需要调整模型参数,如max_new_tokens和do_sample,以控制生成文本的长度和多样性