使用场景

1. 应用于智能客服系统,生成准确文本回复。

2. 在内容创作平台辅助创作文章、故事等创意文本。

3. 助力企业知识管理系统实现文档摘要和问答自动化。

产品特色

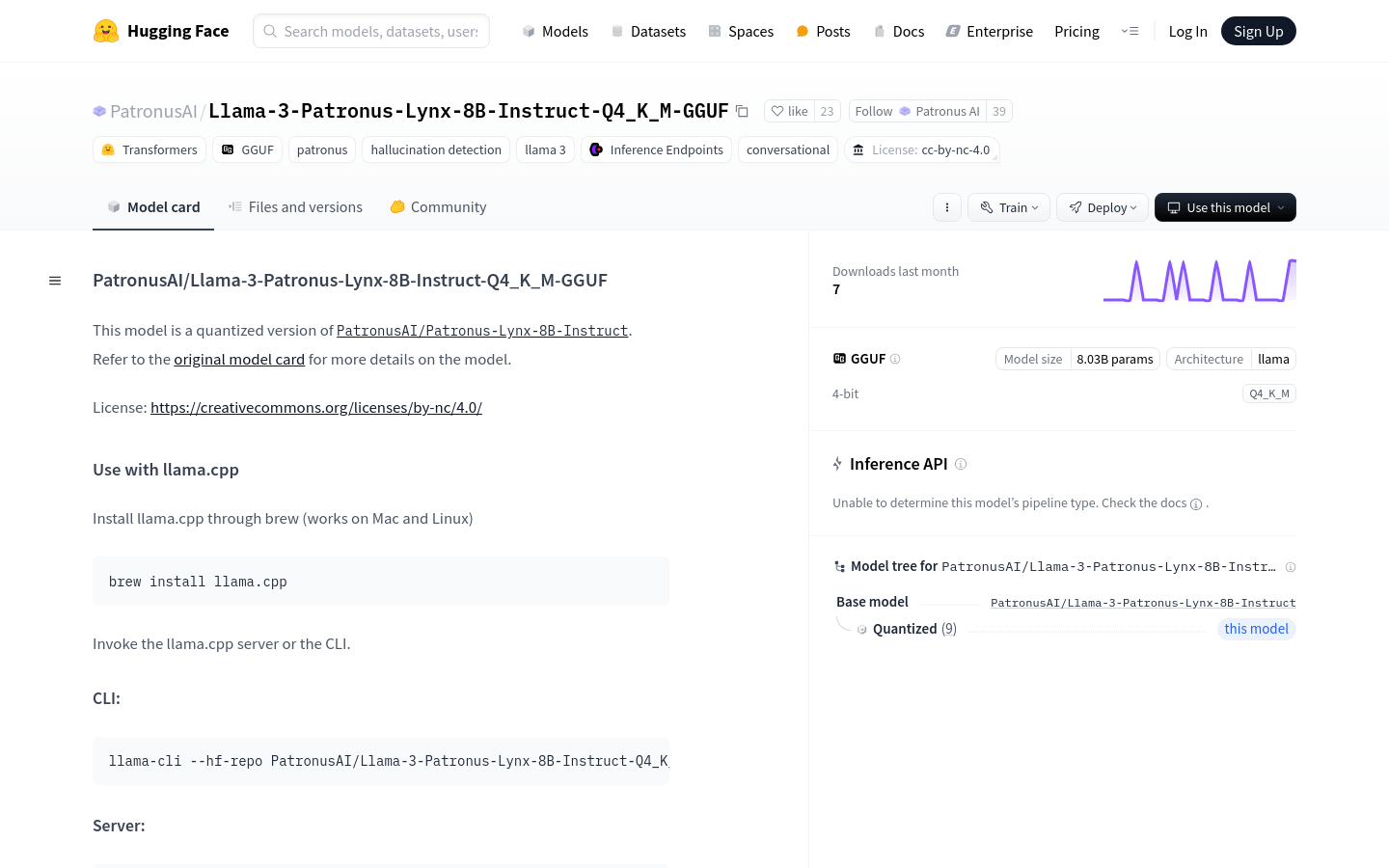

1. 支持通过llama.cpp进行命令行界面(CLI)推理,方便快捷操作。

2. 能通过llama.cpp搭建服务器推理,利于服务部署。

3. 参数量达8.03B,具备较强语言理解与生成能力,满足文本处理需求。

4. 采用4位量化技术,有效优化存储和计算效率,节省资源。

5. 适用于文本生成、问答等自然语言处理任务,应用场景广泛。

6. 基于特定架构,可通过相关方式进行推理,易于上手使用。

7. 允许在非商业用途下自由使用和分享,使用限制明确。

使用教程

1. 通过brew安装llama.cpp(适用于Mac和Linux)。

2. 使用llama-cli命令行工具进行推理,按相应格式输入参数。

3. 搭建llama-server进行推理服务,配置对应参数。

4. 也可直接参照llama.cpp仓库中的使用步骤进行推理。

5. 克隆llama.cpp仓库,进入目录并按要求构建。

6. 通过构建好的二进制文件运行推理。