使用场景

在运动分析应用中,使用ViTPose模型实时检测运动员的姿态,为教练提供技术分析数据。

集成到虚拟现实游戏中,根据玩家的姿态进行交互,增强游戏的沉浸感。

应用于智能监控系统,检测人群中的异常姿态,提高公共安全。

产品特色

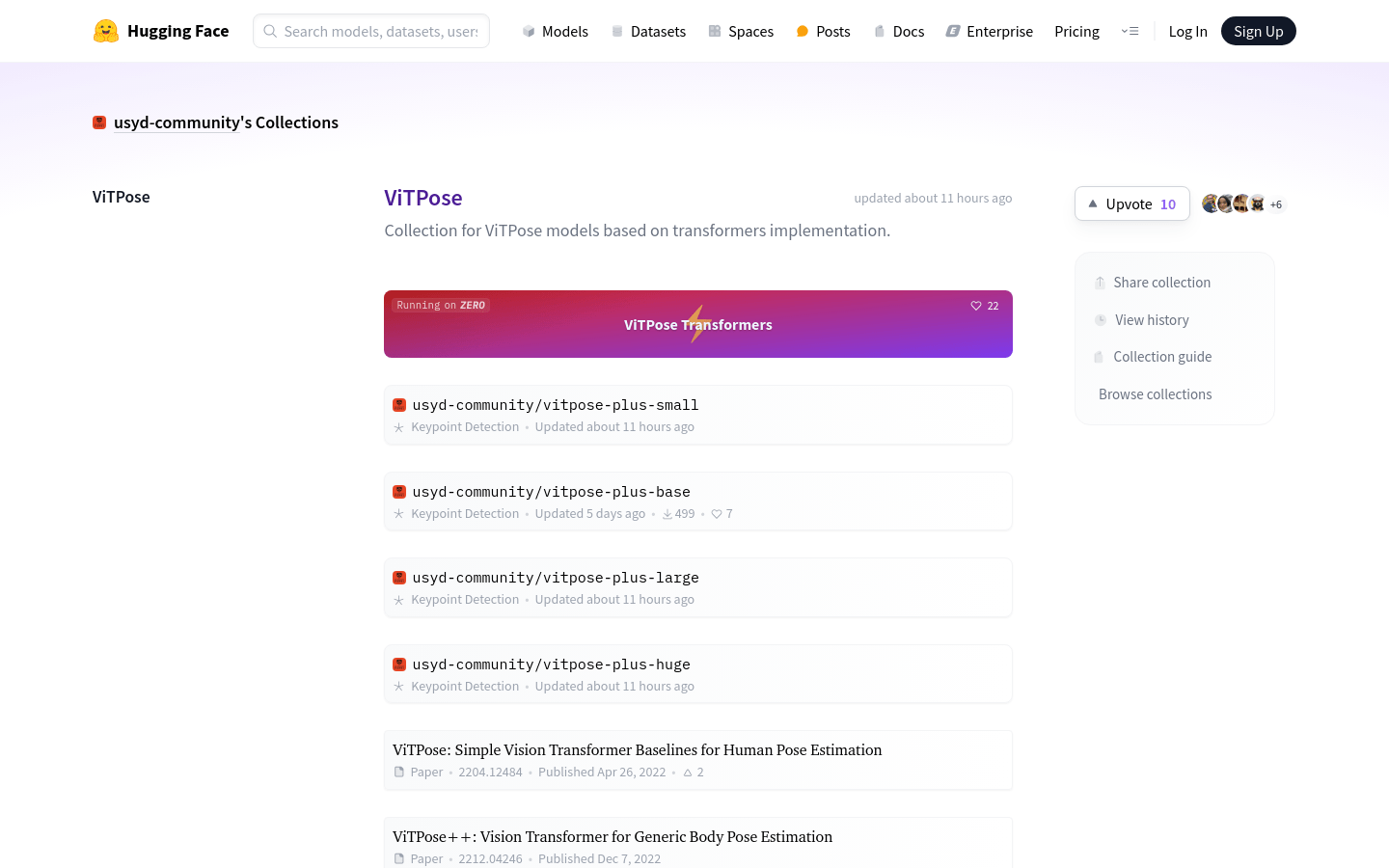

提供多种规模的ViTPose模型,包括small、base、large、huge等版本,适用于不同的计算资源和精度需求。

支持在Hugging Face Spaces上运行,用户可以在线体验模型的效果。

模型基于Transformer架构,能够有效地捕捉图像中的长距离依赖关系,提高姿态估计的准确性。

提供了详细的文档和使用指南,帮助用户快速上手和部署模型。

社区维护活跃,不断更新和优化模型,修复潜在的bug,提升模型性能。

使用教程

1. 访问Hugging Face官网,搜索ViTPose模型集合。

2. 选择合适的ViTPose模型版本,根据自己的需求和计算资源进行选择。

3. 下载模型权重文件和对应的配置文件。

4. 准备待检测的图像数据,确保图像格式和尺寸符合模型输入要求。

5. 使用提供的代码示例或API接口,加载模型并进行图像的姿态估计。

6. 解析模型输出的结果,获取人体关键点的坐标信息。

7. 根据应用场景对关键点坐标进行进一步处理和分析,如姿态识别、动作追踪等。