使用场景

开发一个支持多种语言的智能语音助手,能够实时将语音转换为文本。

为多语言客服系统提供高效的语音识别能力,快速响应不同语言的客户咨询。

在多语言会议中实时转录语音内容,支持多种语言的语音输入。

产品特色

支持多语言 ASR 模型开发,覆盖中文、英语、俄语、越南语、日语、泰语、印尼语和阿拉伯语。

采用灵活的参数配置设计,解耦配置与功能代码,支持多种语言任务。

集成语言 ID 到 RNN-Transducer 架构,提升多语言 ASR 性能。

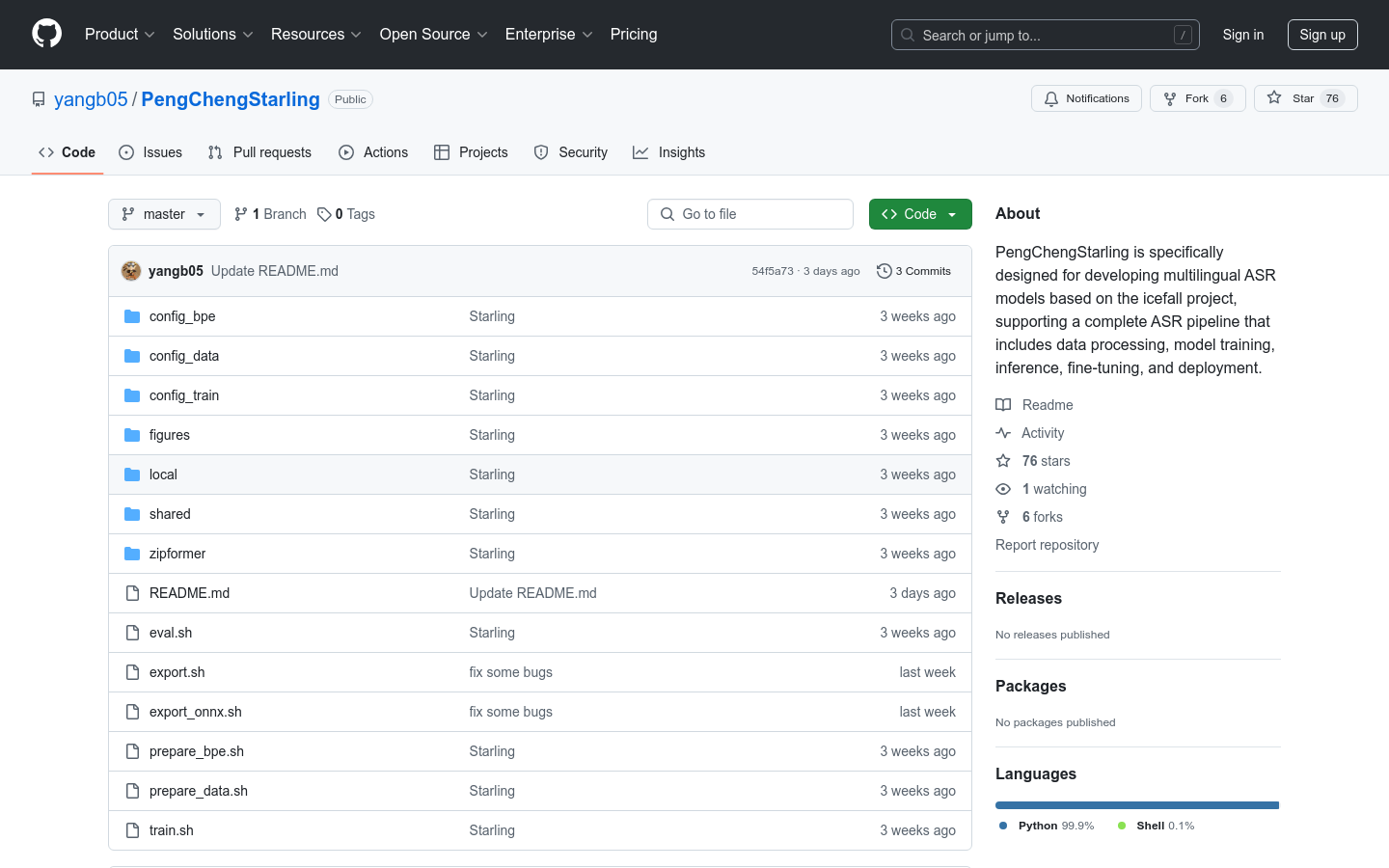

提供完整的 ASR 流程支持,包括数据处理、模型训练、推理、微调和部署。

支持流式 ASR 模型,推理速度比 Whisper-Large v3 快 7 倍,模型大小仅为 20%。

使用教程

1. 安装依赖:根据官方文档安装必要的依赖项。

2. 数据准备:使用 `zipformer/prepare.py` 脚本将原始数据预处理为所需格式。

3. BPE 模型训练:使用 `zipformer/prepare_bpe.py` 脚本训练 BPE 模型,支持多语言文本。

4. 模型训练:配置训练参数后,运行 `zipformer/train.py` 脚本开始训练多语言 ASR 模型。

5. 模型微调:设置 `do_finetune` 参数为 `true`,使用特定数据集对模型进行微调。

6. 模型评估:使用 `zipformer/streaming_decode.py` 脚本对训练好的模型进行评估。

7. 模型导出:使用 `zipformer/export.py` 或 `zipformer/export-onnx-streaming.py` 脚本将模型导出为 PyTorch 或 ONNX 格式,用于部署。