使用场景

在新闻报道中,使用 SyncAnimation 生成虚拟记者的头像和上半身动作,使其能够与音频同步进行对话。

在在线教育平台上,利用该技术生成虚拟教师的动画,增强教学的趣味性和互动性。

在游戏开发中,通过音频驱动生成角色的实时表情和动作,提升游戏的沉浸感。

产品特色

利用音频驱动生成高度逼真的说话头像和上半身动作

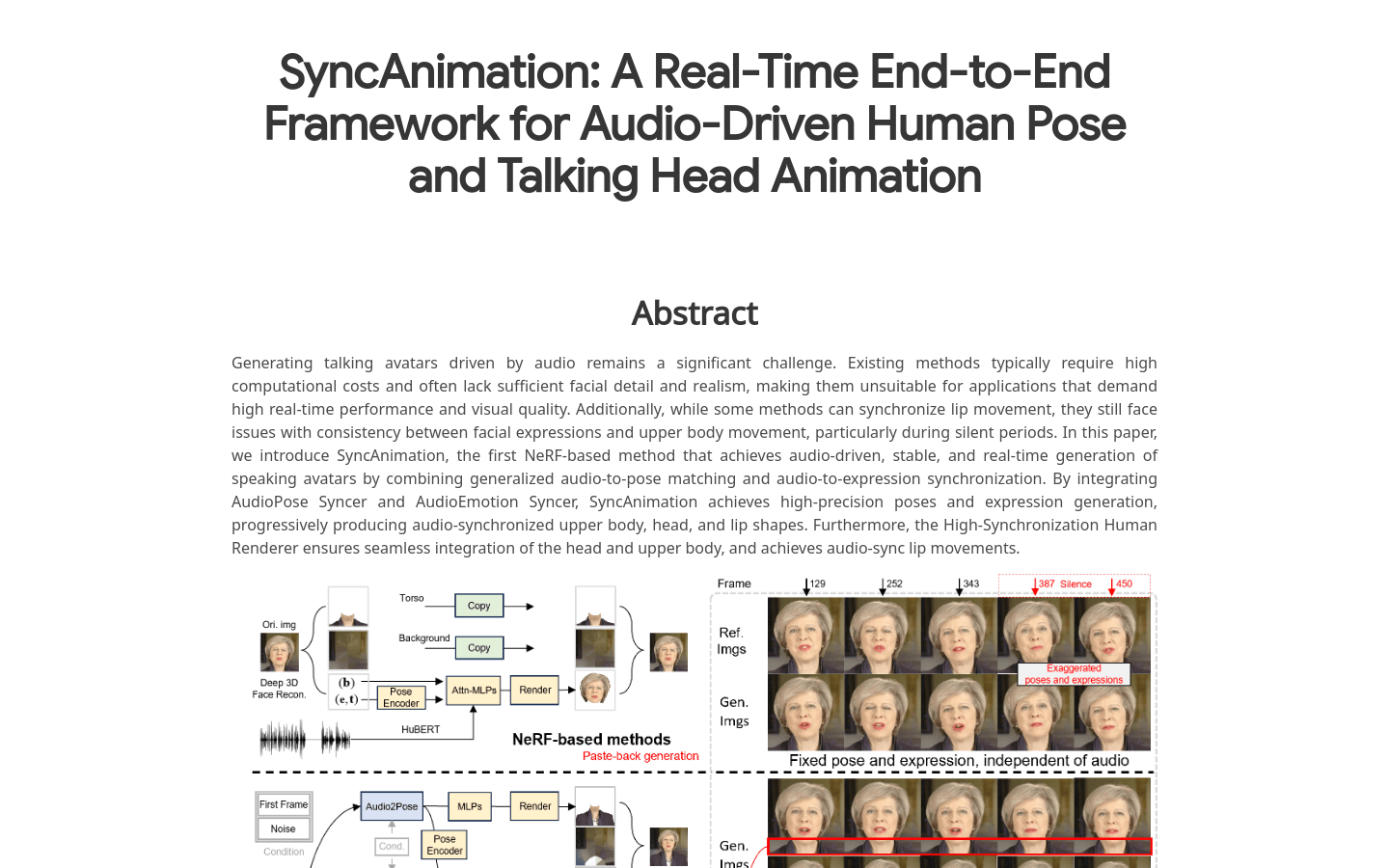

通过 AudioPose Syncer 和 AudioEmotion Syncer 实现高精度的姿态和表情生成

支持动态和清晰的唇部形状生成,并确保唇部与音频的同步

能够生成具有丰富表情和姿势变化的全身动画

支持从单目图像或噪声中提取身份信息,生成个性化动画

使用教程

1. 准备输入数据:提供一张人物图像(用于提取身份信息)和音频文件(用于驱动动画)。

2. 预处理:提取 3DMM 参数,作为 Audio2Pose 和 Audio2Emotion 的参考(或使用噪声)。

3. 姿态和表情生成:通过 AudioPose Syncer 和 AudioEmotion Syncer 生成与音频同步的上半身姿态和表情。

4. 动画渲染:使用 High-Synchronization Human Renderer 将生成的姿态和表情整合为完整的动画。

5. 输出结果:生成的动画可以直接用于视频制作、直播或其他应用场景。