使用场景

研究人员可以利用R1-V的技术框架,探索新的视觉语言模型训练策略,提升模型在复杂视觉任务中的表现。

开发者可以基于R1-V的开源代码和模型,快速搭建和优化自己的视觉语言应用,例如智能图像识别系统。

企业可以利用R1-V的低成本训练方案,在有限的预算内实现视觉语言模型的快速部署和应用,提升业务效率。

产品特色

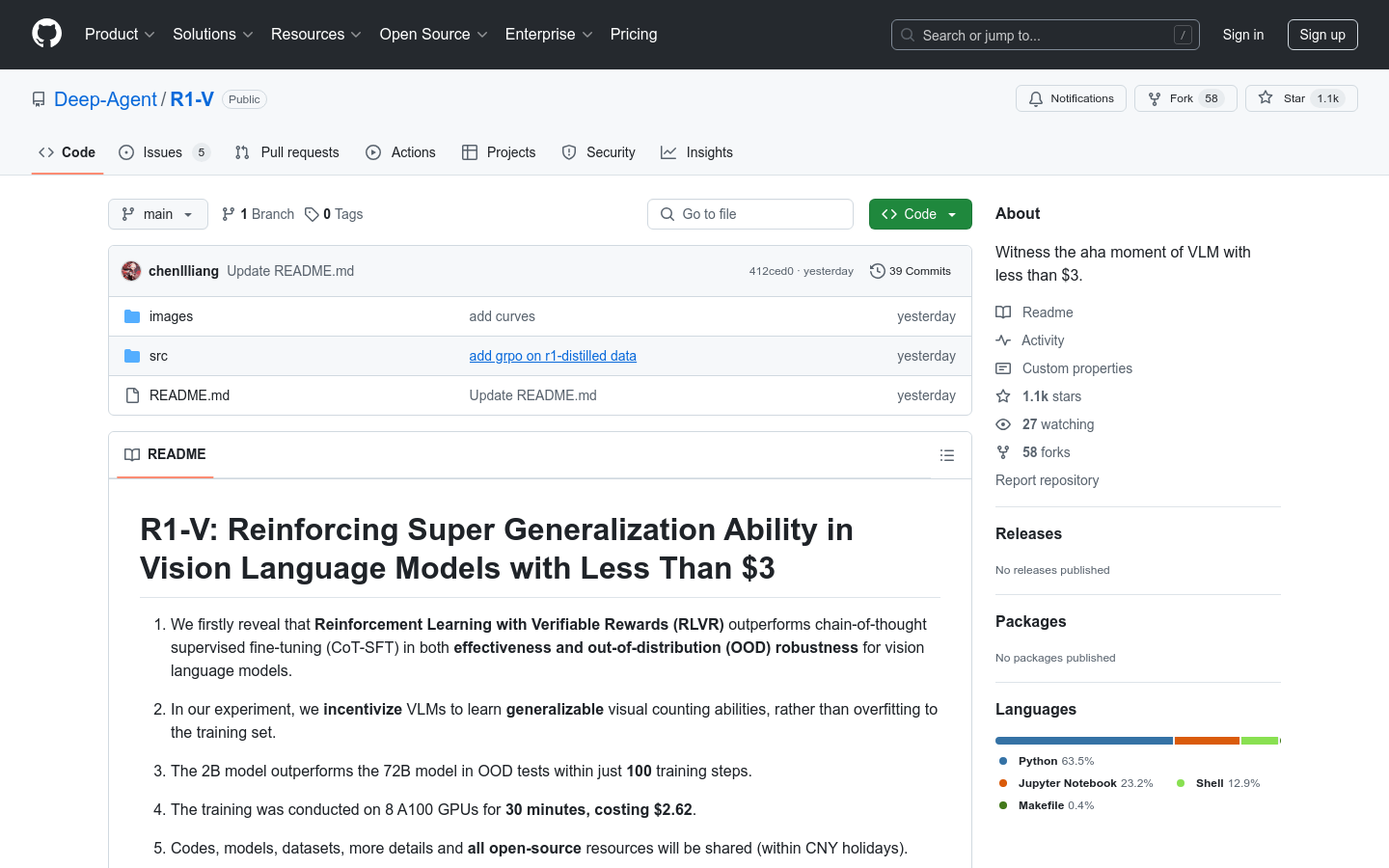

采用RLVR技术,优于传统的CoT-SFT方法,提升模型泛化能力。

在仅100个训练步骤内,2B模型即可在OOD测试中超越72B模型。

使用8个A100 GPU训练30分钟,成本低至2.62美元。

提供完整的开源代码、模型、数据集,便于研究和应用。

支持多种训练配置,适配不同硬件环境和需求。

使用教程

1. 克隆项目仓库到本地。

2. 安装项目依赖的Python包。

3. 设置环境变量,如DEBUG_MODE和LOG_PATH。

4. 使用torchrun命令启动训练脚本,指定输出目录、模型路径和数据集路径等参数。

5. 监控训练过程,通过日志文件查看训练进度和结果。