使用场景

使用文本提示生成舒缓的爵士乐,适用于餐厅或水疗中心背景音乐

基于一段爵士乐音频片段,继续生成后续音乐内容

通过模型生成 48kHz 高采样率的高质量古典音乐

产品特色

支持文本到音乐生成,可根据文本描述生成对应风格的音乐

支持音乐续写任务,可基于已有音频片段继续生成音乐

支持多种音频采样率(24kHz 和 48kHz),满足不同质量需求

提供长音频生成能力,可生成超过 5 分钟的音乐

支持混合精度训练(FP16、BF16、FP32),提高训练效率

提供方便的微调和推理脚本,简化模型调整和部署流程

使用教程

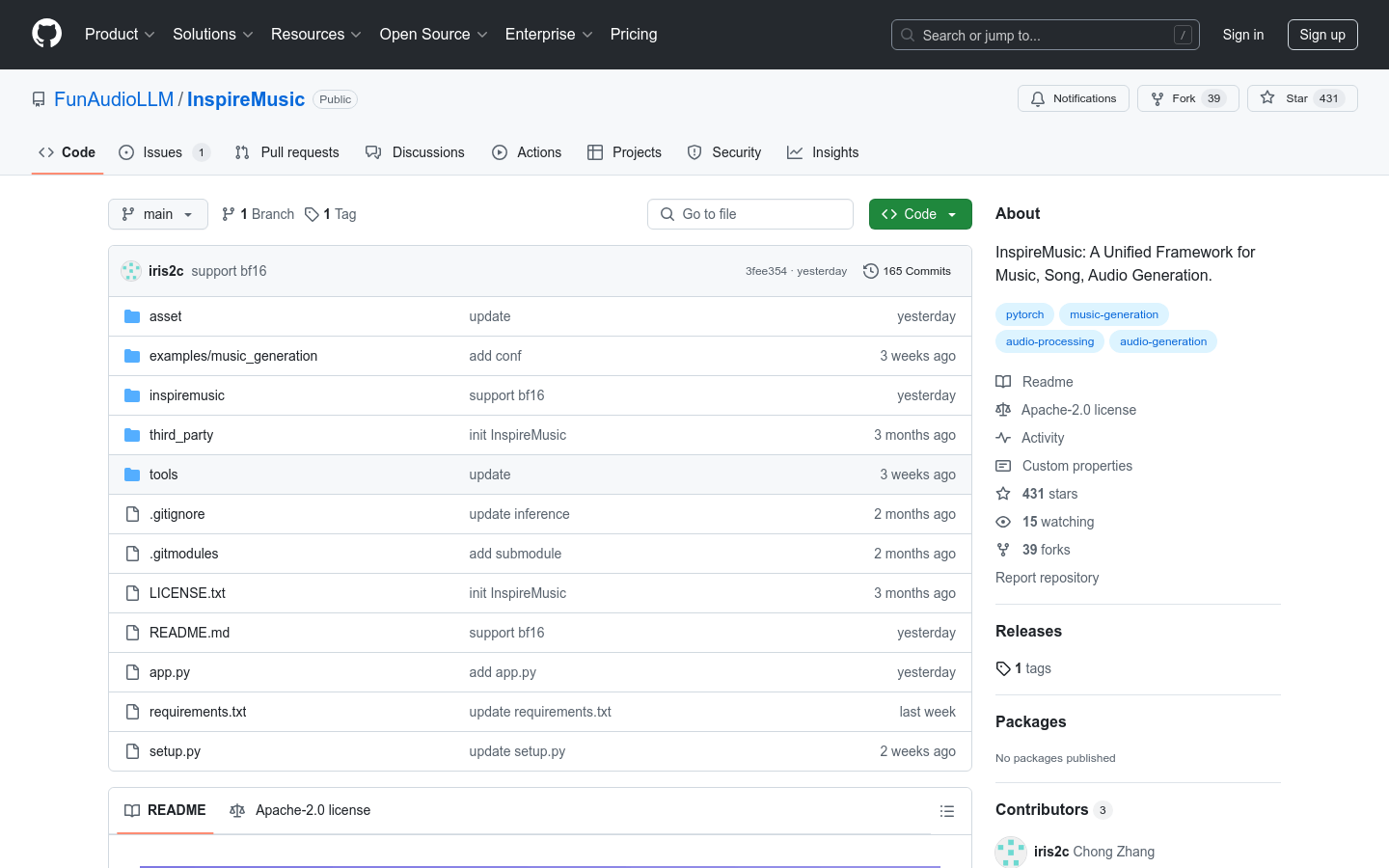

1. 克隆仓库:`git clone --recursive https://github.com/FunAudioLLM/InspireMusic.git`

2. 安装依赖:创建 Conda 环境并安装 Python 3.8 和 PyTorch 2.0.1,运行 `pip install -r requirements.txt`

3. 下载预训练模型:从 ModelScope 或 HuggingFace 下载 InspireMusic 模型

4. 运行推理脚本:使用 `python -m inspiremusic.cli.inference` 命令进行文本到音乐的生成

5. 自定义生成参数:通过命令行参数调整生成任务、模型、文本提示、音频时长等