使用场景

使用Moonlight模型进行数学问题解答,如'1+1=2, 1+2='的推理。

在Hugging Face平台上部署Moonlight模型,用于文本生成任务。

基于Moonlight的指令调优版本,进行多语言对话生成。

产品特色

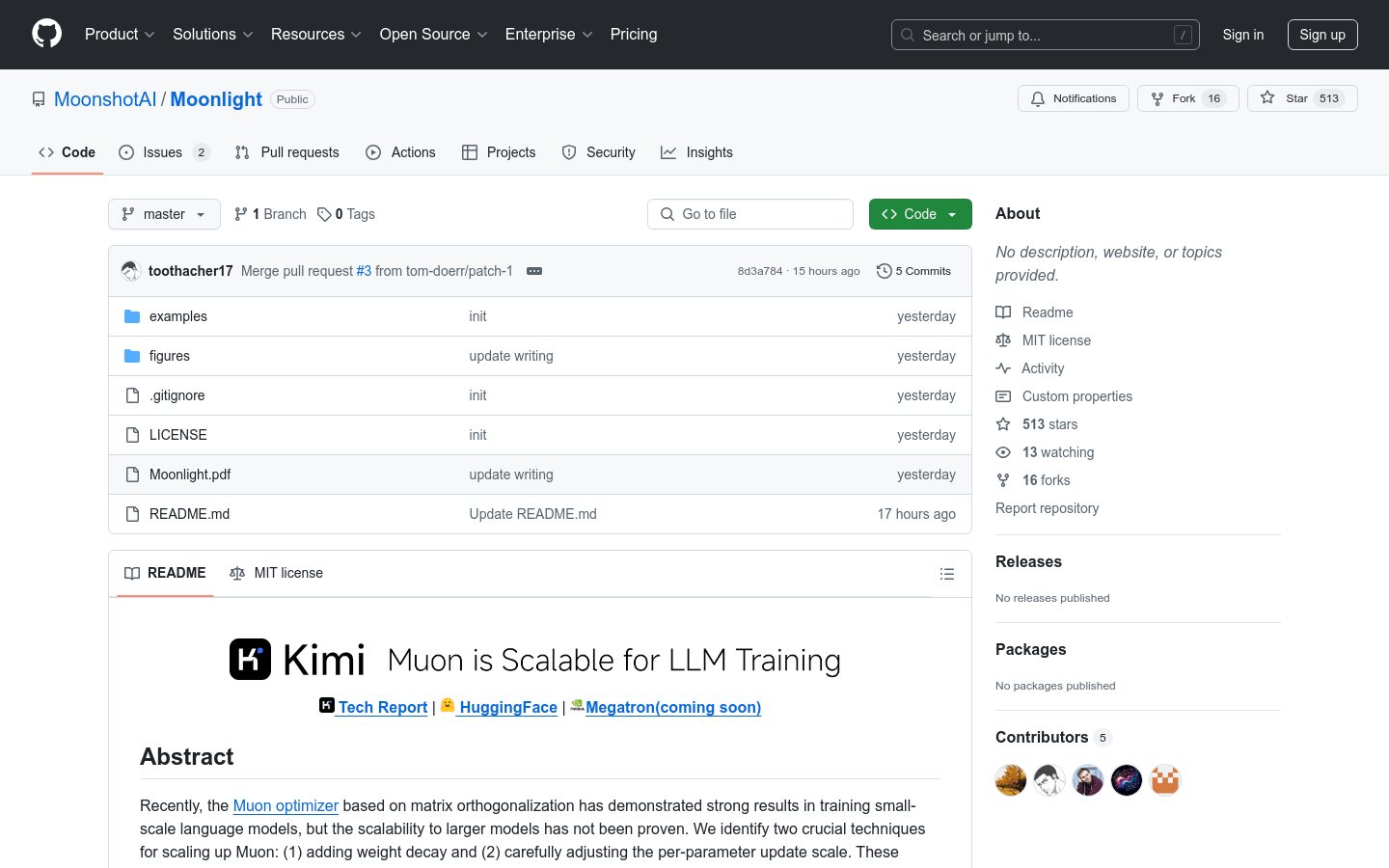

使用Muon优化器实现高效的模型训练

支持大规模分布式训练,优化内存和通信效率

在多项基准测试中表现优异,如MMLU、BBH等

提供预训练模型和指令调优版本,方便直接使用

兼容Hugging Face平台,易于部署和推理

支持多种自然语言处理任务,包括文本生成和代码生成

开源实现,便于研究和二次开发

提供中间检查点,支持持续研究和模型改进

使用教程

1. 安装必要的依赖,包括Python 3.10、PyTorch >= 2.1.0和transformers 4.48.2。

2. 从Hugging Face下载预训练模型:`moonshotai/Moonlight-16B-A3B`。

3. 使用transformers库加载模型和分词器。

4. 准备输入文本,如数学问题或对话内容。

5. 使用模型生成文本,设置最大生成长度。

6. 输出生成结果并进行评估或进一步处理。