使用场景

使用文本描述生成一段关于两只拟人化猫咪在舞台上拳击的视频。

从一张静态的海滩照片生成一段动态的海滩视频,包含海浪、阳光和沙滩。

将一段低分辨率视频升级为高分辨率视频,同时优化画面质量。

产品特色

支持文本到视频(Text-to-Video)生成,可根据文本描述生成高质量视频。

支持图像到视频(Image-to-Video)生成,能够从静态图像生成动态视频。

支持视频编辑功能,可对现有视频进行修改和优化。

支持多语言文本生成,能够生成包含中文和英文的视频内容。

提供高效的视频 VAE,能够高效编码和解码 1080P 视频,保留时间信息。

使用教程

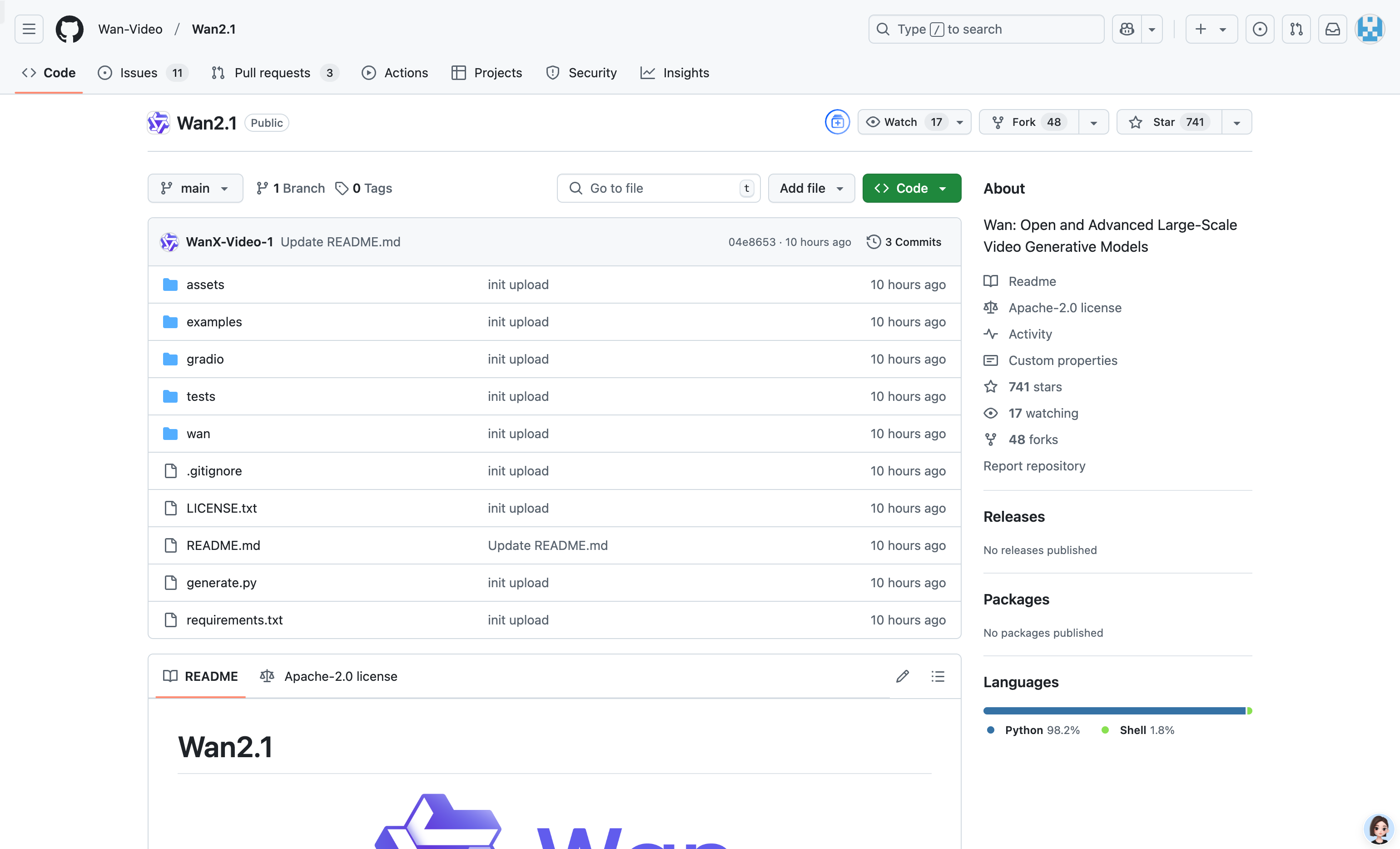

1. 克隆仓库:`git clone https://github.com/Wan-Video/Wan2.1.git`

2. 安装依赖:`pip install -r requirements.txt`

3. 下载模型权重:通过 Hugging Face 或 ModelScope 下载模型。

4. 运行生成脚本:使用 `generate.py` 脚本,指定任务类型、模型路径和输入参数。

5. 查看生成结果:根据任务类型,生成的视频或图像将保存在指定路径。