使用场景

在大规模 MoE 模型中,Flux 能够显著减少通信开销,提高模型训练速度。

研究人员可以利用 Flux 的高效内核优化现有模型的推理性能。

开发者可以在 PyTorch 项目中集成 Flux,提升分布式训练的效率。

产品特色

支持多种 GPU 架构,包括 Ampere、Ada Lovelace 和 Hopper

提供高性能的通信重叠内核,优化计算效率

与 PyTorch 深度集成,易于在现有框架中使用

支持多种数据类型,包括 float16 和 float32

提供详细的安装指南和使用示例,方便开发者快速上手

使用教程

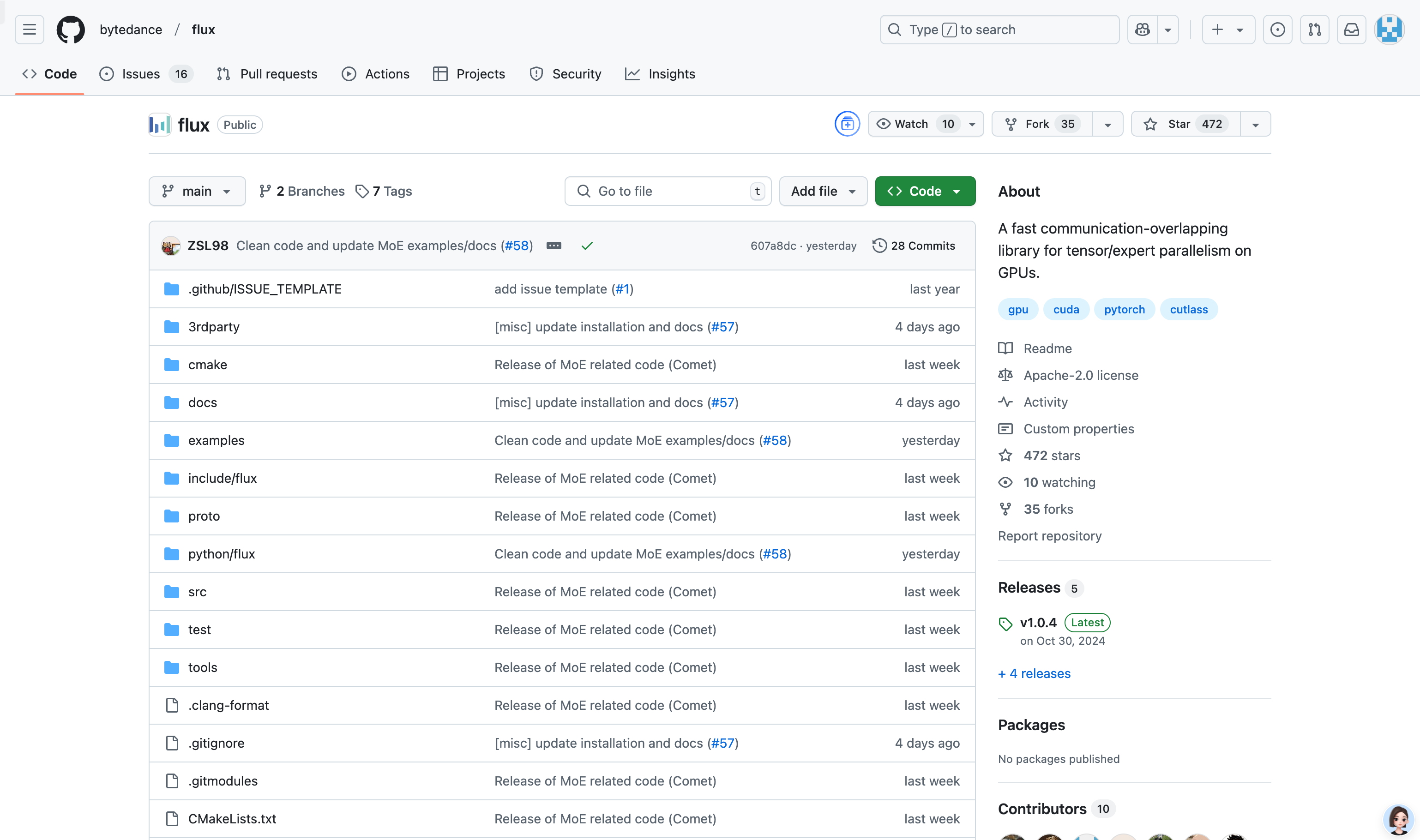

1. 从 GitHub 克隆 Flux 仓库并安装依赖。

2. 根据 GPU 架构选择合适的构建选项,运行 build.sh 脚本。

3. 安装完成后,使用 Flux 提供的示例代码测试功能。

4. 在 PyTorch 项目中集成 Flux,通过调用其 API 实现通信重叠。

5. 根据需要调整 Flux 的配置,优化模型的训练和推理性能。