使用场景

在学术研究中,研究人员可以利用MIDI生成3D场景,用于验证新的算法或模型。

在游戏开发中,开发者可以快速从概念图像生成3D场景,加速游戏世界的构建。

在虚拟现实应用中,MIDI可以将用户提供的图像转化为沉浸式的3D场景,增强用户体验。

产品特色

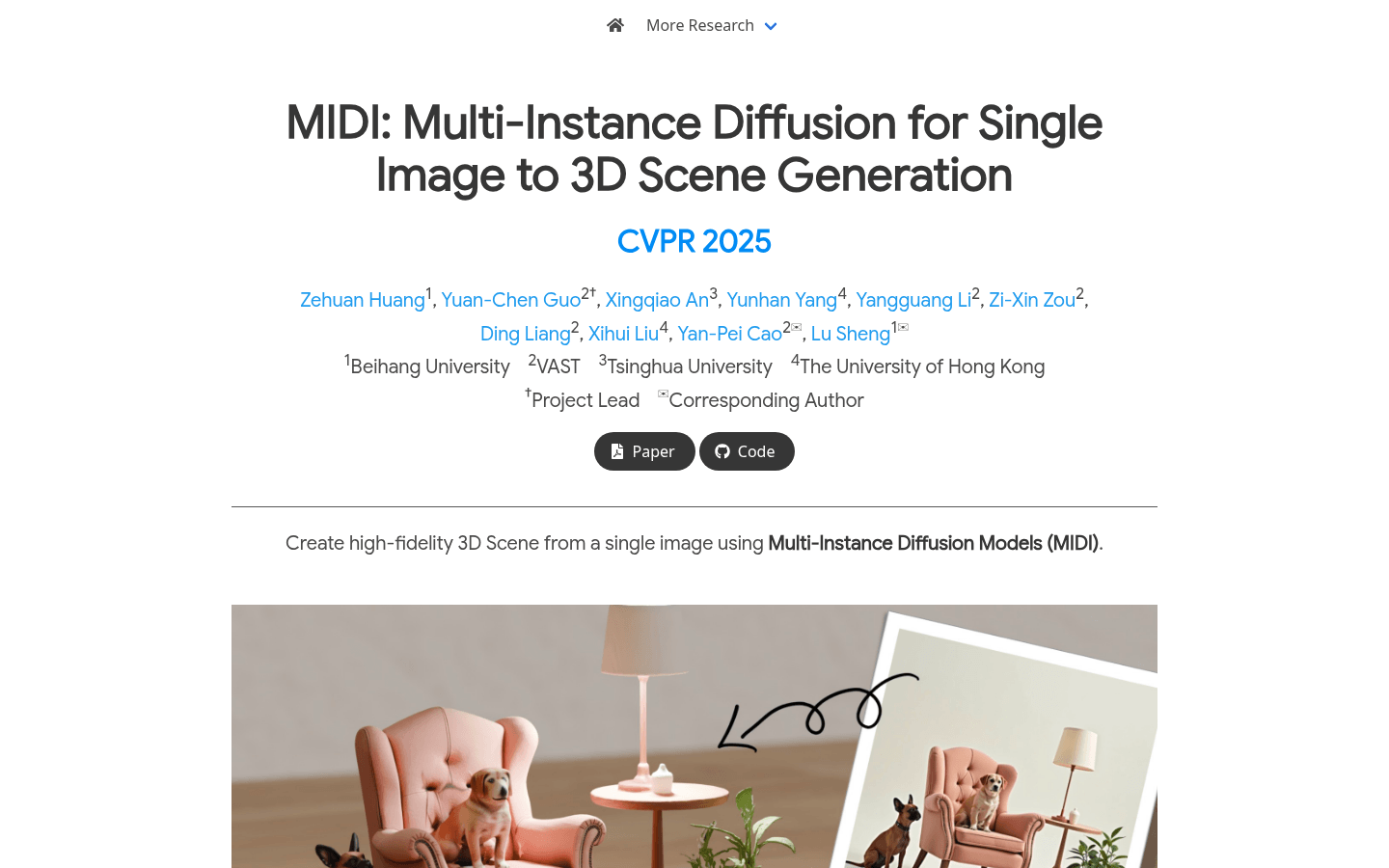

从单张图像生成多个3D实例,支持场景的直接组合。

采用多实例注意力机制,捕捉物体间交互和空间一致性。

利用部分物体图像和全局场景上下文作为输入,直接建模物体补全。

通过有限的场景级数据监督3D实例间的交互,同时使用单物体数据进行正则化。

支持多种数据类型,包括合成数据、真实场景数据和风格化场景图像。

生成的3D场景纹理可通过MV-Adapter进一步优化。

训练和生成过程高效,总处理时间仅需40秒。

模型代码开源,便于研究和开发人员使用和扩展。

使用教程

1. 访问MIDI项目页面,了解其功能和特点。

2. 下载并安装相关的代码库和依赖项。

3. 准备输入图像,可以是合成数据、真实场景图像或风格化图像。

4. 使用MIDI模型对输入图像进行处理,生成多个3D实例。

5. 将生成的3D实例组合成完整的3D场景。

6. 如果需要,可以使用MV-Adapter进一步优化场景纹理。

7. 根据需求对生成的3D场景进行后续处理或应用。