使用场景

使用 automcp 将 CrewAI 框架中的工具转换为 MCP 服务器,方便与其他服务集成。

通过 automcp 部署 LangGraph 的 AI 代理,使其能通过标准化接口提供服务。

利用 automcp 快速搭建 Llama Index 的 MCP 服务器,帮助开发团队实现快速原型开发。

产品特色

支持多种代理框架:可以将 CrewAI、LangGraph、Llama Index 等多种代理框架转换为 MCP 服务器。

CLI 界面:提供易于使用的命令行工具,简化了服务器的生成和管理。

快速部署:通过简化的配置过程,开发者可以迅速启动和运行 MCP 服务器。

输入模式定义:允许用户定义输入模式,以便于与代理进行交互。

环境变量配置:支持使用环境变量来管理 API 密钥等敏感信息。

支持多种传输模式:可以选择 STDIO 或 SSE 传输模式,根据使用场景灵活调整。

自动生成文件:运行命令后会自动生成配置文件,减少手动配置的复杂性。

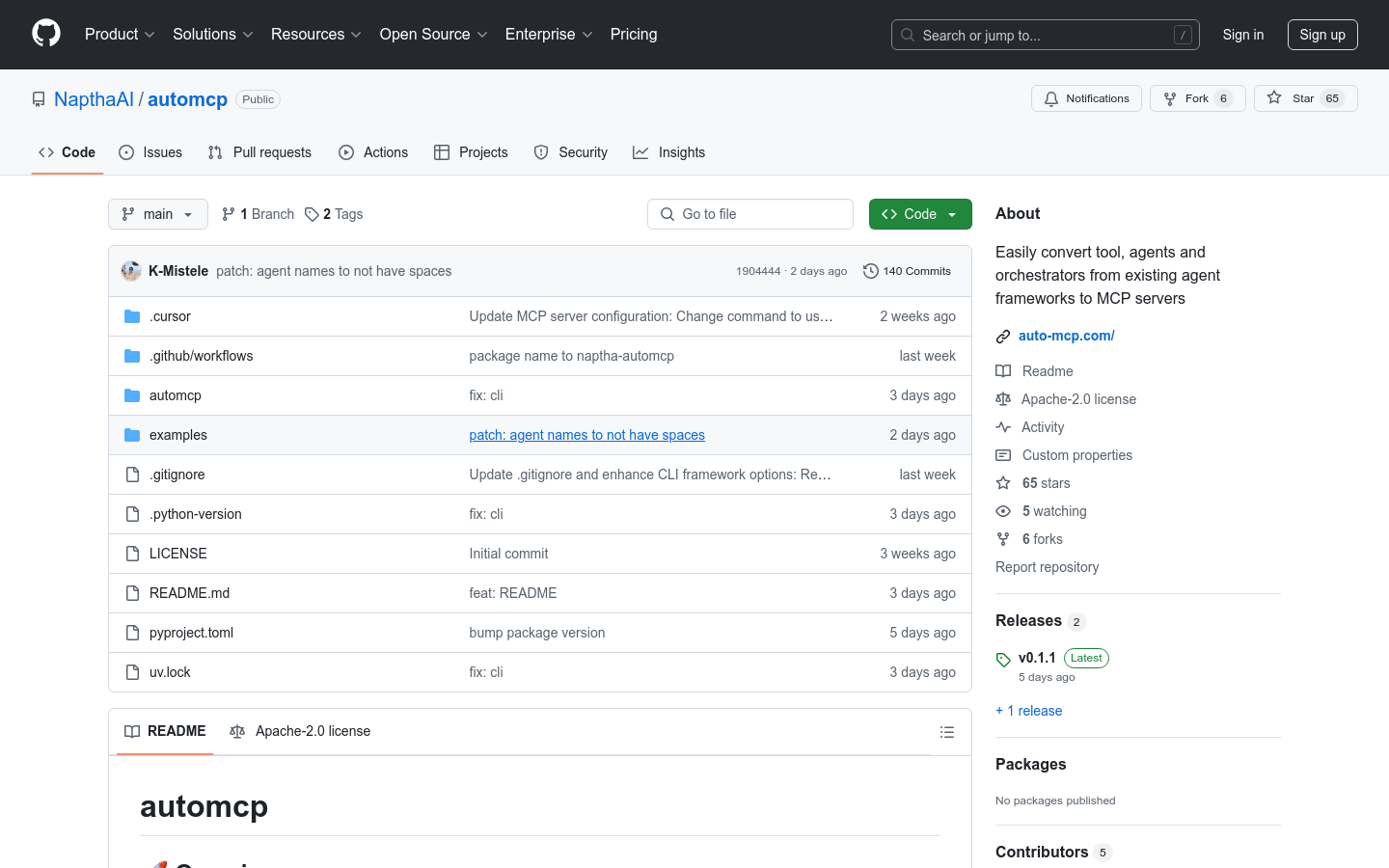

社区支持:开源项目,用户可以在 GitHub 上提交问题和贡献代码。

使用教程

安装 automcp:使用命令 pip install naptha-automcp 进行安装。

初始化项目:在项目目录中运行命令 automcp init -f < 框架 > 来生成 MCP 服务器文件。

编辑 run_mcp.py 文件:根据需要配置代理类和输入模式。

安装依赖:确保所有必要的依赖项都已安装。

运行服务器:使用 automcp serve -t < 传输模式 > 启动 MCP 服务器。